讯飞语音合成系统的使用方法

大家都知道,语音识别模块没有思考的能力,更加不会听懂人说的话或者自动的回答问题。模块具有问答能力是因为“答”的语音是人事先录制好并且存放进了SD卡中的,然后模块识别到人说话的内容便自动的播放出对应的语音,也就是说答案是早早就准备好的。那么,模块“回答”的语音文件是要用户事先录制好再存放到SD卡中的。目前,制作这个语音文件一般通过下面两种方式:

1.用户自己用电脑通过咪头人工录制。

2.用语音合成软件自动合成(例如:讯飞语音合成系统)。

第1种方法做出来的语音文件效果最好,发音自然,但是做起来比较麻烦,经常更换语音就体现了工作量之大了。

第2种方法做出来的语音文件效果不太理想,发音比较生硬,但是因为做起来比较方便,是大多数人采用的一种方式。

下面将向大家介绍讯飞语音合成系统的使用方法(安装方法请参考《讯飞语音合成系统安装方法.doc》):

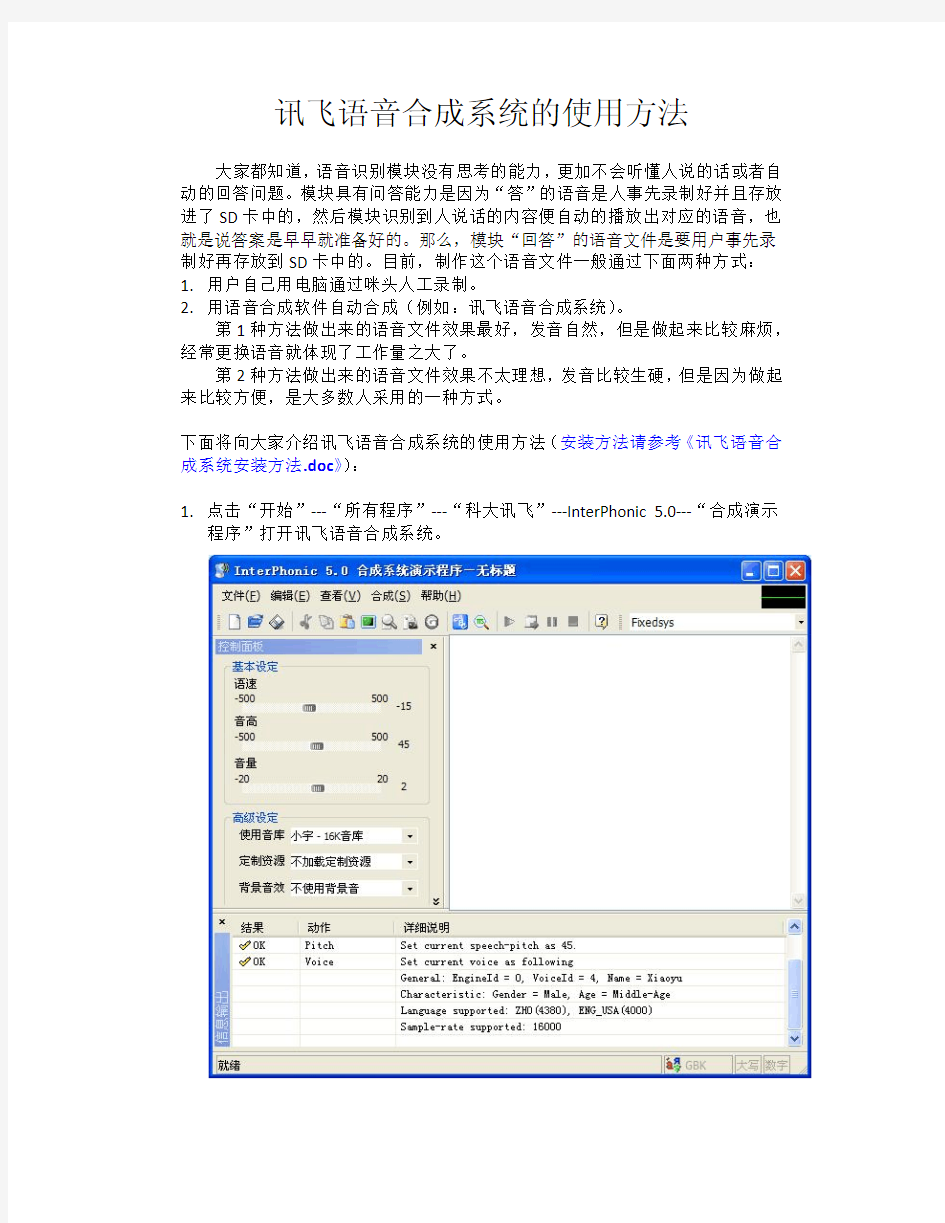

1.点击“开始”---“所有程序”---“科大讯飞”---InterPhonic 5.0---“合成演示

程序”打开讯飞语音合成系统。

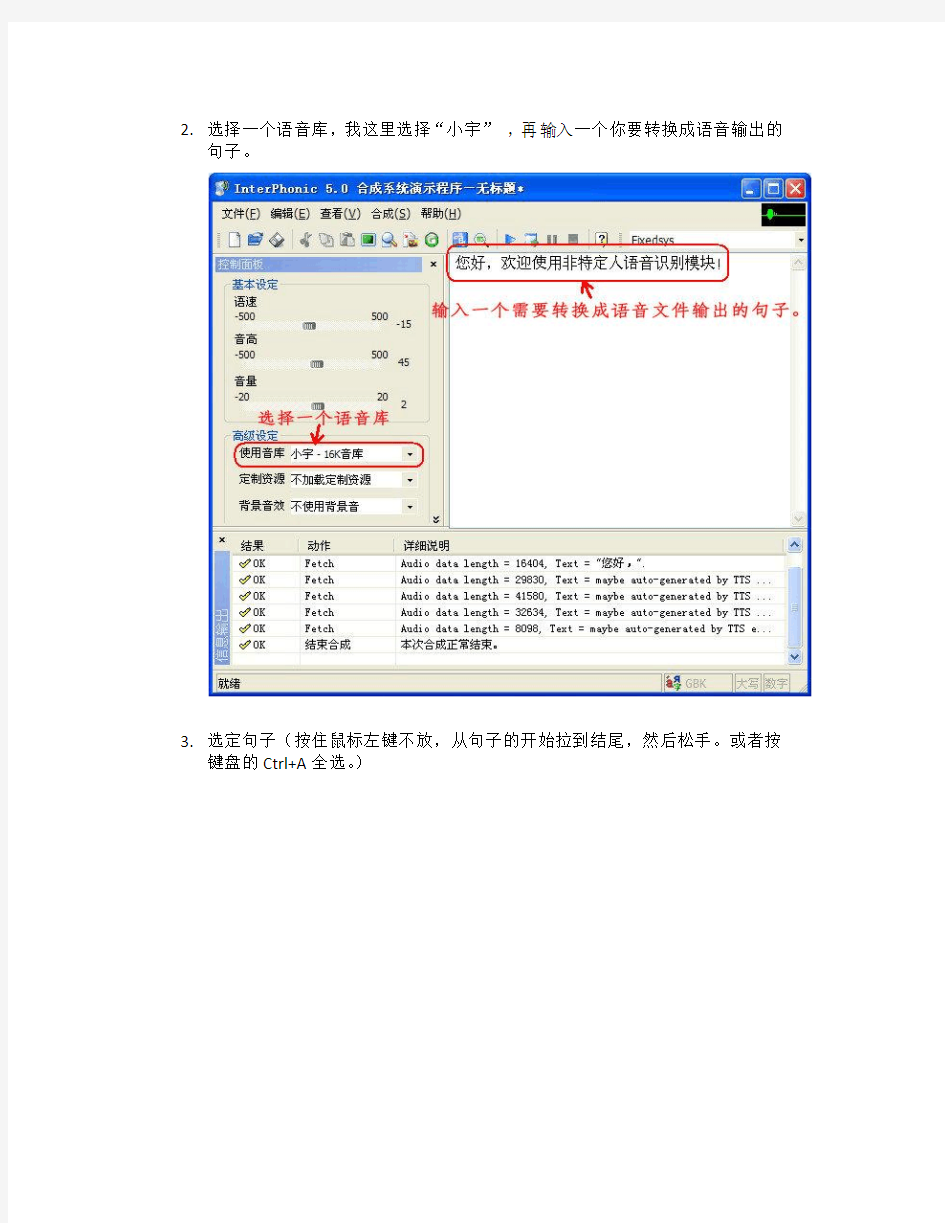

2.选择一个语音库,我这里选择“小宇”,再输入一个你要转换成语音输出的

句子。

3.选定句子(按住鼠标左键不放,从句子的开始拉到结尾,然后松手。或者按

键盘的Ctrl+A全选。)

4.点击播放键(或者按F5键)可以试听效果,如果不满意可以再修改。有时候

语气并不符合要求,听起来很别扭,我们可以通过用同音词来修改,例如“为”

字,读起来不太好听,我们可以用“胃”字去代替,这些技巧大家多点锻炼

就能找出诀窍了。

5.修改句子知道试听效果满意之后就可以导出XXXX.WAV语音文件了。

6.在弹出的对话框中输入将要转换输出的WAV格式的语音文件名称,和保存路

径,本实例选择输出到桌面。

7.最后,桌面上便可以看到一个合成好的WAV语音文件,大家可以用QQ音乐

播放器等试听效果。

8.理论上讲WAV格式的语音文件是直接可以用模块播放的,实际上效果不理想,

音质很差,有时甚至播放不出来,所以我们还是要将此WAV文件转换成XXXX.ad4文件然后再拷贝到SD卡根目录下。

AD4格式文件转换方法请参考《AD4音频格式转换指南.pdf》。

1.什么是MSP 移动互联网已迅速成为当今世界发展最快、规模最大和市场前景最好的行业,已吸引众多知名IT公司进军该领域。由于现有移动终端设备交互方式存在诸多局限,如键盘太小,输入文字不便;屏幕太小,阅读信息不便;以及无法处理特定场景下的交互,如开车和步行情形。语音技术是人机交互最自然的方式,可以给以上缺陷提供完美的解决方法,移动互联网对语音技术有着天然的需求。 科大讯飞拥有全球领先的中文智能语音技术,多年来一直致力于研发将语音技术应用到千家万户,MSP(iFLY Mobile Speech Platform)便在此背景下诞生。通过MSP,移动互联网的终端用户可以随时随地的使用语音服务。语音技术带来品质生活,始终是MSP团队所坚持不懈的理念。 1.1主要功能 iFLY Mobile Speech Platform(以下简称MSP)是一个应用于移动互联网的语音服务平台,其主要目标是: 1) 实现可面向移动2G/3G网络及互联网提供语音服务的服务器,在现有科大讯飞电信级语音服务平台ISP基础上为移动终端应用程序提供多路并发的语音合成、语音识别、语音听写功能,通过架设在互联网的语音应用服务器,用户可以随时随地获得高质量的语音服务; 2) 实现基于移动终端以及桌面平台的语音应用客户端,提供统一的语音应用开发接口,通过该接口用户可以方便、快速地开发语音应用;同时,MSP也将开放一些基于移动以及桌面平台的语音应用,用于展示MSP语音服务平台的功能和使用方法,让用户直接体验到最新的语音技术; MSP最终提供了架构于互联网的语音云服务和一套移动互联网语音解决方案、应用示例,把语音服务的应用范围拓宽到移动互联网领域,为语音服务产品走向移动互联网市场开辟全新的应用模式。 MSP平台整合了科大讯飞研究院、中国科技大学讯飞语音实验室以及清华大学讯飞语音实验室在语音识别、语音合成等技术上多年的技术成果,语音核心技术上达到了国际领先水平。 MSP系统采用分布式架构,继承了科大讯飞成熟的电信级语音平台高稳定的特点,可以满足电信级应用的高可靠性、高可用性要求。针对传统语音应用集成开发困难,业务设计繁琐的问题,MSP产品大大简化了集成开发和业务开发的复杂度,为系统集成人员和业务开发人员提供了便捷、高效的开发环境。 1.2语音技术介绍 语音是智能人机交互的最直接最便捷的手段,近些年来,语音正在日益影响和改变人们的日常生活。随着移动互联网时代的到来,移动终端由于本身输入手段的限制,语音技术带来的交互优势更加明显,可以大大提高移动终端的交互体验和交互效率。智能语音技术包含语音识别和语音合成技术,这两个技术使得终端具备了能听会说的能力。 语音识别(Auto Speech Recognize,ASR)技术,是让机器通过识别和理解过程使之听懂人类语言的技术。语音识别技术是信息技术中人机交互的关键技术,目前已经在呼叫中心、电信增值业务、企业信息化系统中有了广泛的应用。随着语音识别在语音搜索、语音控制等全新应用领域的深入应用,语音识别技术被业界权威人士誉为有可能引发人机界面领域革命的关键技术。自动语音识别技术所要解决的问题是让计算机能够“听懂”人类的语音,将语音中包含的文字信息“提取”出来。ASR技术在“能听会说”的智能计算机系统中扮演着重要角色,相当于给计算机系统安装上“耳朵”,使其具备“能听”的功能,进而实现信息时代利用“语音”这一最自然、最便捷的手段进行人机通信和交互。 语音合成(Text To Speech,TTS)技术能够自动将任意文字实时转换为连续的自然语音,是一种能够在任何时间、任何地点,向任何人提供语音信息服务的高效便捷手段,非常符合信息时代海量数据、动态更新和个性化查询的需求。 近年来,语音识别、语音合成等语音技术取得了长足的进步,科大讯飞语音技术历经20年不懈创新,自90年代中期以来,在历次的国内国外评测中,各项关键指标均名列第一。MSP移动语音平台是科大讯飞针对日益丰富多样的移动互联网应用需求,向移动互联网推出“即开即有、按需取用”的语音服务能力,为快速构建各种各样移动语音应用程序提供强大、稳定、易用的互联网动力引擎。 1.3系统架构 MSP讯飞语音云平台采用基于互联网的C/S架构,基本拓扑结构如下图:

人工语音合成处理系统 V1.0

目录 1引言 (3) 1.1背景 (3) 1.2系统特点 (3) 2系统硬件设计 (4) 2.1总体硬件设计 (4) 2.2蜂鸣器设计 (4) 2.3整体硬件设计电路图 (7) 3系统软件设计 (7) 3.1软件设计构成 (7) 3.2软件设计流程 (8) 4系统应用介绍 (9) 5参考书籍 (11)

1引言 1.1背景 现今社会人们依靠各种机电系统和计算机系统从事劳动生产、工业控制和科学研究。当人们操纵这些系统的时候,就自然地出现了人与系统的信息交流,即系统不断的报告自己的运行状态和结果,而人们根据这些状态和结果发出下一步应进入何种状态的命令。长期以来,计算机与人之间的信息交流主要依靠各种形式的键盘,按键等实现的,计算机要报告运行状态,结果只能通过各种显示装置。 语音合成技术是实现人机语音通信,建立一个有听说能力的口语系统所必需的关键技术之一。随着计算机运算速度的提高,人工智能领域的研究获得了飞速发展,而人工智能领域的最新研究成果不断地向语音研究渗透,促使语音处理技术及语音合成的研究也产生了突破性的飞跃。和语音识别相比,语音合成技术相对要成熟一些,是该领域中近期最有希望产生突破并形成产业化的一项技术。 人工语音合成处理系统V1.0(简称语音合成系统)由软件实现词汇语音合成器,使人们能够甩掉键盘,通过语言命令进行操作。系统在完成其它任务的同时具备语音输出功能,可使单片机系统成本下降,体积减小,可靠性提高。它对于解脱繁琐的事物性和危险性工作更具有现实意义! 1.2系统特点 提高合成语音的自然度 就汉语语音合成来说,目前在单字和词组一级上,合成语音的可懂度和自然度已基本解决,但是到句子乃至篇章一级时其自然度问题就比较大。基于语音数据库的语音合成方法进一步提高语音合成的自然度。因为这是一种采用自然语音波形直接拼接的方法,进行拼接的语音单元是从一个预先录下的自然语音数据库中挑选出来的,因此有可能最大限度地保留语音的自然度。 丰富合成语音的表现力 目前国内外大多数语音合成是针对文语转换系统,且只能解决以某种朗读风格将书面语言转换成口语输出,缺乏不同年龄、性别特征及语气、语速的表现,更不用说赋予个人的感情色彩。本系统对入机交互提出了更高的要求,即语音合成已开始从文字到语音的转换阶段向概念到语音的转换阶段发展。 在嵌入式系统中应用语音合成技术 在提高合成语音的质量和增强语音合成的表现力以外,在其他实用化方面也有加以改进的地方。目前高质量的汉语文语转换系统~般需要几兆字节到几十兆,甚至几百兆字节的存储容量,这在以PC机或工作站为硬件平台的应用中是没

语音识别芯片所涉及的技术包括:信号处理、模式识别、概率论和信息论、发声机理和听觉机理、人工智能等等。 语音识别分类 按照使用者的限制而言,语音识别芯片可以分为特定人语音识别芯片和非特定人语音识别芯片。 特定人语音识别芯片是针对指定人的语音识别,其他人的话不识别,须先把使用者的语音参考样本存入当成比对的资料库,即特定人语音识别在使用前必须要进行语音训练,一般按照机器提示训练2遍语音词条即可使用。 非特定人语音识别是不用针对指定的人的识别技术,不分年龄、性别,只要说相同语言就可以,应用模式是在产品定型前按照确定的十几个语音交互词条,采集200人左右的声音样本,经过PC算法处理得到交互词条的语音模型和特征数据库,然后烧录到芯片上。应用这种芯片的机器(智能娃娃、电子宠物、儿童电脑)就具有交互功能了。 非特定人语音识别应用有的是基于音素的算法,这种模式下不需要采集很多人的声音样本就可以做交互识别,但是缺点是识别率不高,识别性能不稳定。 语音识别基本原理 嵌入式语音识别系统都采用了模式匹配的原理。录入的语音信号首先经过预处理,包括语音信号的采样、反混叠滤波、语音增强,接下来是特征提取,用以从语音信号波形中提取一组或几组能够描述语音信号特征的参数。特征提取之后的数据一般分为两个步骤,第一步是系统"学习"或"训练"阶段,这一阶段的任务是构建参考模式库,词表中每个词对应一个参考模式,它由这个词重复发音多遍,再经特征提取和某种训练中得到。第二是"识别"或"测试"阶段,按照一定的准则求取待测语音特征参数和语音信息与模式库中相应模板之间的失真测度,最匹配的就是识别结果。 语音识别四大平台 1、科大讯飞 科大讯飞股份有限公司成立于1999年,是一家专业从事智能语音及语言技术、人工智能技术研究,软件及芯片产品开发,语音信息服务及电子政务系统集成的国家级骨干软件企业。2008年,科大讯飞在深圳证券交易所挂牌上市,股票代码:002230。 11月23日科大讯飞轮值总裁胡郁在发布会上引述了罗永浩在9 月锤子发布会上的演示数据,表示科大讯飞的语音输入识别成功率也达到了97%,即使是离线识别准确率也达到了95%。 2、云知声 云知声成立于2012年6月。之前1年,Siri的发布再度唤醒了大家对语音识别的关注。经过四年多的积累,云知声的合作伙伴数量超过2万家,覆盖用户超过1.8亿,其中语音云平台覆盖城市超过470个,覆盖设备超过9000万台。 3、百度 百度则在11月22日宣布向开发者开放了情感合成、远场方案、唤醒二期和长语音方案等四项语音识别技术。百度语音开放平台自2013 年10 月上线以来每日在线语音识别请求已经达到了1.4 亿次,开发者数量超过14 万。在如此庞大的数据支撑下,百度语音在“安静条件下”的识别准确率达到了97%。4、搜狗 搜狗语音团队在11 月21 日推出了自己的语音实时翻译技术。搜狗的这项技术主要包括两个方面,分别是语音识别和机器翻译。根据该团队的介绍,搜狗语音识别的准确率达到了97%,支持最快400 字每秒的听写。 语音识别芯片原厂及芯片方案 1、ICRoute 总部:上海 简介:ICRoute专注于开拓语音识别的芯片市场,致力于研发出高性能的语音识别,语音处理芯片。为各种平台的电子产品提供VUI(Voice User Interface)语音人机交互界面。目前提供的语音识别芯片,可以在

摘要 随着科学技术水平的不断提高,社会文明的不断进步,人类对生活质量的追求也越来越高。智能手机的兴起,使终端应用成为高新技术的发展平台.苹果公司的Siri将语音识别技术投入到智能手机中,引发了人机交互语音识别技术的热潮。语音是人类相互交流中最直接有效的沟通方式,与键盘,鼠标这些输入设备相比,语音是最自然的输入方式。从上世纪五十年代开始,到现在语音识别技术有了长足的发展,移动终端设备的发展迫使人们把语音识别实验室技术引入到生活中。 本系统基于科大讯飞的MSC,采取面向对象的的方法,以统一建模语言(UML)为分析设计语言,对系统进行分析与设计。通过设计Android语音助手,旨在帮助用户更好的与机器交互,并且通过使用“语音“这个生活中直接存在的交流沟通方式来帮助用户改善生活方式和习惯,让用户拥有一个可对话的语音助手。本系统针对可行性研究,需求分析,概要设计,详细设计以及系统测试等情况进行了详细介绍。通过合理的模块划分,该系统实现了语音语义识别模块,播放音乐模块,打电话、发短信模块,地图模块,查询模块,语音合成模块。系统明确了各模块的分工,降低了各模块之间的耦合度,提高模块间的沟通效率。 关键词:语音识别、Android、人机交互、面向对象

Abstract With the development of science and technology, the continuous progress of social civilization, people’s pursuit to life quality is higher and higher. The rise of intelligent mobile phone makes terminal applications become a platform for high-tech. For example, the Siri of Apple applies speech recognition technology to intelligent mobile phones, which has triggered the boom of human-computer interaction speech recognition technology. Compared with such input devices as keyboard and mouse, voice is the most direct and effective communication way and the most natural input way. Speech recognition technology has been developed a lot since the 50s of last century. Also, with the development of mobile terminal devices, laboratory speech recognition technology has been introduced to daily life. Based on the MSC of iFLYTEK, this system is analyzed and designed through object-oriented method with unified modeling language (UML). The Android speech assistant is aimed to help users for better human-computer interaction and to improve users’ lifestyles and habits through voice—the direct communication way in our life. It allows users to have a communicable speech assistant. This system introduces such cases as feasibility study, requirement analysis, preliminary design, detailed design and system test in detail. Through reasonable module division, it reduces the coupling degree and improves the communication efficiency among modules with clear module division by implementing speech and semantic recognition module, music-play module, phone-call and SMS module, map module, query module and speech synthesis module. Keywords: speech recognition, android, human-computer interaction, object-oriented

语音识别为文字:Google,微软,科大讯飞的语音识别引擎对比 学习路线:https://https://www.doczj.com/doc/cf5266268.html,/qq_36330643/article/details/80077771 使用外部知识库——tf-idf,还可以加上词语出现的位置进行权重增幅。(推荐) 不使用外部知识库——主要根据文本本身的特征去提取:比如在文本中反复出现且 关键词附近出现关键词的概率非常大,因此就有了TextRank算法。(实现包括FudanNLP和SnowNLP)。类似于PageRank算法;ICTCLAS则是从另外一个思路出发,即一个词如果是关键词那么它反复出现并且左右出现不同的词语的概率非常高。即左右熵比较高。 关键词抽取也可以分为两种: 1.仅仅把词语抽取出来,实现较简单,比如:FundanNLP、jieba、BosonNLP、SnowNLP。 2.连词和短语一起抽取出来,这个还需要增加短语抽取这一步骤,实现如:ICTCLAS、ansj_seg等,可以把类似于“智能手机”、“全面深化改革”、“非公有制经济”这些短语抽取出来。(对于聚类或者分类来说,很明显短语比词语更有价值) 词性标注:(Part-of-speech Tagging, POS)是给句子中每个词一个词性类别的任务。这里的词性类别可能是名词、动词、形容词或其他。python jieba库在执行cut函数之后,完成了分词并进行了词性标注任务。 语义角色标注(Semantic Role Labeling, SRL) 是一种浅层的语义分析技术,标注句子中某些短语为给定谓词的论元(语义角色) ,如施事、受事、时间和地点等。其能够对问答系统、信息抽取和机器翻译等应用产生推动作用。

开源TTS/语音合成和处理工具 1.eSpeak-Chinese eSpeak-Chinese是一个TTS软件。它是基于Jonathan Duddington 的eSpeak,由于中文词典太大,eSpeak缺省并不带中文词典,需另外下载。发布 eSpeak-Chinese只是为了方便用户安装。 国语支持的主要贡献者: ?Kyle Wang (waxaca at https://www.doczj.com/doc/cf5266268.html,) –创建了最初的字典,规则和声音文件。 ?Silas S. Brown (https://www.doczj.com/doc/cf5266268.html,/ssb22/) - 改进词典(加入CEDICT等). 粤语支持的主要贡献者: ?黄冠能 - 创建了粤语字典,简易的规则和声音文件。 eSpeak-Chinese是eGuideDog项目的重要组成部分。另一个中文TTS(余音)在开发中。它在设计上更简易但文件较大。由于使用了真人发声,它比eSpeak的声音更自然。目前它只支持粤语。 2.Flite Flite是一个小型、快速的TTS系统,是著名的语音合成系统festival的c版本。可用于嵌入式系统 3.FreeTTS FreeTTS 是完全采用 Java 开发的语音合成系统,它是卡内基梅隆大学基于Flite 这个小型的语音合成引擎开发的。 FreeTTS是一个语音合成系统写的JavaTM编程语言完全。它是根据Flite公司:一个小运行时语音合成引擎卡内基梅隆大学的发展。弗莱特来源于节语音合成系统,从爱丁堡大学和卡内基梅隆大学的festvox项目。这种FreeTTS版本包括:*核心语音合成引擎*支持的多寡:邻一8kHz的双音子,男,美国英语语音办公16KHz的双音子,男,美国英语语音办公16KHz的有限域,男*美国英语语音的festvox的进口(美国英语的声音只)*对进口的festvox(仅限美式英文)*支持工具中央结算系统的MBROLA北极的具体支持,支持的声音声音(单独下载):办公自动化16KHz的女性,美国英语语音O 2个16KHz的男性声音*美国英语为JSAPI 1.0 *广泛的API文档部分支持*几个演示应用 4.eSpeak eSpeak是一个紧凑的开放源码软件的语音合成器为英语和其他语言,为Linux 和Windows 。

科大讯飞的商业模式分析 曾令斌 天闻数媒科技(北京)有限公司 2014年9月

目录 〇、总结与思考 (1) 1、科大讯飞的主要业务逻辑 (1) 2、在教育领域,借力刚性需求及全国性主管机构的力量蓄积势能 (1) 3、善于构建利益共同体 (2) 一、公司基本信息 (2) 二、公司业务 (3) (一)语音支撑软件 (5) 1、向龙头企业提供语音开发能力 (5) 2、为移动互联网创业者和用户提供语音开发及服务能力 (5) (二)行业应用产品/系统 (5) 1、教育领域 (6) (1)课堂教学产品 (6) A、“在线课堂”系统 (6) B、畅言交互式多媒体教学系统: (6) C、畅言智能语音(双语)教具系统 (7) D、畅言教师机 (7) (2)畅言教育资源云服务平台 (8) (3)智能考试产品 (8) A、讯飞启明标准化考场解决方案 (8) B、讯飞启明网上阅卷系统 (8) C、讯飞启明招生考试管理平台 (8) D、国家普通话水平智能测试系统 (8) E、英语听说智能测试系统 (9) F、中国少数民族汉语水平等级考试系统 (9) G、全国音乐等级考试智能模拟测试系统 (9) (4)学习产品 (9) A、大学校园学习产品 (9) B、中小学校园学习产品 (9) C、互联网模考学习产品 (9) F、移动学习产品APP (10)

(5)教育评价-畅言教育评价系统 (10) (6)智能早教玩具 (11) (7)解决方案 (11) A、区域资源公共服务平台综合解决方案 (11) B、依托"讯飞教育云"的数字校园综合解决方案 (11) C、大规模听说考试与教学一体化平台 (11) 2、智能家电领域 (11) 3、车载领域 (12) 4、智能客服 (12) 5、音乐增值业务 (13) 6、移动互联领域 (13) (三)信息工程与运维业务 (13) (四)教育教学 (14) 三、重要的合作伙伴 (14) (一)政府主管部门 (14) (二)行业龙头企业 (15) 1、电信、金融机构、家电、汽车、电子消费品等企业 (15) 2、传媒集团 (15) 3、主流教材机构 (16) (三)移动互联开发者 (16) 四、核心资源 (16) (一)语音技术 (16) (二)语音数据资源库 (17) (三)人才资源 (17) (四)政府资源 (17) (五)合作伙伴资源 (18) 五、关键业务 (18) (一)核心技术与应用的开发与优化 (18) (二)关系建立与维护 (18) (三)语音技术国际评比 (18) 六、结语 (19)

科大讯飞产品分析报告-V1.0

科大讯飞语音云产品分析报告

系统架构 ............................ (5) 2.1网 络 拓 扑 图 5 22系 统 功 能 图 6 丿品功能 .... (7) 产品优势 .... (7) 4.1用 户 方 7 42开 发 方 8 相关产品介绍 (8) 5.1讯 飞 ______ 占 8 5.1.1 概 _述 8 5.1.2 能 介 绍 8 5 21 ■飞 输- 入— 法 目录 2 3 4 5

521概 10 5.2.2功能介绍 11 5.3讯________ 飞__________ 口讯 61^ __________ 营__________ 模 _________ 式 12 6.2可_____ 行_______ 性 ______ 分______ 析 12 6.2.1 产______ 品 _______ 推 _______ 广1概述 在传统通信计算模式下,语音的处理方式多是通过单个通信终端完成,例如我们熟悉的手机等通信终端;在云计算技术背景下,语音的格式转换、辨别等操作完全在“云”端执行。 语音云,就是采用云计算的方式来执行语音操作,利用云速度快,准确度高的特

性,实现快速的语音应用。 关注语音云的厂商主要有安徽“科大讯飞”公司和北京“云知声”。 科大讯飞的语音云 MSP(iFLY Mobile Speech Platform )在10年十月举行发布会。通过MSP移动互联网的终端用户可以随时随地的使用语音服务。 产品介绍 2系统架构 2.1 网络拓扑图

MSP 系统部署在互联网上,通过运营商的三网接入,无论是传统的互联网终 端还是移动互联网终端都能够通过网络获得语音服务。 MSP 在互联网上建立多个 云服务中心,每个服务中心能够独立提供稳定的互联网语音服务,云服务中心 之间自动同步数据。通过这种机制,用户可以获得高度可用、流畅的语音功能 支持 2.2 系统功能图 上图蓝色区域为MSP 系统的实现范围,浅色区域是与 MSP 密切相关的组件 .ffi 1 餉倜户 乂 丫 *钳用戶 . GPRSAD6E 口联.風电职'.苑 曰茁 耐期□志 卿a 価耳 fl 乩一恤IR ftnfl 户 蓋曲人貝 住为■茹忻人 fl JL 方甘出 M^INX-Fail 匚 :T 詰音阪 宾门㈡劇尊 屋㈣埠 加 drm 曲珅 m bivVKX 'A 1 U/MTK/CNV J?V A JSPHWtT 戦 買卉铠打帕I 出 Wirtdduvc, UtiuJt SoUrk 程欝器攔压的

Computer Science and Application 计算机科学与应用, 2018, 8(7), 1053-1064 Published Online July 2018 in Hans. https://www.doczj.com/doc/cf5266268.html,/journal/csa https://https://www.doczj.com/doc/cf5266268.html,/10.12677/csa.2018.87117 The Design and Implementation of a Malay Speech Synthesis System Meifang Shi, Haoran Feng, Jian Yang* School of Information Science and Engineering, Yunnan University, Kunming Yunnan Received: Jun. 29th, 2018; accepted: Jul. 10th, 2018; published: Jul. 17th, 2018 Abstract Malay is widely used in Malaysia, Singapore and other Southeast Asian countries. Currently, there are about 200 million people using Malay. This paper studies the front-end text analysis method of Malay speech synthesis system, and the back-end speech synthesis method based on HMM. In front-end text analysis and processing, the collection and selection of Malay language data, text normalization, and automatic syllable division were researched and implemented; In the back-end speech synthesis section, the Malay Phonetic list determination, text annotation, context attributes and problem set design, HMM acoustic model training, and speech waveform generation were studied and implemented. Experimental results show that the front-end text analysis and processing method proposed and implemented in this paper can fulfil the requirements of back-end speech synthesis. The back-end speech synthesis system constructed in this paper can synthesize a complete Malay sentence. Keywords Malay Language, Speech Synthesis, Hidden Markov Model, Text Analysis, Acoustic Model 马来语语音合成系统的设计与实现 施梅芳,冯浩然,杨鉴* 云南大学信息学院,云南昆明 收稿日期:2018年6月29日;录用日期:2018年7月10日;发布日期:2018年7月17日 摘要 马来语广泛使用于马来西亚、新加坡等东南亚国家,目前使用人数约有2亿多人。本文研究马来语语音*通讯作者。

科大讯飞深度研究报告:良工心磨砺,静听春江暖 i投资(微信号:itouzi8)“VIP会员俱乐部”旨在搭建专业的产业链研究社群。通过汇集产业专家、行业分析师、PE/VC、上市公司及实业高管和职业投资人,一起进行深入、全面、前瞻性的产业链研究,发掘股权、股票市场的投资机会。申请加入VIP方法:请加小i个人微信,微信号:itouzi6,加入时请标注:vip+姓名+公司+职位+手机 作者:长城证券周伟佳 投资建议: 在苹果发布SIRI三年后的今天,语音行业愈发成熟,语音应用遍地开花,互联网语音门户的盈利模式逐渐成形。$科大讯飞(SZ002230)$在这3年里,证明了自己的技术实力与市场能力,确立了中文语音门户霸主地位,同时取得了财务增长。在进一步优化了股权结构之后,讯飞将再次起飞。预计公司2014年至2016年EPS为0.55/0.89/1.42元,对应PE51/31/20倍,首次覆盖,强烈推荐。 投资要点: 股权结构合理确保长期增长:近期公司增加科大控股与胡宏伟先生为公

司一致行动人,合计持股达到总股本20.95%,高持股比例确保公司高管有足够动力。公司第二期授予的股票期权的行权价格为29.88元,接近现价,彰显公司信心。 行业门槛不断抬高:语音技术已经脱离了小打小闹的年代,需要大量的资金和人力的投入。讯飞依托中科大的学术实力和人力资源供给,拥有强大的研究团队。同时拥有多项业内唯一的产业资源,如国家863产业化基地、发改委“语音高技术产业化示范工程”、语音技术标准牵头制定单位等,享有“语音技术国家队”的政策待遇。可以说,讯飞将行业门槛提升到一个新的高度。 技术实力一统江湖:公司在中文语音行业积累了十几年,在普通话测评、呼叫中心,及语音云上亿用户中积累了大量的语音数据,对不常用语如专业用语和方言等等识别率逐步提高,难以复制。目前市场上其它中文语音相关公司,很多是讯飞的旁支,也有在讯飞系统上进行二次开发,真正的能与讯飞匹敌的对手,尚未出现。 语音应用遍地开花结果:行业应用上,在电信级语音平台业务具有垄断地位,在教育领域称霸语音教具和口语测评,在国安公安领域承建声纹库和声纹处理服务器。在互联网领域,公司把控了智能电视、OTT、国产智能机、嵌入式软件、车载、可穿戴和智能家居等等软硬件产品的语音入口。 估值略贵但值得拥有:在互联网入口尚未完全产生效益的情况下,公司仅凭现有电信、教育等业务,即可实现50%左右的增长,估值水平会迅速回落。更有互联网创新盈利模式储备,强烈推荐。

2019年智能语音行业科大讯飞分析报告 2019年9月

目录 一、智能语音龙头,攀登人工智能新高地 (5) 1、人工智能国家队,技术实力超群 (5) 2、持续加大技术投入,产品落地速度加快 (7) 8 3、公司管理层履历出色 ........................................................................................ 4、多次股权激励助力公司增加凝聚力 (9) 二、打造“智能语音+人机交互”顶级生态,AI进入落地元年 (10) 1、AI上升为国家意志,五大国家级AI创新平台担负历史使命 (10) 2、AI投融资趋于理性,变现能力成为关注重点 (15) 三、AI智慧中枢平台,技术实力冠绝全球 (18) 1、“平台赋能+赛道下沉”打造多层次人工智能产业生态 (18) (1)整合多年技术成果,铸就人工智能生态平台 (18) (2)基于自主可控核心技术,持续推进“平台+赛道”战略 (19) (3)讯飞开放平台开发者持续增加,应用生态逐步完善 (20) (4)讯飞开放平台打造一站式智能交互服务 (20) 2、讯飞AI技术登顶世界之巅 (21) 3、iFLYOS 2.0争做AIoT时代的Android (23) 4、探索认知智能边际,讯飞获批认知智能国家重点实验室 (25) 四、消费者业务异军突起,公司AI落地速度加快 (27) 1、讯飞输入法雄踞国内第三方输入法市场满意度冠军 (29) 2、讯飞翻译机热度持续升高,翻译服务次数破5亿次 (31) 3、讯飞录音笔语音识别能力超群 (33) 4、讯飞学习机发布,探索智慧教育落地新途径 (34)

龙源期刊网 https://www.doczj.com/doc/cf5266268.html, 科大讯飞:听见中国智能语音技术最强音 作者:杨玄章 来源:《大学生》2017年第05期 新生报到季,某校刚刚入学的新同学没有像以往一样领到厚厚的一本新生指南,取而代之的是一个叫“新生助手”的小盒子或者手机“小马甲”。在这个陌生的环境下,这个“新生助手”就成为了同学们融入校园生活最可靠的伙伴了。 语音技术进校园 “哪里可以买到便宜的洗漱用品?”新生小贾刚刚把行李放下,就要买必备的生活用品了。 “小助手”回答道:“学校周边步行范围内有两个超市,一个物美超市在南门外面的学府街2号,一个是学生超市在学校的二食堂边上。您是要买牙刷、牙膏和毛巾么?请选择一下吧。”这时,在智能设备的屏幕上,展现了这两个超市的地图,同时把小贾可能要买的东西在这两个超市的价格都罗列在下面。 小贾很高兴地说道:“好啊,就这几个东西吧,我想从学校里的学生超市买这几样。给我送到宿舍来吧。” “好的,”接到了小贾的指示,“小助手”直接下了单,“东西会在30分钟之后送达。另外,今天是新学期第一天,你要不要去校园里看看呢?” 小贾问道:“去哪里看好呢?新学期学校应该有什么活动吧?” “小助手”依次列出了今天学校所有的活动和地点:“10点到17点,北门小树林有各个社团的招新活动;10点到11点,我的朋友S博士会介绍学校的智能授课评估系统……” “这个智能授课要去听,据说以后我们的课堂综合评分,都是由这个智能语音系统来完成的。”同宿舍的小于在旁边忍不住插嘴。 “好啊!那就帮我们订两个座位吧,我们10点去参加S博士的演讲。”小贾说。 几秒钟后,“小助手”在其上方投射出一个报告厅的全息座位图,其中有两个座位高亮显示:“定好了!你们的座位在在H21和H23。报告厅离宿舍不远,我已经把路线图推送到你们的手机上了。” 小贾和小于顺着地图的指引,刚刚来到报告厅门口,“小助手”先跳出来和“S博士”打招呼了:“S博士你好,这是新生小贾和小于,今天来学习智能授课评估系统。”

讯飞语音合成系统的使用方法 大家都知道,语音识别模块没有思考的能力,更加不会听懂人说的话或者自动的回答问题。模块具有问答能力是因为“答”的语音是人事先录制好并且存放进了SD卡中的,然后模块识别到人说话的内容便自动的播放出对应的语音,也就是说答案是早早就准备好的。那么,模块“回答”的语音文件是要用户事先录制好再存放到SD卡中的。目前,制作这个语音文件一般通过下面两种方式: 1.用户自己用电脑通过咪头人工录制。 2.用语音合成软件自动合成(例如:讯飞语音合成系统)。 第1种方法做出来的语音文件效果最好,发音自然,但是做起来比较麻烦,经常更换语音就体现了工作量之大了。 第2种方法做出来的语音文件效果不太理想,发音比较生硬,但是因为做起来比较方便,是大多数人采用的一种方式。 下面将向大家介绍讯飞语音合成系统的使用方法(安装方法请参考《讯飞语音合成系统安装方法.doc》): 1.点击“开始”---“所有程序”---“科大讯飞”---InterPhonic 5.0---“合成演示 程序”打开讯飞语音合成系统。

2.选择一个语音库,我这里选择“小宇”,再输入一个你要转换成语音输出的 句子。 3.选定句子(按住鼠标左键不放,从句子的开始拉到结尾,然后松手。或者按 键盘的Ctrl+A全选。)

4.点击播放键(或者按F5键)可以试听效果,如果不满意可以再修改。有时候 语气并不符合要求,听起来很别扭,我们可以通过用同音词来修改,例如“为” 字,读起来不太好听,我们可以用“胃”字去代替,这些技巧大家多点锻炼 就能找出诀窍了。

5.修改句子知道试听效果满意之后就可以导出XXXX.WAV语音文件了。

2019年国内领先的智能语音技术软件企业科大讯飞的商业模式及核心竞争力研究

目录 投资案件 (4) 投资评级与估值 (4) 关键假设点 (4) 有别于大众的认识 (4) 股价表现催化剂 (5) 核心风险提示 (5) 一、行业分析 (6) (一)规模:人工智能语音识别技术成熟,落地前景广阔 (6) (二)产业链:人工智能基础应用技术提供商是核心力量 (9) (三)影响因素:落地领域需求旺盛、国家政策支持 (10) 二、公司概述 (13) (一)公司简介 (13) 1、国内领先的智能语音技术软件企业 (13) 2、商业模式 (14) 3、国内竞争企业对比 (15) (二)公司核心竞争力: (15) 1、科技研发投入较大,核心技术成果斐然 (15) 2、客户优势明显 (17) 三、财务假设和盈利预估 (20) 图表目录 图表1:全球人工智能市场规模和增长率 (6) 图表2:2018全球人工智能企业分布国家情况 (6) 图表3:中国人工智能市场规模和增长率 (6) 图表4:人工智能三个发展阶段 (7) 图表5:2018中国人工智能企业基础应用技术分布 (7) 图表6:全球人工智能语音应用市场规模 (7) 图表7:2018全球智能语音厂商市场占有率 (7) 图表8:中国人工智能语音应用市场规模 (8) 图表9:2018下半年中国人工智能语音应用市场结构 (8) 图表10:全球智能语音识别错误率 (8) 图表11:全球主要头部厂商的语音互动产品 (9) 图表12:部分智能语音应用落地场景 (9) 图表13:人工智能产业链 (10) 图表14:全球智能手机中配备智能语音设备的比例 (10) 图表15:中国可穿戴市场规模和增长率 (10) 图表16:中国教育信息化投入 (11)

本科生毕业论文 题目:单片机语音合成系统的设计 院系:物理与电子工程学院 专业:电子信息工程 学生姓名:胡立 学号:07128003 指导教师:李文联 2011年4月

单片机语音合成系统的设计 摘要:语音合成技术是实现人机语音通信,建立一个有听说能力的口语系统所必需的关键技术之一。随着计算机运算速度的提高,人工智能领域的研究获得了飞速发展,而人工智能领域的最新研究成果不断地向语音研究渗透,促使语音处理技术及语音合成的研究也产生了突破性的飞跃。和语音识别相比,语音合成技术相对要成熟一些,是该领域中近期最有希望产生突破并形成产业化的一项技术。介绍一个以语音合成系统为主电路,在单片机89C51的管理下,用软件编程并通过串行口编程进行通信,产生不同定时来准确地控制乐曲节奏,最终实现蜂鸣器唱歌的过程。此通用合成语音系统能根据需要利用多种语音压缩算法无缝地混合配合,用以优化语音质量和存储容量。此设计使人们能够甩掉键盘,通过语音命令进行操作。系统在完成其它任务的同时具备语音输出功能,可使单片机系统成本下降,体积减小,可靠型提高。它对于解脱繁琐的事物性和危险性工作更具有意义。 关键词:89C51单片机;语音压缩算法;语音合成;蜂鸣器

Design Of SCM Speech Synthesis System Abstract:Speech synthesis technology is a human-computer voice communication, listening and speaking ability to establish an oral system one of key technologies required. With the increase in computing speed, artificial intelligence research in the field has made a rapid development, the latest in artificial intelligence research studies continue to penetrate to the voice, speech processing technology and to promote the research of speech synthesis created a breakthrough leap. And voice recognition compared to speech synthesis technology is relatively mature, is the most promising areas of recent breakthroughs in production and the formation of a technology industrialization. Describes a speech synthesis system, the main circuit, under the management of the 89C51 microcontroller, software programming and programming through the serial port to communicate, have different time to accurately control the rhythm of music, and ultimately the process of singing buzzer. The general synthetic speech systems as needed using a variety of voice compression algorithms seamlessly mixed with, to optimize voice quality and storage capacity. This design allows people to get rid of the keyboard, through voice commands to operate. System to complete other tasks at the same time with voice output, SCM systems can lower costs, reduce size, improve reliability type. It complicated things for free and dangerous work more meaningful. Key words: 89C51SCM;Pronunciation compression algorithm;Speech synthesis; Buzzer