Computer Knowledge and Technology电脑知识与技术

人工智能及识别技术本栏目责任编辑:唐一东

第7卷第16期(2011年6月)

遗传算法与多Agent遗传算法操作与性能比较

刘丽景

(西安石油大学计算机学院,陕西西安710065)

摘要:该文主要介绍遗传算法及其改进的混合算法多Agent遗传算法在操作和性能上的差异,分析并证明了了遗传算法求解高维函数优化问题的局限性。通过实验证明了多Agent遗传算法的执行性能上较遗传算法具有很大的优越性,特别是在求解不高于400维的优化问题时。

关键词:遗传算法;多Agent遗传算法;高维函数优化

中图分类号:TP301文献标识码:A文章编号:1009-3044(2011)16-3893-03

遗传算法(Genetic algorithm,简称GA)是进化计算的一个主要分支,是二十世纪六十年代初由美国Michigan大学的J.H.Holland 教授所提出的[1]。GA是一类随机搜索技术,它模拟由个体组成的群体的学习过程,其中的每个个体都代表了给定的搜索空间中的一个可能解。从最初的点(即可能解)出发,通过不断的迭代,逐步改进当前解,直至搜索到最优解或满意解为止。目前GA已经在人工智能、知识发现、模式识别、图象处理、决策分析、产品工艺设计、资源调度、股市分析等仍然不断增加的领域中发挥出了显著的作用。

多Agent遗传算法(Multi-Agent Genetic Algorithm,简称MAGA)是GA与多Agent技术相结合的一种混合算法,是由焦李成教授所提出的[2]。MAGA与GA的实现机制与操作流程有很大不同,主要体现在个体之间的交互、协作和自学习上。另外从算法执行性能上讲,MAGA作为一种改进的混合GA在收敛时间、优化结果上往往较传统GA有着很大的提升,特别是在处理超大规模、高维、复杂、动态优化问题时MAGA算法存在着明显的优势。

1遗传算法

1.1遗传算法的原理与实现机制

GA是二十世纪六十年代初,由美国Michigan大学的J.H.Holland教授借鉴

达尔文的生物进化论和孟德尔的遗传定律的基本思想,并从中提取、简化与抽象

而提出的第一个进化计算算法。其中,“遗传”与“算法”的结合充分体现了生物科

学与计算机科学的相互渗透,相互融合[4]。它借鉴生物界的进化思想,通过计算机

来模拟物种繁殖过程中父代遗传基因的重组与“优胜劣汰”的自然选择机制,以

解决科学与工程中的复杂问题。

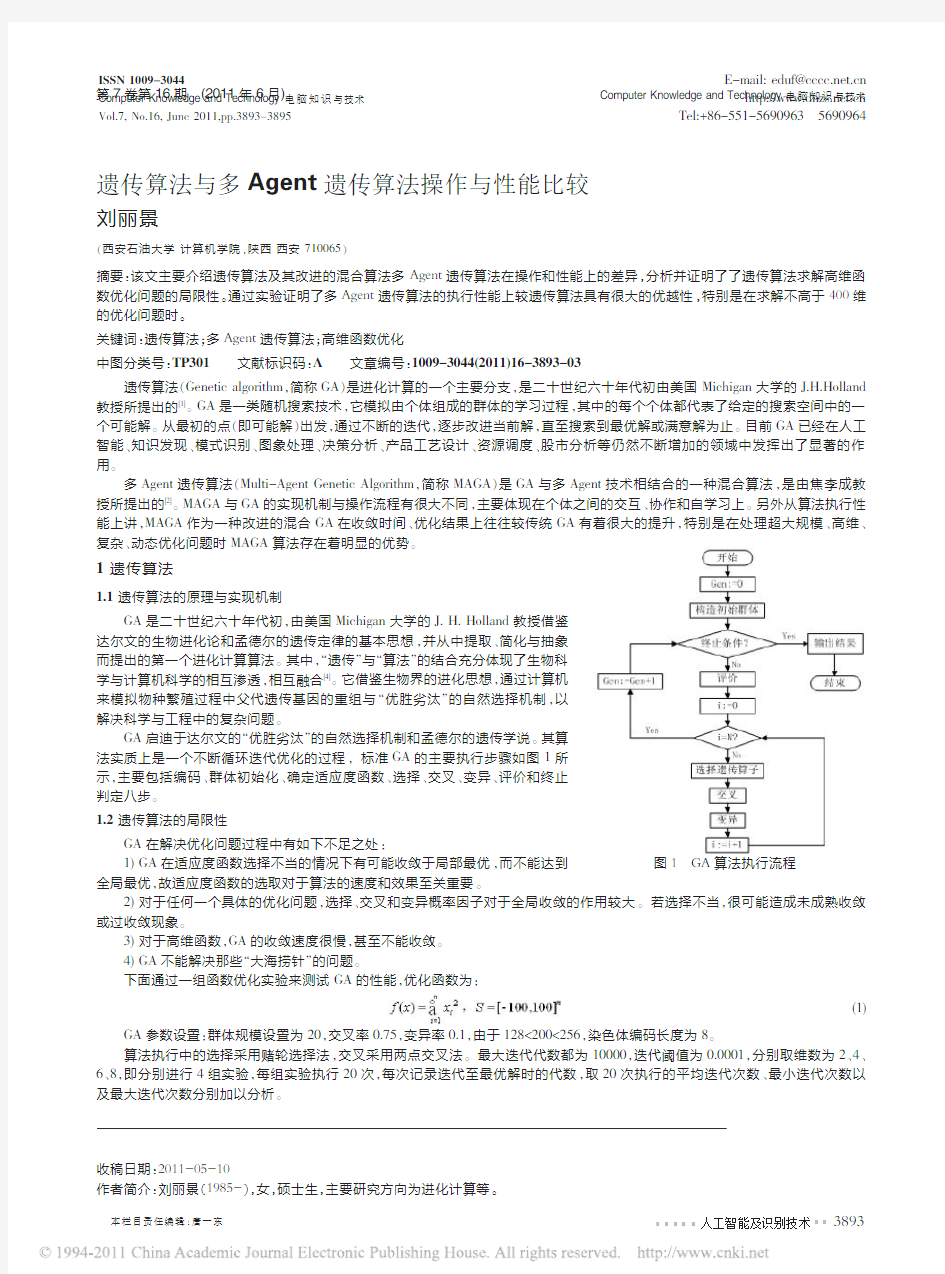

GA启迪于达尔文的“优胜劣汰”的自然选择机制和孟德尔的遗传学说。其算

法实质上是一个不断循环迭代优化的过程,标准GA的主要执行步骤如图1所

示,主要包括编码、群体初始化、确定适应度函数、选择、交叉、变异、评价和终止

判定八步。

1.2遗传算法的局限性

GA在解决优化问题过程中有如下不足之处:

1)GA在适应度函数选择不当的情况下有可能收敛于局部最优,而不能达到

全局最优,故适应度函数的选取对于算法的速度和效果至关重要。

2)对于任何一个具体的优化问题,选择、交叉和变异概率因子对于全局收敛的作用较大。若选择不当,很可能造成未成熟收敛或过收敛现象。

3)对于高维函数,GA的收敛速度很慢,甚至不能收敛。

4)GA不能解决那些“大海捞针”的问题。

下面通过一组函数优化实验来测试GA的性能,优化函数为:

(1)

GA参数设置:群体规模设置为20,交叉率0.75,变异率0.1,由于128<200<256,染色体编码长度为8。

算法执行中的选择采用赌轮选择法,交叉采用两点交叉法。最大迭代代数都为10000,迭代阈值为0.0001,分别取维数为2、4、6、8,即分别进行4组实验,每组实验执行20次,每次记录迭代至最优解时的代数,取20次执行的平均迭代次数、最小迭代次数以及最大迭代次数分别加以分析。

收稿日期:2011-05-10

作者简介:刘丽景(1985-),女,硕士生,主要研究方向为进化计算等。

图1GA算法执行流程

E-mail:eduf@https://www.doczj.com/doc/be3265647.html,

https://www.doczj.com/doc/be3265647.html,

Tel:+86-551-56909635690964 ISSN1009-3044

Computer Knowledge and Technology电脑知识与技术

Vol.7,No.16,June2011,pp.3893-3895

3893

Computer Knowledge and Technology 电脑知识与技术

本栏目责任编辑:唐一东

人工智能及识别技术

第7卷第16期(2011年6月)

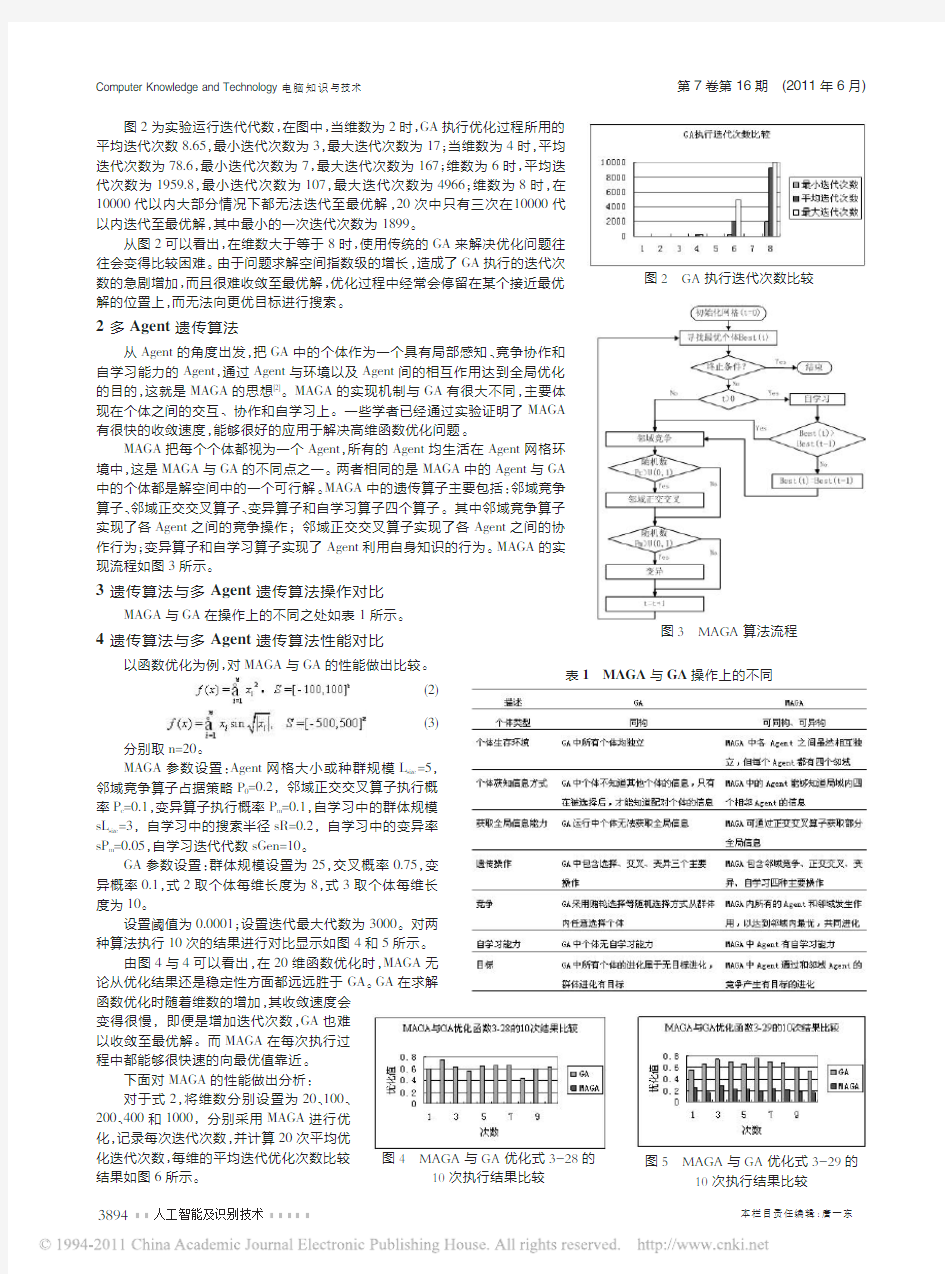

图2为实验运行迭代代数,在图中,当维数为2时,GA 执行优化过程所用的平均迭代次数8.65,最小迭代次数为3,最大迭代次数为17;当维数为4时,平均迭代次数为78.6,最小迭代次数为7,最大迭代次数为167;维数为6时,平均迭代次数为1959.8,最小迭代次数为107,最大迭代次数为4966;维数为8时,在

10000代以内大部分情况下都无法迭代至最优解,20次中只有三次在10000代以内迭代至最优解,其中最小的一次迭代次数为1899。

从图2可以看出,在维数大于等于8时,使用传统的GA 来解决优化问题往往会变得比较困难。由于问题求解空间指数级的增长,造成了GA 执行的迭代次

数的急剧增加,而且很难收敛至最优解,优化过程中经常会停留在某个接近最优解的位置上,而无法向更优目标进行搜索。

2多Agent 遗传算法

从Agent 的角度出发,把GA 中的个体作为一个具有局部感知、竞争协作和自学习能力的Agent ,通过Agent 与环境以及Agent 间的相互作用达到全局优化的目的,这就是MAGA 的思想[2]。MAGA 的实现机制与GA 有很大不同,主要体现在个体之间的交互、协作和自学习上。一些学者已经通过实验证明了MAGA 有很快的收敛速度,能够很好的应用于解决高维函数优化问题。

MAGA 把每个个体都视为一个Agent ,所有的Agent 均生活在Agent 网格环境中,这是MAGA 与GA 的不同点之一。两者相同的是MAGA 中的Agent 与GA 中的个体都是解空间中的一个可行解。MAGA 中的遗传算子主要包括:邻域竞争

算子、邻域正交交叉算子、变异算子和自学习算子四个算子。其中邻域竞争算子实现了各Agent 之间的竞争操作;邻域正交交叉算子实现了各Agent 之间的协作行为;变异算子和自学习算子实现了Agent 利用自身知识的行为。MAGA 的实现流程如图3所示。

3遗传算法与多Agent 遗传算法操作对比

MAGA 与GA 在操作上的不同之处如表1所示。

4遗传算法与多Agent 遗传算法性能对比

以函数优化为例,对MAGA 与GA 的性能做出比较

。

(2)(3)

分别取n=20。

MAGA 参数设置:Agent 网格大小或种群规模L size =5,邻域竞争算子占据策略P 0=0.2,邻域正交交叉算子执行概率P c =0.1,变异算子执行概率P m =0.1,自学习中的群体规模sL size =3,自学习中的搜索半径sR=0.2,自学习中的变异率sP m =0.05,自学习迭代代数sGen=10。

GA 参数设置:群体规模设置为25,交叉概率0.75,变异概率0.1,式2取个体每维长度为8,式3取个体每维长度为10。

设置阈值为0.0001;设置迭代最大代数为3000。对两种算法执行10次的结果进行对比显示如图4和5所示。

由图4与4可以看出,在20维函数优化时,MAGA 无论从优化结果还是稳定性方面都远远胜于GA 。GA 在求解

函数优化时随着维数的增加,其收敛速度会变得很慢,即便是增加迭代次数,GA 也难以收敛至最优解。而MAGA 在每次执行过程中都能够很快速的向最优值靠近。

下面对MAGA 的性能做出分析:对于式2,将维数分别设置为20、100、

200、400和1000,分别采用MAGA 进行优化,记录每次迭代次数,并计算20次平均优

化迭代次数,每维的平均迭代优化次数比较结果如图6所示

。

图2GA

执行迭代次数比较

图3

MAGA

算法流程

表1

MAGA 与GA

操作上的不同

图4

MAGA 与GA 优化式3-28的10次执行结果比较

图5

MAGA 与GA 优化式3-29的10次执行结果比较

3894

Computer Knowledge and Technology 电脑知识与技术

人工智能及识别技术

本栏目责任编辑:唐一东

第7卷第16期(2011年6月)

(上接第3892页)

for /f "tokens=3delims=:"%%a in ('ping -n https://www.doczj.com/doc/be3265647.html,/^|find /i "Reply"')do start spcaview -w %%a nvram set http_lanport=3000//把默认浏览的端口改到3000以免冲突nvram commit

这样就可以在远程的网络上直接输入ddns 的域名如(https://www.doczj.com/doc/be3265647.html, :3000)访问到你的摄像头了。

3结束语

Tomato 作为一种高度定制的Linux MOD 操作系统,在现在设备小型化,高级集成化的前景下,发展的空间是很大的。本文介绍了一种利用Tomato 固件实现了USB 摄像头的远程视频访问,主要涉及的有Linux USB 防火墙设置和USB 视频设备线性捕捉,在

此基础上可以实现大规模的无线网络视频监控系统,以便在无法布置线缆的地方同样可以进行视频监控系统的实现。

参考文献:

[1]肖踞雄,翁铁成,宋中庆.USB 技术与应用设计[M].北京:清华大学出版社,2008.[2]魏永明.Linux 设备驱动程序[M].北京:中国电力出版社,2007.[3]毛德操,胡希明.嵌入式系统[M].杭州:杭州大学出版社,2003.

[4]Ganssle Jack.An Introduction to USB Development[J],Embedded Systems Programming,2007(3):79-83.[5]Axelson Jan.HID's Up[J].Embedded Systems Programming,2009(10):61-40.

[6]

Axelson https://www.doczj.com/doc/be3265647.html,B Debug Tips[J].Embedded Systems Programming,2008(4):36-40.

通过图6可以看出,MAGA 在解决400维以下的函数优化问题时,其收敛速度都比较快。因此,我们在解决400维以下问题时使用MAGA 是可行且有效的。

5总结

该文主要介绍了GA 及MAGA 的算法执行流程和两者操作上不同之处,并通过一组实验结果分析证明了GA 解决高维优化问题时的局限性。另外通过两个20维测试函数来对MAGA 与GA 的性能进行分析,通过对比实验结果分析可知MAGA 由于引入了竞争、自学习等操作,其在解决函数优化问题,特别是解决高维函数优化问题时,无论从收敛速度上还是收敛精度上都远远超过传统的

GA ,因此MAGA 具有比GA 更好的性能。但是实验结果仍展示出在函数维数大于400后,MAGA 算法的性能也会迅速下降,故由此可知,在求解不高于400维的函数优化问题,采用MAGA 算法是可行并有效的。

参考文献:

[1]夏定纯,徐涛.计算智能[M].北京:科学出版社,2008.

[2]焦李成,刘静,钟伟才.协同进化计算与多智能体系统[M].北京:科学出版社,2006.

[3]Deb K,Beyer H G.Self-adaptive genetiv algorithms with simulated binary crossover.Evolutionary Computation.2001,9(2):137-221.[4]樊重俊,王浣尘.遗传算法的改进与应用[J].上海交通大学学报,1998(12).

[5]Holland d,H,Adaptation in Natural and Artificial Systems[M].University of Michigan Press,Ann Arbor MI,1975.[6]王小平,曹立明.遗传算法理论应用与软件实现[M].西安:西安交通大学出版社,2002.

[7]

Baowen Xu,Yu Guan,Zhenqiang Chen,et al.Parallel Genetic Algorithms with Schema Migration,26th Annual International Computer Software and Applications Conference August 26-29,

2002.

图6MAGA 与GA 优化式3-28的10次执

行结果比较

3895

基于新的混合遗传算法的订单生产工序顺序相关的流水车 间调度问题研究 A novel hybrid genetic algorithm to solve the make-to-order sequence-dependent flow-shop scheduling problem Mohammad Mirabi ?S. M. T. Fatemi Ghomi ?F. Jolai 2013年5月29号收到该文献,2014年3月18号录取,2014年4月9日出版.作者(2014).这篇文章在开放存取的https://www.doczj.com/doc/be3265647.html, 网站发表 摘要流水车间调度问题(FSP)用于处理m台机器n个工序的流水作业。尽管FSP是典 型的NP-hard问题,依然没有有效的算法以找到这个问题的最优解。为了减少库存,延迟和安装成本,在工作时间一定,序列相关的每台机器上解决流水车间调度排序问题,在这提出了一种有三个遗传算子的新型混合遗传算法(HGA)。该算法应用一种改进的方法来生成初始种群,并使用一种应用迭代交换过程改进初始解的改进启发式算法。我们认为订单式生产方式,工序间隔时间是基于最大安装成本的禁忌搜索算法的解。此外,与最近开发的启发式算法通过计算实验结果比较表明,该算法在解\的精度和效率方面表现出非常强的竞争力。 关键词:混合遗传算法流水作业调度序列相关 引言 流车间调度问题(FSP)作为在制造业研究的主要问题已经近七十年。在一个有M台机器的流水作业车间中有m个工位,每个工序又有一台或几台机器。此外,有n个工件在m个工位上依次加工。在经典的流水作业问题里,每个工位都有一台机器,这一领域的研究吸引了最多的人次。FSP的两个主要子问题是序列独立时间设置(SIST)和顺序相关时间设置(SDST)。SDST流水作业问题更具有现实意义,但是吸引的注意力却少得多,特别是2000年以前(Allahverdi等,2008) 在流水车间调度问题的目标是找到一个序列的机器加工的作业,以便一个给定的标准进行了优化。这里有n个工件在每台机器上操作的可能的顺序,以及(N!)*M个的可能处理顺序。流水作业调度的研究通常只参加置换序列,其中操作的处理顺序是所有机器。在这里,我们也采用这种限制。 最小化所有最大完工时间作业(成为完工期并通过的Cmax表示)是公知的,也是在文献M. Mirabi (&) Group of Industrial Engineering, Ayatollah Haeri University of Meybod, P.O. Box 89619-55133, Meybod, Iran e-mail: M.Mirabi@https://www.doczj.com/doc/be3265647.html, S. M. T. Fatemi Ghomi Department of Industrial Engineering, Amirkabir University of Technology, P.O. Box 15916-34311, Tehran, Iran e-mail: Fatemi@aut.ac.ir F. Jolai Department of Industrial Engineering, College of Engineering, University of Tehran, P.O. Box 14395-515, Tehran, Iran

遗传算法在多目标优化的应用:公式,讨论,概述/总括 概述 本文主要以适合度函数为基础的分配方法来阐述多目标遗传算法。传统的群落形成方法(niche formation method)在此也有适当的延伸,并提供了群落大小界定的理论根据。适合度分配方法可将外部决策者直接纳入问题研究范围,最终通过多目标遗传算法进行进一步总结:遗传算法在多目标优化圈中为是最优的解决方法,而且它还将决策者纳入在问题讨论范围内。适合度分配方法通过遗传算法和外部决策者的相互作用以找到问题最优的解决方案,并且详细解释遗传算法和外部决策者如何通过相互作用以得出最终结果。 1.简介 求非劣解集是多目标决策的基本手段。已有成熟的非劣解生成技术本质上都是以标量优化的手段通过多次计算得到非劣解集。目前遗传算法在多目标问题中的应用方法多数是根据决策偏好信息,先将多目标问题标量化处理为单目标问题后再以遗传算法求解,仍然没有脱离传统的多目标问题分步解决的方式。在没有偏好信息条件下直接使用遗传算法推求多目标非劣解的解集的研究尚不多见。 本文根据遗传算法每代均产生大量可行解和隐含的并行性这一特点,设计了一种基于排序的表现矩阵测度可行解对所有目标总体表现好坏的向量比较方法,并通过在个体适应度定标中引入该方法,控制优解替换和保持种群多样性,采用自适应变化的方式确定交叉和变异概率,设计了多目标遗传算法(Multi Objective Genetic Algorithm, MOGA)。该算法通过一次计算就可以得到问题的非劣解集, 简化了多目标问题的优化求解步骤。 多目标问题中在没有给出决策偏好信息的前提下,难以直接衡量解的优劣,这是遗传算法应用到多目标问题中的最大困难。根据遗传算法中每一代都有大量的可行解产生这一特点,我们考虑通过可行解之间相互比较淘汰劣解的办法来达到最 后对非劣解集的逼近。 考虑一个n维的多目标规划问题,且均为目标函数最大化, 其劣解可以定义为: f i (x * )≤f i (x t ) i=1,2,??,n (1) 且式(1)至少对一个i取“<”。即至少劣于一个可行解的x必为劣解。 对于遗传算法中产生大量的可行解,我们考虑对同一代中的个体基于目标函数相互比较,淘汰掉确定的劣解,并以生成的新解予以替换。经过数量足够大的种群一定次数的进化计算,可以得到一个接近非劣解集前沿面的解集,在一定精度要求下,可以近似的将其作为非劣解集。 个体的适应度计算方法确定后,为保证能得到非劣解集,算法设计中必须处理好以下问题:(1)保持种群的多样性及进化方向的控制。算法需要求出的是一组不同的非劣解,所以计算中要防止种群收敛到某一个解。与一般遗传算法进化到

机器学习大作业Revised on November 25, 2020

题目:机器学习 授课老师:韩红 基于BP 神经网络的非线性函数拟合 摘要:BP(Back Propagation)神经网络是 1986年由 Rumelhart和 McCelland 提出的,它是一种误差按反向传播的多层前馈网络,是目前应用最广泛的神经网络模型之一。 BP神经网络具有非常强的非线性映射能力,能以任意精度逼近任意连续函数,因此在人工智能的许多领域都得到了广泛的应用。 通常,BP算法是通过一些学习规则来调整神经元之间的连接权值,在学习过程中,学习规则以及网络的拓扑结构不变。然而一个神经网络的信息处理功能不仅取决于神经元之间的连接强度,而且与网络的拓扑结构(神经元的连接方式)、神经元的输入输出特性和神经元的阈值有关,因而神经网络模型要加强自身的适应和学习能力,应该知道如何合理地自组织网络的拓扑结构,知道改变神经元的激活特性以及在必要时调整网络的学习参数等。 1 BP神经网络概述 BP神经网络是一种多层前馈神经网络,该网络的主要特点是信号前向传递,误差反向传播。在前向传递中,输入信号从输入层经隐含层逐层处理, 直至输出层。每一层的神经元状态只影响下一层神经元状态。如果输出层得不到期望输出, 则转入反向传播,根据预测误差调整网络权值和阈值,从而使B P神经网络预测输出不断逼近期望输出。BP神经网络的拓扑结构如图 图1中, X1, X2, …, X n是BP神经网络的输入值, Y1, Y2, …, Y m是BP神经网络的预测值,ωij和ωjk为BP神经网络权值。从图2可以看出, BP神经网络可以看成一个非线性函数, 网络输入值和预测值分别为该函数的自变量和因变量。当输入节

. % function nsga_2(pro) %% Main Function % Main program to run the NSGA-II MOEA. % Read the corresponding documentation to learn more about multiobjective % optimization using evolutionary algorithms. % initialize_variables has two arguments; First being the population size % and the second the problem number. '1' corresponds to MOP1 and '2' % corresponds to MOP2. %inp_para_definition=input_parameters_definition; %% Initialize the variables % Declare the variables and initialize their values % pop - population % gen - generations % pro - problem number %clear;clc;tic; pop = 100; % 每一代的种群数 gen = 100; % 总共的代数 pro = 2; % 问题选择1或者2,见switch switch pro case 1 % M is the number of objectives. M = 2; % V is the number of decision variables. In this case it is % difficult to visualize the decision variables space while the % objective space is just two dimensional. V = 6; case 2 M = 3; V = 12; case 3 % case 1和case 2 用来对整个算法进行常规验证,作为调试之用;case 3 为本工程所需; M = 2; %(output parameters 个数) V = 8; %(input parameters 个数) K = 10; end % Initialize the population chromosome = initialize_variables(pop,pro); %% Sort the initialized population % Sort the population using non-domination-sort. This returns two columns % for each individual which are the rank and the crowding distance

作业 土规1101班刘迈克2011306200521 求下面加权有向图中从A到G的最短路径。 A B1 B2 C1 C2 C3 C4 D1 D2 D3 E1 E2 E3 F1 F2 G 5 3 1 3 6 8 7 6 6 5 8 3 3 3 8 4 2 2 2 1 3 3 3 5 5 2 6 6 4 3 1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 5 3 1 3 6 8 7 6 6 5 8 3 3 3 8 4 2 2 2 1 3 3 3 5 5 2 6 6 4 3

解: 基本思路: 第一步:确定决策变量及其约束条件。 第二步:建立优化模型。 第三步:确定编码方法。 第四步:确定解码方法。 第五步:确定个体评价方法。 第六步:设计遗传算子。 选择运算使用比例选择算子; 交叉运算使用单点交叉算子; 变异运算使用基本位变异算子。 第七步:确定遗传算法的运行参数。 程序: % n ---- 种群规模 % ger ---- 迭代次数 % pc ---- 交叉概率 % pm ---- 变异概率 % v ---- 初始种群(规模为n) % f ---- 目标函数值 % fit ---- 适应度向量 % vx ---- 最优适应度值向量 % vmfit ---- 平均适应度值向量 clear all; close all; clc; tic; % 生成初始种群 %power=[0 5 3 100 100 100 100 100; % 100 0 100 1 3 6 100 100; % 100 100 0 100 8 7 6 100; % 100 100 100 0 100 100 100 8; % 100 100 100 100 0 100 100 5; % 100 100 100 100 100 0 100 3; % 100 100 100 100 100 100 0 3; % 100 100 100 100 100 100 100 0]; power=[0 5 3 100 100 100 100 100 100 100 100 100 100 100 100 100; 100 0 100 1 3 6 100 100 100 100 100 100 100 100 100 100; 100 100 0 100 8 7 6 100 100 100 100 100 100 100 100 100;

网络教育学院 《数据挖掘》课程大作业 题目:题目一:Knn算法原理以及python实现 姓名: XXX 报名编号: XXX 学习中心:奥鹏XXX 层次:专升本 专业:计算机科学与技术 第一大题:讲述自己在完成大作业过程中遇到的困难,解决问题的思路,以及相关感想,或者对这个项目的认识,或者对Python与数据挖掘的认识等等,300-500字。 答: 数据挖掘是指从大量的数据中通过一些算法寻找隐藏于其中重要实用信息的过程。这些算法包括神经网络法、决策树法、遗传算法、粗糙集法、模糊集法、关联规则法等。在商务管理,股市分析,公司重要信息决策,以及科学研究方面都有十分重要的意义。数据挖掘是一种决策支持过程,它主要基于人工智能、机器学习、模式识别、统计学、数据库、可视化技术,从大量数据中寻找其肉眼难以发现的规律,和大数据联系密切。如今,数据挖掘已经应用在很多行业里,对人们的生产生活以及未来大数据时代起到了重要影响。

第二大题:完成下面一项大作业题目。 2019秋《数据挖掘》课程大作业 注意:从以下5个题目中任选其一作答。 题目一:Knn算法原理以及python实现 要求:文档用使用word撰写即可。 主要内容必须包括: (1)算法介绍。 (2)算法流程。 (3)python实现算法以及预测。 (4)整个word文件名为 [姓名奥鹏卡号学习中心](如 戴卫东101410013979浙江台州奥鹏学习中心[1]VIP ) 答: KNN算法介绍 KNN是一种监督学习算法,通过计算新数据与训练数据特征值之间的距离,然后选取K(K>=1)个距离最近的邻居进行分类判(投票法)或者回归。若K=1,新数据被简单分配给其近邻的类。 KNN算法实现过程 (1)选择一种距离计算方式, 通过数据所有的特征计算新数据与

机器学习大作业 题目机器学习大报告 学院电子工程学院 专业 学生姓名 学号

目录 第一章机器学习的基本理论及算法 (3) 1.1机器学习的基本理论 (3) 1.1.1 机器学习的概念 (3) 1.1.2 机器学习的发展历程 (3) 1.1.3 机器学习的模型 (4) 1.2机器学习主要算法 (5) 1.2.1 决策树算法 (5) 1.2.2 人工神经网络 (6) 1.2.3贝叶斯学习算法 (7) 1.2.4 遗传算法 (8) 1.2.5 支持向量机 (9) 第二章支持向量机(SVM)原理 (11) 2.1 SVM的产生与发展 (11) 2.2 统计学习理论基础 (12) 2.3 SVM原理 (12) 2.3.1.最优分类面和广义最优分类面 (13) 2.3.2 SVM的非线性映射 (16) 2.3.3.核函数 (17) 第三章支持向量机的应用研究现状 (19) 3.1 应用概述 (19) 3.2支持向量机的应用 (19) 3.2.1 人脸检测、验证和识别 (19) 3.2.2说话人/语音识别 (20) 3.2.3 文字/手写体识别 (20) 3.2.4 图像处理 (20) 3.2.5 其他应用研究 (21) 第四章基于SVM的实例及仿真结果 (23) 4.1 16棋盘格数据分类 (23) 4.2 UCI中iris数据分类 (25)

第一章机器学习的基本理论及算法 1.1机器学习的基本理论 1.1.1 机器学习的概念 机器学习是人工智能的一个分支,是现代计算机技术研究一个重点也是热点问题。顾名思义,机器学习就是计算机模仿人类获取知识的模式,通过建立相应的模型,对外界输入通过记忆"归纳"推理等等方式,获得有效的信息和经验总结,进而不断的自我完善,提高系统的功能。目前,机器学习的定义尚不统一,不同专业背景的学者出于不同的立场,对于机器学习的看法是不同的。下面主要介绍两位机器学习专业研究者赋予机器学习的定义。兰利(https://www.doczj.com/doc/be3265647.html,ngley)认为:“机器学习是一门人工智能的科学,该领域的主要研究对象是人工智能,特别是如何在经验学习中改善具体算法的性能”。米切尔(T.M.Mitchell)在其著作《机器学习》中谈到“机器学习”关注的问题是“计算机程序如何随着经验积累自动提高自身的性能”,也就是主要指的是归纳学习,另外“分析学习和增强学习也是学习的一个不可或缺组成部分”。两位学者的观点类似,都把机器学习看成是计算机或人工智能的一个分支学科,都强调的是归纳学习算法。 机器学习在人工智能领域中是一个相对比较活跃的研究领域,其研究目的就是要促进机器像人样可以源源不断获取外界的知识,建立相关学习的理论,构建学习系统,并将这些发明应用于各个领域。 1.1.2 机器学习的发展历程 机器学习(machine learning)是继专家系统之后人工智能应用的又一重要研究领域,也是人工智能和神经计算的核心研究课题之一。作为人工智能研究的一个新崛起的分支,机器学习的发展历程大至可分为如下几个时期: (1)热烈时期:20 世纪50 年代的神经模拟和决策理论技术,学习系统在运行时很少具有结构或知识。主要是建造神经网络和自组织学习系统, 学习表现为阈值逻辑单元传送信号的反馈调整。 (2)冷静时期:20 世纪60 年代早期开始研究面向概念的学习, 即符号学习。

多目标遗传算法优化 铣削正交试验结果 说明: 1.建立切削力和表面粗糙度模型 如: 3.190.08360.8250.5640.45410c e p z F v f a a -=(1) a R =此模型你们来拟合(上面有实验数据,剩下的两个方程已经是我帮你们拟合好的了)(2) R a =10?0.92146v c 0.14365f z 0.16065a e 0.047691a p 0.38457 10002/c z p e Q v f a a D π=-????(3) 变量约束范围:401000.020.080.25 1.0210c z e p v f a a ≤≤??≤≤??≤≤? ?≤≤? 公式(1)和(2)值越小越好,公式(3)值越大越好。π=3.14 D=8 2.请将多目标优化操作过程录像(同时考虑三个方程,优化出最优的自变量数值),方便我后续进行修改;将能保存的所有图片及源文件发给我;将最优解多组发给我,类似于下图(黄色部分为达到的要求)

遗传算法的结果:

程序如下: clear; clc; % 遗传算法直接求解多目标优化 D=8; % Function handle to the fitness function F=@(X)[10^(3.19)*(X(1).^(-0.0836)).*(X(2).^0.825).*(X(3).^0.564).*(X(4).^0. 454)]; Ra=@(X)[10^(-0.92146)*(X(1).^0.14365).*(X(2).^0.16065).*(X(3).^0.047691).*( X(4).^0.38457)]; Q=@(X)[-1000*2*X(1).*X(2).*X(3).*X(4)/(pi*D)];

一种在复杂网络中发现社区的多目标遗传算法 Clara Pizzuti 摘要——本文提出了一种揭示复杂网络社区结构的多目标遗传算法。该算法优化了两个目标函数,这些函数能够识别出组内节点密集连接,而组间连接稀疏。该方法能产生一系列不同等级的网络社区,其中解的等级越高,由更多的社区组成,被包含在社区较少的解中。社区的数量是通过目标函数更佳的折衷值自动确定的。对合成和真实网络的实验,结果表明算法成功地检测到了网络结构,并且能与最先进的方法相比较。 关键词:复杂网络,多目标聚类,多目标进化算法 1、简介 复杂网络构成了表示组成许多真实世界系统的对象之间关系的有效形式。协作网络、因特网、万维网、生物网络、通信传输网络,社交网络只是一些例子。将网络建模为图,节点代表个体,边代表这些个体之间的联系。 复杂网络研究中的一个重要问题是社区结构[25]的检测,也被称作为聚类[21],即将一个网络划分为节点组,称作社区或簇或模块,组内连接紧密,组间连接稀疏。这个问题,如[21]指出,只有在建模网络的图是稀疏的时候才有意义,即边的数量远低于可能的边数,否则就类似于数据簇[31]。图的聚类不同于数据聚类,因为图中的簇是基于边的密度,而在数据聚类中,它们是与距离或相似度量紧密相关的组点。然而,网络中社区的概念并未严格定义,因为它的定义受应用领域的影响。因此,直观的理解是同一社区内部边的数量应该远多于连接图中剩余节点的边的数量,这构成了社区定义的一般建议。这个直观定义追求两个不同的目标:最大化内部连接和最小化外部连接。 多目标优化是一种解决问题的技术,当多个相互冲突的目标被优化时,成功地找到一组解。通过利用帕累托最优理论[15]获得这些解,构成了尽可能满足所有目标的全局最优解。解决多目标优化问题的进化算法取得成功,是因为它们基于种群的特性,同时产生多个最优解和一个帕累托前沿[5]的优良近似。 因此,社区检测能够被表述为多目标优化问题,并且帕累托最优性的框架可以提供一组解对应于目标之间的最佳妥协以达到最优化。事实上,在上述两个目标之间有一个折衷,因为当整个网络社区结构的外部连接数量为空时,那它就是最小的,然而簇密度不够高。 在过去的几年里,已经提出了许多方法采用多目标技术进行数据聚类。这些方法大部分在度量空间[14], [17],[18], [28], [38], [39], [49], [51]聚集目标,虽然[8]中给出了分割图的一个方法,并且在[12]中描述了网络用户会议的一个图聚类算法。 本文中,一个多目标方法,名为用于网络的多目标遗传算法(MOGA-Net),通过利用提出的遗传算法发现网络中的社区。该方法优化了[32]和[44]中介绍的两个目标函数,它们已被证实在检测复杂网络中模块的有效性。第一个目标函数利用了community score的概念来衡量对一个网络进行社区划分的质量。community score值越高,聚类密度越高。第二个目标函数定义了模块中节点fitness的概念,并且反复迭代找到节点fitness总和最大的模块,以下将这个目标函数称为community fitness。当总和达到最大时,外部连接是最小。两个目标函数都有一个正实数参数控制社区的规模。参数值越大,找到的社区规模越小。MOGA-Net利用这两个函数的优点,通过有选择地探索搜寻空间获得网络中存在的社区,而不需要提前知道确切的社区数目。这个数目是通过两个目标之间的最佳折衷自动确定的。 多目标方法的一个有趣结果是它提供的不是一个单独的网络划分,而是一组解。这些解中的每一个都对应两个目标之间不同的折衷,并对应多种网络划分方式,即由许多不同簇组成。对合成网络和真实网络的实验表明,这一系列帕累托最优解揭示了网络的分层结构,其中簇的数目较多的解包含在社区数目较少的解中。多目标方法的这个特性提供了一个很好的机会分析不同层级

第一章 1.3 什么是人工智能?它的研究目标是什么? 人工智能(Artificial Intelligence),英文缩写为AI。它是研究、开发用于模拟、延伸和扩展人的智能的理论、方法、技术及应用系统的一门新的技术科学。 研究目标:人工智能是计算机科学的一个分支,它企图了解智能的实质,并生产出一种新的能以人类智能相似的方式做出反应的智能机器,该领域的研究包括机器人、语言识别、图像识别、自然语言处理和专家系统等。 1.7 人工智能有哪几个主要学派?各自的特点是什么? 主要学派:符号主义,联结主义和行为主义。 1.符号主义:认为人类智能的基本单元是符号,认识过程就是符号表示下的符号计算,从 而思维就是符号计算; 2.联结主义:认为人类智能的基本单元是神经元,认识过程是由神经元构成的网络的信息 传递,这种传递是并行分布进行的。 3.行为主义:认为,人工智能起源于控制论,提出智能取决于感知和行动,取决于对外界 复杂环境的适应,它不需要只是,不需要表示,不需要推理。 1.8 人工智能有哪些主要研究和应用领域?其中有哪些是新的研究热点? 1.研究领域:问题求解,逻辑推理与定理证明,自然语言理解,自动程序设计,专家系 统,机器学习,神经网络,机器人学,数据挖掘与知识发现,人工生命,系统与语言工具。 2.研究热点:专家系统,机器学习,神经网络,分布式人工智能与Agent,数据挖掘与 知识发现。 第二章 2.8 用谓词逻辑知识表示方法表示如下知识: (1)有人喜欢梅花,有人喜欢菊花,有人既喜欢梅花又喜欢菊花。 三步走:定义谓词,定义个体域,谓词表示 定义谓词 P(x):x是人 L(x,y):x喜欢y y的个体域:{梅花,菊花}。 将知识用谓词表示为: (?x)(P(x)→L(x, 梅花)∨L(x, 菊花)∨L(x, 梅花)∧L(x, 菊花)) (2) 不是每个计算机系的学生都喜欢在计算机上编程序。 定义谓词 S(x):x是计算机系学生

遗传、蚁群算法作业 1、利用遗传算法求出下面函数的极小值:z=2-exp[-(x2+y2)], x,y∈[-5,+5] 解: 第一步确定决策变量及其约束条件:x,y∈[-5,+5] 第二步建立优化模型:min z(x,y)=2-exp[-(x2+y2)] 第三步确定编码方法。用长度为50位的二进制编码串来表示决策变量x,y。第四步确定解码方法。解码时将50位长的二进制编码前25位转换为对应的十进制整数代码,记为x,后25位转换后记为y。 第五步确定个体评价方法。 第六步设计遗传算子。选择运算用比例选择算子,交叉运算使用单点交叉算子,变异运算使用基本位变异算子。 第七步确定遗传算法的运行参数。 实现代码: % n ---- 种群规模 % ger ---- 迭代次数 % pc ---- 交叉概率 % pm ---- 变异概率 % v ---- 初始种群(规模为n) % f ---- 目标函数值 % fit ---- 适应度向量 % vx ---- 最优适应度值向量 % vmfit ---- 平均适应度值向量 clear all; close all; clc; tic; n=30; ger=200; pc=0.65; pm=0.05; % 生成初始种群 v=init_population(n,50); [N,L]=size(v); disp(sprintf('Number of generations:%d',ger)); disp(sprintf('Population size:%d',N)); disp(sprintf('Crossover probability:%.3f',pc)); disp(sprintf('Mutation probability:%.3f',pm));

遗传算法在调节控制系统参数中的应用 【摘要】自动化控制系统多采用PID 控制器来调节系统稳定性和动态性,PID 的 Kp,Ki,Kd 参数需要合理选择方能达到目标。遗传算法是一种模拟生物进化寻求最优解的有效算法,本文通过利用GAbx 工具箱实现对控制电机的PID 进行参数优化,利用matlab 的仿真功能可以观察控制效果。 1. 直流伺服电机模型 1.1物理模型 图1 直流伺服电机的物理模型 αu ---电枢输入电压(V ) a R ---电枢电阻(Ω) S L ---电枢电感(H ) q u ---感应电动势(V ) g T ---电机电磁转矩(N m ?) J---转动惯量(2m kg ?) B---粘性阻尼系数(s m N ??) g i ---流过电枢的电流(A ) θ---电机输出的转角(rad ) 1.2传递函数 利用基尔霍夫定律和牛顿第二定律得出电机基本方程并进行拉布拉斯变换 ) ()()()()()()()()()()(2s s K s U K s I s T s Bs s Js s T s I s L R s I s U s U e q t a g g a a a a q a θθθ?=?=?+?=?+?=- 式中:t K 为电机的转动常数(m N ?)A ;e K 为感应电动势常数(s V ?)rad

图2 直流伺服电机模型方框图 消去中间变量得系统的开环传递函数: s K K B Js R s L K s U s s G C t a d t a ]))([() () ()(+++= = θ 系统参数如下:s m uN B m mg J ??=?=51.3,23.32 A m N K K uH L R e t a a )(03.0,75.2,4?===Ω= 2. PID 校正 图3 PID 校正 s K s K K s G d i p c ++ =)( Kp,Ki,Kd 为比例,积分,微分系数 令Kp=15、Ki=0.8 、Kd=0.6 M 文件:J=3.23E-6; B=3.51E-6; Ra=4; La=2.75E-6; Kt=0.03; num= Kt; den=[(J*La) ((J*Ra)+(La*B)) ((B*Ra)+Kt*Kt) 0]; t=0:0.001:0.2; step(num,den,t); Kp=15; Ki=0.8; Kd=0.6; numcf=[Kd Kp Ki]; dencf=[1 0]; numf=conv(numcf,num); denf=conv(dencf,den); [numc,denc]=cloop(numf,denf); t=0:0.001:0.04; step(numc,denc,t); matlab 进行仿真,我们可以看出不恰当的PID 参数并不能使系统达到控制系统的要求,

% function nsga_2(pro) %% Main Function % Main program to run the NSGA-II MOEA. % Read the corresponding documentation to learn more about multiobjective % optimization using evolutionary algorithms. % initialize_variables has two arguments; First being the population size % and the second the problem number. '1' corresponds to MOP1 and '2' % corresponds to MOP2. %inp_para_definition=input_parameters_definition; %% Initialize the variables % Declare the variables and initialize their values % pop - population % gen - generations % pro - problem number %clear;clc;tic; pop = 100; % 每一代的种群数 gen = 100; % 总共的代数 pro = 2; % 问题选择1或者2,见switch switch pro case 1 % M is the number of objectives. M = 2; % V is the number of decision variables. In this case it is % difficult to visualize the decision variables space while the % objective space is just two dimensional. V = 6; case 2 M = 3; V = 12; case 3 % case 1和case 2 用来对整个算法进行常规验证,作为调试之用;case 3 为本工程所需; M = 2; %(output parameters 个数) V = 8; %(input parameters 个数) K = 10; end % Initialize the population chromosome = initialize_variables(pop,pro); %% Sort the initialized population % Sort the population using non-domination-sort. This returns two columns % for each individual which are the rank and the crowding distance % corresponding to their position in the front they belong. 真是牛X了。 chromosome = non_domination_sort_mod(chromosome,pro); %% Start the evolution process

《人工智能及其应用大作业(一)》 题目:基本遗传算法及其在函数优化中的作用 学号: 姓名:

基本遗传算法及其在函数优化中的应用 摘要: 从遗传算法的编码、遗传算子等方面剖析了遗传算法求解无约束函数优化问题的一般步骤,并以一个实例说明遗传算法能有效地解决函数优化问题。本文利用基本遗传算法求解函数优化问题,选用f(x)=xsin(10πx)+2.0,取值范围在]2,1 [ 中,利用基本遗传算法求解两个函数的最优值,遗传算法每次100代,一共执行10次,根据运算结果分析得到最优解。 关键字:遗传算法选择交叉变异函数优化 1.前言 1.1基本概念 遗传算法(Genetic Algorithm)是一类借鉴生物界的进化规律(适者生存,优胜劣汰遗传机制)演化而来的随机化搜索方法。遗传算法是一种群体型操作,该操作以群体中的所有个体为对象。选择(Selection)、交叉(Crossover)和变异(Mutation)是遗传算法的3个主要操作算子,它们构成了所谓的遗传操作(genetic operation),使遗传算法具有了其它传统方法所没有的特性。 1.2 遗传算法的特点 其主要特点是直接对结构对象进行操作,不存在求导和函数连续性的限定;具有内在的隐并行性和更好的全局寻优能力;采用概率化的寻优方法,能自动获取和指导优化的搜索空间,自适应地调整搜索方向,不需要确定的规则。 1.3遗传算法的应用 函数优化,组合优化,机器人智能控制,及组合图像处理和模式识别等。 2.基本遗传算法 2.1简单遗传算法的求解步骤 Step1:参数设置及种群初始化; Step2:适应度评价; Step3:选择操作; Step4:交叉操作; Step5:变异操作; Step6:终止条件判断,若未达到终止条件,则转到Step3; Step7:输出结果。 2.2停机准则

遗传算法与优化问题 一、问题背景与实验目的 遗传算法(Genetic Algorithm—GA),是模拟达尔文的遗传选择和自然淘汰的生物进化过程的计算模型,它是由美国Michigan大学的J.Holland教授于1975年首先提出的。遗传算法作为一种新的全局优化搜索算法,以其简单通用、鲁棒性强、适于并行处理及应用范围广等显著特点,奠定了它作为21世纪关键智能计算之一的地位。 1.遗传算法的基本原理 遗传算法的基本思想正是基于模仿生物界遗传学的遗传过程。它把问题的参数用基因代表,把问题的解用染色体代表(在计算机里用二进制码表示),从而得到一个由具有不同染色体的个体组成的群体。这个群体在问题特定的环境里生存竞争,适者有最好的机会生存和产生后代。后代随机化地继承了父代的最好特征,并也在生存环境的控制支配下继续这一过程。群体的染色体都将逐渐适应环境,不断进化,最后收敛到一族最适应环境的类似个体,即得到问题最优的解。值得注意的一点是,现在的遗传算法是受生物进化论学说的启发提出的,这种学说对我们用计算机解决复杂问题很有用,而它本身是否完全正确并不重要(目前生物界对此学说尚有争议)。 (1)遗传算法中的生物遗传学概念 由于遗传算法是由进化论和遗传学机理而产生的直接搜索优化方法;故而在这个算法中要用到各种进化和遗传学的概念。 首先给出遗传学概念、遗传算法概念和相应的数学概念三者之间的对应关系。这些概念如下: 1个体——要处理的基本对象、结构,也就是可行解。 2群体——个体的集合,被选定的一组可行解。 3染色体——个体的表现形式,可行解的编码。 4基因——染色体中的元素编码中的元素。 5基因位——某一基因在染色体中的位置元素在编码中的位置。 6适应值——个体对于环境的适应程度,或在环境压力下的生存能力,可行解所对应的适应函数值。 7种群——被选定的一组染色体或个体根据入选概率定出的一组可行解。 8选择——从群体中选择优胜的个体,淘汰劣质个体的操作保留或复制适应值大的可行解,去掉小的可行解。 9交叉——一组染色体上对应基因段的交换,根据交叉原则产生的一组新解。 10交叉概率——染色体对应基因段交换的概率(可能性大小),闭区间[0,1]上的一个值,一般为0.65~0.90。 11变异——染色体水平上基因变化编码的某些元素被改变。 12变异概率——染色体上基因变化的概率(可能性大小),开区间(0,1)内的一个值, 一般为0.001~0.01。 13进化——适者生存个体进行优胜劣汰的进化,一代又一代地优化目标函数取到最大值,最优的可行解。 (2)遗传算法的步骤 遗传算法计算优化的操作过程就如同生物学上生物遗传进化的过程,主要有三个基本操作(或称为算子):选择(Selection)、交叉(Crossover)、变异(Mutation)。 遗传算法基本步骤主要是:先把问题的解表示成“染色体”,在算法中也就是以二进制编码的串,在执行遗传算法之前,给出一群“染色体”,也就是假设的可行解。然后,把这些假

题目: 利用遗传算法求shaffer ’s F6函数()()222222001.015.0sin 5.0),(y x y x y x f +?+-+- =的 最优解()100,100<<-y x 。 要求给出源代码,求出最优解和最优值,给出进化代数、种群规模、交叉率及变异率。 1 求解思路 在程序中将种群规模、进化代数、交叉率及变异率分别取为不同数值,发现计算结果将收敛到不同的极大点。该函数的根据下,x 和y 的取值可以得到无穷多个极大点。 首先需要建立一个文件在里面写上两个变量的最大值及最小值。即: -100 100 -100 100 在程序中取种群规模为50,进化代数为1500,交叉率为0.8,变异率为0.15,该函数的最优解为0=x ,0=y ,对应的最优值为1。实际上,对应于这个最优解,种群规模、进化代数、交叉率及变异率可以取多组不同数值。如:取种群规模为500,进化代数为1000,交叉率为0.8,变异率为0.15时仍可以得到这个最优解。 2程序的源代码 #include

#include

%遗传算法解决多目标函数规划 clear clc syms x; %Function f1=f(x) f1=x(:,1).*x(:,1)/4+x(:,2).*x(:,2)/4; %function f2=f(x) f2=x(:,1).*(1-x(:,2))+10; NIND=100; MAXGEN=50; NV AR=2; PRECI=20; GGPA=0.9; trace1=[]; trace2=[]; trace3=[]; FielD=[rep([PRECI],[1,NV AR]);[1,1;4,2];rep([1;0;1;1],[NV AR])]; Chrom=crtbp(NIND,NV AR*PRECI); v=bs2rv(Chrom,FielD); gen=1; while gen