神经网络

在石灰窑炉的建模与控制中的应用神经网络应用广泛,尤其在系统建模与控制方面,都有很好应用。下面简要介绍神经网络在石灰窑炉的建模与控制中的应用,以便更具体地了解神经网络在实际应用中的具体问题和应用效果。

1 石灰窑炉的生产过程和数学模型

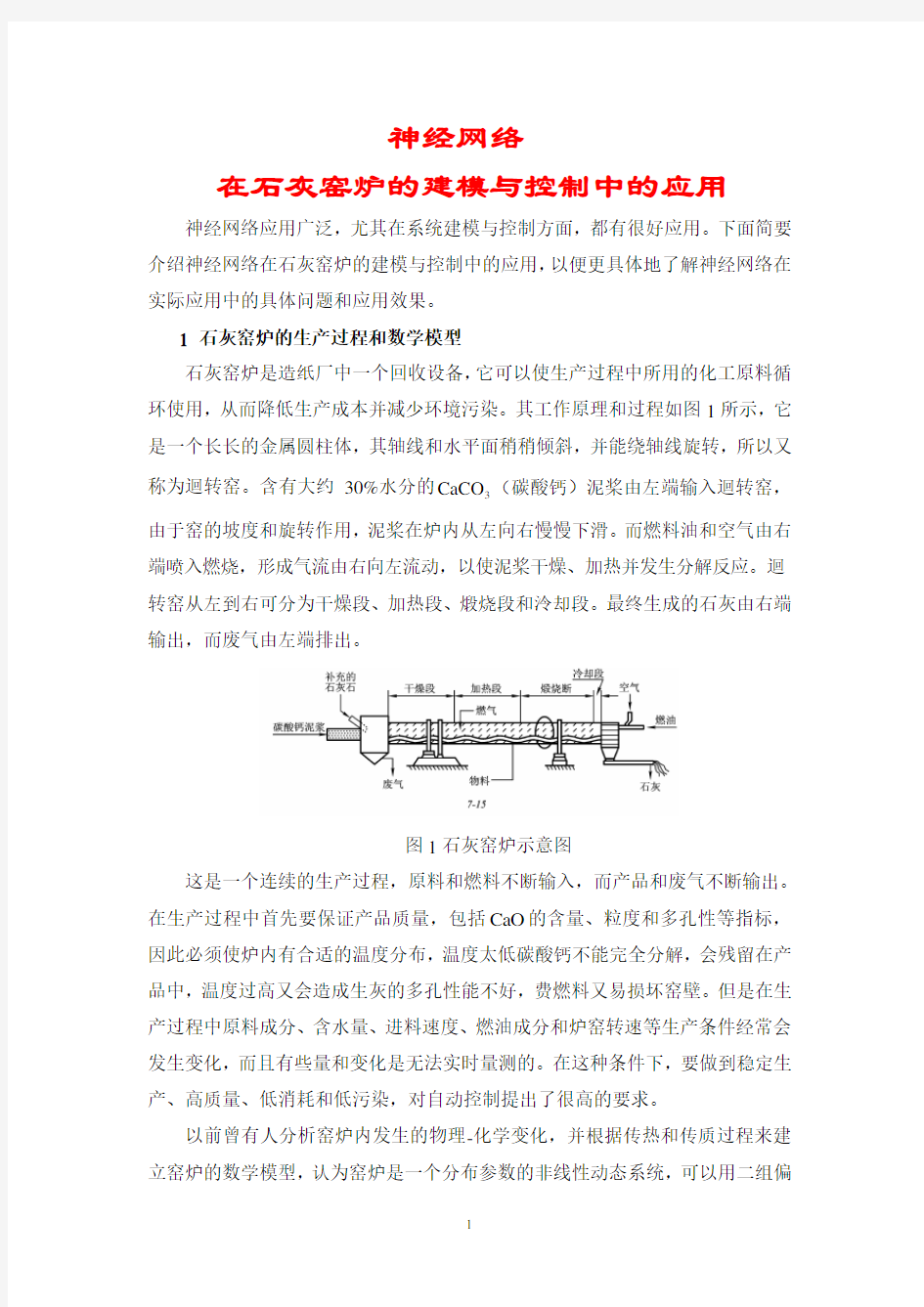

石灰窑炉是造纸厂中一个回收设备,它可以使生产过程中所用的化工原料循环使用,从而降低生产成本并减少环境污染。其工作原理和过程如图1所示,它是一个长长的金属圆柱体,其轴线和水平面稍稍倾斜,并能绕轴线旋转,所以又称为迴转窑。含有大约30%水分的

C aC O(碳酸钙)泥桨由左端输入迴转窑,

3

由于窑的坡度和旋转作用,泥桨在炉内从左向右慢慢下滑。而燃料油和空气由右端喷入燃烧,形成气流由右向左流动,以使泥桨干燥、加热并发生分解反应。迴转窑从左到右可分为干燥段、加热段、煅烧段和泠却段。最终生成的石灰由右端输出,而废气由左端排出。

图1石灰窑炉示意图

这是一个连续的生产过程,原料和燃料不断输入,而产品和废气不断输出。在生产过程中首先要保证产品质量,包括CaO的含量、粒度和多孔性等指标,因此必须使炉内有合适的温度分布,温度太低碳酸钙不能完全分解,会残留在产品中,温度过高又会造成生灰的多孔性能不好,费燃料又易损坏窑壁。但是在生产过程中原料成分、含水量、进料速度、燃油成分和炉窑转速等生产条件经常会发生变化,而且有些量和变化是无法实时量测的。在这种条件下,要做到稳定生产、高质量、低消耗和低污染,对自动控制提出了很高的要求。

以前曾有人分析窑炉内发生的物理-化学变化,并根据传热和传质过程来建立窑炉的数学模型,认为窑炉是一个分布参数的非线性动态系统,可以用二组偏

微方程来描述,给出的数学模型是

S 11,2,3,4i i i

X X S i V t

z

??+==??

(1)

g 11,2,3,4,5j j j

Y Y G j V t

z

??+

==?? (2)

在这些方程中,i X 是固体的第i 个状态变量,s V 是固体沿轴线的运动速度,i S 是与空间、固体的状态变量和气体的状态变量有关的一个非线性函数。z 代表沿轴方向的位置,t 代表时间。而g ,,j j Y V G 分别是气体的状态变量、速度和非线性函数。该系统具有分离的边界条件,也就是说,固体状态变量的值在入料处(冷端)是已知的,而气体状态变量的值在出料处(热端)是已知的,即已知

(0,),1234(,),

1,2,3,4,5

i j X z t i Y z L t j ====,,,

其中,L 是窑长度。初始条件是系统在扰动前正常工作时状态变量的值,即

(,0),1,2,3,4(,0),

1,2,3,4,5

i j X z t i Y z t j ====

因为固体的状态变化慢而气体的状态变化快,可以忽略气体状态的变化,将式(2)简化为

,

1,2,3,4,5j j Y G j z

?==?

这些方程中有很多参数,必须通过机理分析、假设或大量实验来确定,应用该数学模型需要测所有的状态变量,而这在实际情况下很难做到。

2石灰窑炉的神经网络建模

上面讲的是用机理分析建立数学模型的方法,它要搞清系统内部的物理-化学变化规律,并用严格的数学方程加以描述。从过程控制的角度来看,这种建模方法不仅是很难实现的,而且也不是十分必要的。因此大多采用系统辨识方法,将对象看作一个“黑箱”,不去分析其内部的反应机理,而只研究对象主要控制变量和输出变量之间的相互关系,神经网络系统辨识方法就是其中一种。

对石灰窑炉来说,主要的控制量有两个,一个是燃料流速1u ,另一个是风量

流速2u ,这是生产中的主要调节手段。被控量选为炉窑热端的温度1y 和炉窑冷端的温度2y ,因为这两点的温度决定了炉内的温度分布曲线,而温度分布曲线又是影响产品质量和能耗的最关键的因素。从实现角度看,这四个变量也是容易实时测量的。因此,石灰窑可近似为一个二输入二输出的非线性动态系统,其中

1y 与2y 是相关的。

应用前面介绍的神经网络辨识方法,石灰窑NARMA 方程是

p

p

p

()[(1),,();(1),,()]y k f y k y k n u k u k m =----

其中

T

12T

12()[(),()]()[(),()]

y k y k y k u k u k u k ==

采样周期定为 1.125min ,根据经验和试验结果,选择2n m ==已能足够精确地描述系统动态特性。神经网络模型的结构与系统的结构相同,可以用下式表示:

M

p

p

()[(1),(2),(1),(2)]y k f y k y k u k u k =----

定义系统输出与模型输出之间的误差矢量为

P

M

(,)()(,)e k y k y k θθ=-

则系统辨识的指标函数是

T

1

1()(,)(,)2T

k J e

k e k T

θθθ==

∑

神经网络选为有两个隐层的四层前馈网络,即4(8,20,10,2)N 隐层的节点数是根据试验确定的,隐层各神经元的激活函数均是tanh()(1e )/(1e )x x x --=-+。图2给出了用神经网络辨识石灰窑模型的系统结构。

图2石灰窑的神经网络系统辨识

训练和检验神经网络模型需要大量能充分反映系统非线性的特性的输入输出样本,为了不影响正常生产,这里输入输出样本是一个已被验证的机理模型上做仿真实验得到的。为了对系统充分激励,使训练能覆盖其全部工作范围,对系统分别输入正弦信号,阶跃信号和伪随机二进制信号,得到4000组输入输出数据1212{(),(),(),()},1,2,,4000u k u k y k y k k = 。将这些数据归一化,使它们都处于[-1,1]范围内。再用BP 学习算法训练神经网络,直至均方根误差0.01,RMS RMS <定义为

1

2

P

M

P

M

11

[()()][()()]2N

T

k RM S y k y k y k y k N =??=--?

???

∑

训练以后神经网络输出结果如图3所示。 3石灰窑炉的神经网络控制

在石灰窑炉正向模型辨识的基础上,下面着重讨论石灰窑炉神经网络内模控制,包括逆模型的辨识、内模控制的设计和仿真等问题。

1)逆模型的辨识

由前分析,石灰窑炉可以看作二输入二输出的非线性动态系统(见石灰窑的NARMA 模型)。则石灰窑的逆模型可用下面的方程描述

1M M

?()[(1);(),(1);(1)]u k f r k y k y k u k -=+--

这里用(1)r k +来代替M (1)y k +,因为M (1)()y k u k +是的作用结果,在k 时刻尚不知道,M ()y k 表示神经网络已辨识的石灰窑炉的正模型输出结果。

图3相同输入下系统输出(实线)与神经网络输出(点线)

用间接法训练石灰窑炉逆模型的系统结构如图4所示。为了克服间接法可能会使系统不稳定的缺点,在此之前先用直接法训练逆模型,获得较好的初值,逆模型仍采用二个隐层的前馈网络,其结构为4(8,20,12,2)N ,激励函数仍为

tanh()x ,学习算法也与训练正模型相同。

图4间接法训练石灰窑炉的逆模型

2)内模控制的设计

石灰窑炉的神经网络内模控制系统原理如图5所示。图中C NN 是神经网络逆模型,作为控制器,M N N 是神经网络正模型。滤波器12/(1)F z -=-是一个积分器,目的在于消除静态误差。

图5石灰窑炉的神经网络内模控制系统

为了测试石灰窑炉的内模控制效果,进行以下仿真实验。仿真所采用模型及神经网络训练样本的产生是基于一个被验证机理模型。首先让参考输入在工作点附近可以随机变化,观测输出12y y 和的变化,实验结果如图6所示。图(a )中实线代表参考输入的增量,点线代表输出的增量12y y 和(点线基本与实践重合)。图(b )是当参考输入变化时相应的1u 和2u 的变化。由仿真结果可以看出,神经网络内模控制具有很好的跟踪性能。

图6神经网络内模控制的跟踪性能

为了进一步考查神经网络内模控制的鲁棒性,在正常工作状态下,保持参考输入不变,依次加入三种扰动:

(1)1:100k ξ=在时,使进料速度增大10%。

(2)2:400k ξ=在时,使进料中固体的含量由74%降为55%,即进料中水的含量增加。

(3)3:700k ξ=在时,使窑炉转速降低5%。

内模控制系统抗扰性的实验结果示于图7,图7(a )是1y 的变化曲线,图7(b )是2y 的变化曲线,图7(c )是1u (粗线)和2u (细线)的变化曲线。在三种扰动下,系统的输出12y y 和最终能恢复到正常值,这说明内模控制具有良好的抗扰性。

在计算机实现时,所有神经网络模型,包括正向模型和逆模型以及相应的学习算法都在计算机内部实现,并通过A/D 转换从现场采集信息,通过D/A 将神经网络产生的控制信号送到被控对象。

图7内模控制的抗扰性能

4离散论域模糊控制器设计

考虑九管还原炉的自动控温系统,其结构和控制任务描述如下:

钨的熔点为3000℃以上,目前尚不能采用通常的冶炼法,而只能用粉末冶金法进行加工。九管还原炉就是用来对氧化钨粉末还原去氧的装置。它先将三氧化钨还原成一氧化钨,此过程称为一次还原;然后再将一氧化钨还原成钨,此过程为二次还原。九管还炉的结构示意图如图8所示。其中(a)为正视图;图(b)为侧视图。在焙烧管道(共9根,上层5根,下层4根)的上、下部,分别装有电热丝。共6个温区,各温区的温度根据工艺要求必须稳定在给定值附近,偏差不能超过5±℃。每个温区的几何中心装有一个热电偶,以检测本温区的温度,每两个温区由一相电源供电加热。装有三氧化钨粉末的料舟,从管道的一端进入,经过各温区后从另一端出来,一次还原时,每30min出两舟,二次还原时,每15min出两舟。

图8 九管还原炉结构示意图

本系统原靠人工控温,后来改为双位开关式控制,其偏差波动很大,往往大于15

±℃,影响钨粉产品质量。

自动控温的任务是,将各温区的温度稳定在给定值范围内(第一温区550℃,第二温区650℃……第六温区850℃),偏差不准大于±5℃。

由于要求九管还原炉采用恒值控温,各温区的温度偏移范围很小,而本温区受其他温区的影响虽然貌视很大,但这种影响只是一个恒定值,对系统的动态特性没有影响,对静态特性却有一定的偏移作用。如果将这一恒定的偏移视为本温区给定量的一部分(恒定分量),则六个温区就可分别视为六个独立的电炉。这样,被控对象就成了六个独立的单输入、单输出环节了。

由于确定九管还原炉精确数学模型非常困难,再加上各种非线性和分布参数的影响,使得传统控制方法难于满足要求。因此下面将采用离散论域的模糊逻辑

进行控制,原理如图9所示。

图9 还原炉温度的模糊控制系统

图中,r 为温度设定值,e =y -r 为温度误差,?是差分算子,e ?是误差差分,123,,K K K 是论域变换因子,

u 是控制量,它对应电加热器装置的晶闸管导通角的变化量。离散论域的模糊控制器主要设计如下:

1)输入/输出变量论域的离散化

e ,e ?和u 都是实数上的连续变量,在该还原炉问题中它们变化范围分别为:

[30,30],[24,24],[36,36]e e u ∈-?∈-∈-。将 e 变换到离散论域{6,5X '=--,4,3,2,1,0,0,1,2,3,4,5,6}-----+上,将e ?变换到{6,5,

4,3Y '=-----

,1,0,1,2,3,4,5,6}-上,将u 变换到{6,5,4,3,2,1,0,1,2,3,4,5,6}Z '=------上,得到

离散论域上的输入/输出变量***,,e e u ?。

2) 定义模糊集合及其隶属函数表

对*e 定义8个模糊集合128,,E E E ,分别代表PL (正大)、PM (正中)PS (正小)、PZ (正零)、NZ (负零)、NS (负小)NM (负中)、NL (负大)。对*e ?定义7个模糊集合127,,E E E ??? ,分别代表PL ,PM ,PS ,ZE ,NS ,NM ,NL 。对*u 定义7个模糊子集127,U U U ,分别代表PL ,PM ,PS ,ZE ,NS ,NM ,NL 。

对***,,e e u ?的模糊集合分别定义隶属函数,如表1,表2,表3所示。

表1 i E 的隶属函数表

表2 i E ?的隶属关系

表3 i U 的隶属数表

3) 设计模糊控制规则集

总结操作人员的经验,给出52条控制规则,归纳于表4。控制规则的一般

形式为

*

**

if and

then 1,2,,8;1,2,,7;1,2,,7

i j k

e E e E u U i j k =?=?====

表4 控制规则表

注:×表示不可能出现的情况。 4)求模糊关系矩阵和模糊控制表

由于论域是离散的,模糊控制规则集可以表示为一个模糊关系矩阵R

,,()i j k i j k

R E E U ?=???

其中R 是一个(14×13)×13的大矩阵,占2366个内存单元。

算出R 以后,便可以对*e 和*e ?设不同的值,例如**6,6e e =-?=-,将它们看成是模糊单点,这时的输入是模糊矢量[1,0,,0],[1,0,,0]T T E E ''=?= ,可求出输出模糊矢量U '

()U E E R '''=??

其中()E E ''??是一个14×13的矩阵,将其按行排成矢量,再与R 合成。由于

()E E ''??此时只有第一个元素为1,其他元素皆为零,U '即是R 的第一行。U '

中的隶属度最大对应的*u 即为此时输出。用同样方法,对每对输入**,i j e e ?,都可

以求出相应的输出*

ij u ,将它们整理成模糊控制表,如表5所示。

表5 模糊控制查询表

5) 实时控制

控制表可离线算出,在实时控制时得到k e 和k e ?后,先变换成离散量*k e 和

*

k

e ?,查表得到*k u ,再论域反变换求出真正的连续控制量k u 。

以上设计的模糊控制器已成功应用于还原炉的温度控制中,并取得了很好的

控制效果。温度控制的上升时间短,超调量小、控制性能稳定、对环境变化不敏感,而且算法非常简单、执行快。图10和图11给出了模糊逻辑控制的仿真结果。

图10 双位开关式与Fuzzy 控制特性比较 图11 时延τ对Fuzzy 控制器特性的影响

1—Fuzzy 控制,2—双位开关式控制 图11 时延τ对Fuzzy 控制器特性的影响 1—τ=0.7,2—τ=1.6

该系统实现的硬件结构如图12所示,其中单片采有8031,并扩充了8KEPROM 。由此可见,该系统实现容易,且对系统配置在求不高。

图12 系统硬件结构图

基于BP神经网络的国际黄金价格预测模型 公文易文秘资源网顾孟钧张志和陈友2009-1-2 13:35:26我要投稿添加到百度搜藏 [摘要] 为了寻找国际黄金价格与道琼斯工业指数、美国消费者指数,国际黄金储备等因素之间的内在关系,本文对1972年~2006年间的各项数据首先进行归一化处理,利用MATLAB神经网络工具箱进行模拟训练,建立了基于BP神经网络的国际黄金价格预测模型 [摘要] 为了寻找国际黄金价格与道琼斯工业指数、美国消费者指数,国际黄金储备等因素之间的内在关系,本文对1972年~2006年间的各项数据首先进行归一化处理,利用MATLAB神经网络工具箱进行模拟训练,建立了基于BP神经网络的国际黄金价格预测模型。 [关键词] MATLAB BP神经网络预测模型数据归一化 一、引言 自20世纪70年代初以来的30多年里,世界黄金价格出现了令人瞠目的剧烈变动。20 世纪70年代初,每盎司黄金价格仅为30多美元。80年代初,黄金暴涨到每盎司近700美元。本世纪初,黄金价格处于每盎司270美元左右,此后逐年攀升,到2006年5月12日达到了26年高点,每盎司730美元,此后又暴跌,仅一个月时间内就下跌了约160美元,跌幅高达21.9%。最近两年,黄金价格一度冲高到每盎司900多美元。黄金价格起伏如此之大,本文根据国际黄金价格的影响因素,通过BP神经网络预测模型来预测长期黄金价格。 二、影响因素 刘曙光和胡再勇证实将观察期延长为1972年~2006年时,则影响黄金价格的主要因素扩展至包含道琼斯指数、美国消费者价格指数、美元名义有效汇率、美国联邦基金利率和世界黄金储备5个因素。本文利用此观点,根据1972年~2006年各因素的值来建立神经网络预测模型。 三、模型构建

循环神经网络(RNN, Recurrent Neural Networks)介绍 标签:递归神经网络RNN神经网络LSTMCW-RNN 2015-09-23 13:24 25873人阅读评论(13) 收藏举报分类: 数据挖掘与机器学习(23) 版权声明:未经许可, 不能转载 目录(?)[+]循环神经网络(RNN, Recurrent Neural Networks)介绍 这篇文章很多内容是参考: https://www.doczj.com/doc/9316929357.html,/2015/09/recurrent-neural-networks-tutorial-part-1-introd uction-to-rnns/,在这篇文章中,加入了一些新的内容与一些自己的理解。 循环神经网络(Recurrent Neural Networks,RNNs)已经在众多自然语言处理(Natural Language Processing, NLP)中取得了巨大成功以及广泛应用。但是,目前网上与RNNs有关的学习资料很少,因此该系列便是介绍RNNs的原理以及如何实现。主要分成以下几个部分对RNNs进行介绍: 1. RNNs的基本介绍以及一些常见的RNNs(本文内容); 2. 详细介绍RNNs中一些经常使用的训练算法,如Back Propagation Through Time(BPTT)、Real-time Recurrent Learning(RTRL)、Extended Kalman Filter(EKF)等学习算法,以及梯度消失问题(vanishing gradient problem) 3. 详细介绍Long Short-Term Memory(LSTM,长短时记忆网络);

基于神经网络的预测控制模型仿真 摘要:本文利用一种权值可以在线调整的动态BP神经网络对模型预测误差进行拟合并与预测模型一起构成动态组合预测器,在此基础上形成对模型误差具有动态补偿能力的预测控制算法。该算法显著提高了预测精度,增强了预测控制算法的鲁棒性。 关键词:预测控制神经网络动态矩阵误差补偿 1.引言 动态矩阵控制(DMC)是一种适用于渐近稳定的线性或弱非线性对象的预测控制算法,目前已广泛应用于工业过程控制。它基于对象阶跃响应系数建立预测模型,因此建模简单,同时采用多步滚动优化与反馈校正相结合,能直接处理大时滞对象,并具有良好的跟踪性能和较强的鲁棒性。 但是,DMC算法在实际控制中存在一系列问题,模型失配是其中普遍存在的一个问题,并会不同程度地影响系统性能。DMC在实际控制中产生模型失配的原因主要有2个,一是诸如建模误差、环境干扰等因素,它会在实际控制的全程范围内引起DMC的模型失配;二是实际系统的非线性特性,这一特性使得被控对象的模型发生变化,此时若用一组固定的阶跃响应数据设计控制器进行全程范围的控制,必然会使实际控制在对象的非建模区段内出现模型失配。针对DMC模型失配问题,已有学者进行了大量的研究,并取得了丰富的研究成果,其中有基于DMC控制参数在线辨识的智能控制算法,基于模型在线辨识的自校正控制算法以及用神经元网络进行模型辨识、在辨识的基础上再进行动态矩阵控制等。这些算法尽管进行在线辨识修正对象模型参数,仍对对象降阶建模误差(结构性建模误差)的鲁棒性不好,并对随机噪声干扰较敏感。针对以上问题,出现了基于误差校正的动态矩阵控制算法。这些文献用基于时间序列预测的数学模型误差代替原模型误差,得到对未来误差的预测。有人还将这种误差预测方法引入动态矩阵控制,并应用于实际。这种方法虽然使系统表现出良好的稳定性,但建立精确的误差数学模型还存在一定的困难。 本文利用神经网络通过训练学习能逼近任意连续有界函数的特点,建立了一种采用BP 神经网络进行预测误差补偿的DMC预测控制模型。其中神经网络预测误差描述了在预测模型中未能包含的一切不确定性信息,可以归结为用BP神经网络基于一系列过去的误差信息预测未来的误差,它作为模型预测的重要补充,不仅降低建立数学模型的负担,而且还可以弥补在对象模型中已简化或无法加以考虑的一切其他因素。 本文通过进行仿真,验证了基于神经网络误差补偿的预测控制算法的有效性及优越性,

第四章计算智能(1):神经计算模糊计算4-1 计算智能的含义是什么?它涉及哪些研究分支? 贝兹德克认为计算智能取决于制造者提供的数值数据,而不依赖于知识。计算智能是智力的低层认知。 主要的研究领域为神经计算,模糊计算,进化计算,人工生命。 4-2 试述计算智能(CI)、人工智能(AI)和生物智能(BI)的关系。 计算智能是智力的低层认知,主要取决于数值数据而不依赖于知识。人工智能是在计算智能的基础上引入知识而产生的智力中层认知。生物智能,尤其是人类智能,则是最高层的智能。即CI包含AI包含BI 4-3 人工神经网络为什么具有诱人的发展前景和潜在的广泛应用领域? 人工神经网络具有如下至关重要的特性: (1) 并行分布处理 适于实时和动态处理 (2)非线性映射 给处理非线性问题带来新的希望 (3) 通过训练进行学习 一个经过适当训练的神经网络具有归纳全部数据的能力,能够解决那些由数学模型或描述规则难以处理的问题 (4) 适应与集成 神经网络的强适应和信息融合能力使得它可以同时输入大量不同的控制信号,实现信息集成和融合,适于复杂,大规模和多变量系统 (5) 硬件实现 一些超大规模集成是电路实现硬件已经问世,使得神经网络成为具有快速和大规模处理能力的网络。 4-4 简述生物神经元及人工神经网络的结构和主要学习算法。

生物神经元 大多数神经元由一个细胞体(cell body或soma)和突(process)两部分组成。突分两类,即轴突(axon)和树突(dendrite),轴突是个突出部分,长度可达1m,把本神经元的输出发送至其它相连接的神经元。树突也是突出部分,但一般较短,且分枝很多,与其它神经元的轴突相连,以接收来自其它神经元的生物信号。 轴突的末端与树突进行信号传递的界面称为突触(synapse),通过突触向其它神经元发送信息。对某些突触的刺激促使神经元触发(fire)。只有神经元所有输入的总效应达到阈值电平,它才能开始工作。此时,神经元就产生一个全强度的输出窄脉冲,从细胞体经轴突进入轴突分枝。这时的神经元就称为被触发。突触把经过一个神经元轴突的脉冲转化为下一个神经元的兴奋或抑制。学习就发生在突触附近。 每个人脑大约含有10^11-10^12个神经元,每一神经元又约有10^3-10^4个突触。神经元通过突触形成的网络,传递神经元间的兴奋与抑制。大脑的全部神经元构成极其复杂的拓扑网络群体,用于实现记忆与思维。 人工神经网络的结构 人工神经网络由神经元模型构成。每个神经元具有单一输出,并且能够与其它神经元连接,存在许多输出连接方法,每种连接方法对应于一个连接权系数。 人工神经网络的结构分为2类, (1)递归(反馈)网络 有些神经元的输出被反馈至同层或前层神经元。信号能够从正向和反向流通。Hopfield网络,Elmman网络和Jordan网络是代表。 (2) 前馈网络 具有递阶分层结构,由一些同层神经元间不存在互连的层级组成。从输入层至输出层的信号通过单向连接流通,神经元从一层连接至下一层,不存在同层神经元之间的连接。多层感知器(MLP),学习矢量量化网络(LVQ),小脑模型连接控制网络(CMAC)和数据处理方法网络(GMDH)是代表。 人工神经网络的主要学习算法 (1) 指导式(有师)学习 根据期望和实际的网络输出之间的差来调整神经元连接的强度或权。包括Delta规则,广义Delta规则,反向传播算法及LVQ算法。 (2) 非指导(无导师)学习 训练过程中,神经网络能自动地适应连接权,以便按相似特征把输入模式分组聚集。包括

Train.txt 5.0,3.0,1.6,0.2,1 5.0,3.4,1.6,0.4,1 5.2,3.5,1.5,0.2,1 5.2,3.4,1.4,0.2,1 4.7,3.2,1.6,0.2,1 4.8,3.1,1.6,0.2,1 5.4,3.4,1.5,0.4,1 5.2,4.1,1.5,0.1,1 5.5,4.2,1.4,0.2,1 4.9,3.1,1.5,0.1,1 5.0,3.2,1.2,0.2,1 5.5,3.5,1.3,0.2,1 4.9,3.1,1.5,0.1,1 4.4,3.0,1.3,0.2,1 5.1,3.4,1.5,0.2,1 5.0,3.5,1.3,0.3,1 4.5,2.3,1.3,0.3,1 4.4,3.2,1.3,0.2,1 5.0,3.5,1.6,0.6,1 5.1,3.8,1.9,0.4,1 4.8,3.0,1.4,0.3,1 5.1,3.8,1.6,0.2,1 4.6,3.2,1.4,0.2,1 5.3,3.7,1.5,0.2,1 5.0,3.3,1.4,0.2,1 6.6,3.0,4.4,1.4,2 6.8,2.8,4.8,1.4,2 6.7,3.0,5.0,1.7,2 6.0,2.9,4.5,1.5,2 5.7,2.6,3.5,1.0,2 5.5,2.4,3.8,1.1,2 5.5,2.4,3.7,1.0,2 5.8,2.7,3.9,1.2,2 6.0,2.7,5.1,1.6,2 5.4,3.0,4.5,1.5,2 6.0,3.4,4.5,1.6,2 6.7,3.1,4.7,1.5,2 6.3,2.3,4.4,1.3,2 5.6,3.0,4.1,1.3,2 5.5,2.5,4.0,1.3,2 5.5,2.6,4.4,1.2,2 6.1,3.0,4.6,1.4,2 5.8,2.6,4.0,1.2,2

OpenCV的ml模块实现了人工神经网络(Artificial Neural Networks,ANN)最典型的多层感知器(multi-layer perceptrons, MLP)模型。由于ml模型实现的算法都继承自统一的CvStatModel基类,其训练和预测的接口都是train(),predict(),非常简单。 下面来看神经网络CvANN_MLP 的使用~ 定义神经网络及参数: [cpp]view plain copy 1.//Setup the BPNetwork 2. CvANN_MLP bp; 3.// Set up BPNetwork's parameters 4. CvANN_MLP_TrainParams params; 5. params.train_method=CvANN_MLP_TrainParams::BACKPROP; 6. params.bp_dw_scale=0.1; 7. params.bp_moment_scale=0.1; 8.//params.train_method=CvANN_MLP_TrainParams::RPROP; 9.//params.rp_dw0 = 0.1; 10.//params.rp_dw_plus = 1.2; 11.//params.rp_dw_minus = 0.5; 12.//params.rp_dw_min = FLT_EPSILON; 13.//params.rp_dw_max = 50.; 可以直接定义CvANN_MLP神经网络,并设置其参数。BACKPROP表示使用 back-propagation的训练方法,RPROP即最简单的propagation训练方法。 使用BACKPROP有两个相关参数:bp_dw_scale即bp_moment_scale: 使用PRPOP有四个相关参数:rp_dw0, rp_dw_plus, rp_dw_minus, rp_dw_min, rp_dw_max:

B P神经网络预测模型及 应用 IMB standardization office【IMB 5AB- IMBK 08- IMB 2C】

B P神经网络预测模型及应用 摘要采用BP神经网络的原理,建立神经网络的预测模型,并利用建立的人工神经网络训练并预测车辆的销售量,最后得出合理的评价和预测结果。 【关键词】神经网络模型预测应用 1 BP神经网络预测模型 BP神经网络基本理论 人工神经网络是基于模仿生物大脑的结构和功能而构成的一种信息处理系统。该网络由许多神经元组成,每个神经元可以有多个输入,但只有一个输出,各神经元之间不同的连接方式构成了不同的神经网络模型,BP网为其中之一,它又被称为多层前馈神经网络。 BP神经网络预测模型 (1)初始化,给各连接权值(wij,vi)及阐值(θi)赋予随机值,确定网络结构,即输入单元、中间层单元以及输出层单元的个数;通过计算机仿真确定各系数。 在进行BP网络设计前,一般应从网络的层数、每层中的神经元个数、初始值以及学习方法等方面进行考虑,BP网络由输入层、隐含层和输出层组成。隐含层神经元个数由以下经验公式计算: (1)

式中:s为隐层节点数,m为输入层节点数,n为输出层节点数,h为正整数,一般取3―7. BP网络采用了有一定阈值特性的、连续可微的sigmoid函数作为神经元的激发函数。采用的s 型函数为: (2) 式中:s为隐层节点数,m为输入层节点数,n为输出层节点数,h为正整数,一般取3―7.计算值需经四舍五入取整。 (2)当网络的结构和训练数据确定后,误差函数主要受激励函数的影响,尽管从理论分析中得到比的收敛速度快,但是也存在着不足之处。当网络收敛到一定程度或者是已经收敛而条件又有变化的时候,过于灵敏的反映会使得系统产生震荡,难于收敛。因此,对激励函数进行进一步改进,当权值wij (k)的修正值Δwij(k) Δwij(k+1)<0时,,其中a为大于零小于1的常数。这样做降低了系统进入最小点时的灵敏度,减少震荡。 2 应用 车辆销售量神经网络预测模型 本文以某汽车制造企业同比价格差、广告费用、服务水平、车辆销售量作为学习训练样本数据。如表1。 表1 产品的广告费、服务水平、价格差、销售量 月份广告费 (百万元)服务水平价格差

%% 该代码为基于BP网络的语言特征信号识别分类 %% 清空环境变量 clc clear %% 训练数据预测数据提取及归一化 %下载四类语音信号(原始数据附在代码最后面) load data1 c1 load data2 c2 load data3 c3 load data4 c4 %四个特征信号矩阵合成一个矩阵 data(1:500,:)=c1(1:500,:); data(501:1000,:)=c2(1:500,:); data(1001:1500,:)=c3(1:500,:); data(1501:2000,:)=c4(1:500,:); %从1到2000间随机排序 k=rand(1,2000);

[m,n]=sort(k); %输入输出数据 input=data(:,2:25); output1 =data(:,1); %把输出从1维变成4维 output=zeros(2000,4); for i=1:2000 switch output1(i) case 1 output(i,:)=[1 0 0 0]; case 2 output(i,:)=[0 1 0 0]; case 3 output(i,:)=[0 0 1 0]; case 4 output(i,:)=[0 0 0 1]; end end %随机提取1500个样本为训练样本,500个样本为预测样本

input_train=input(n(1:1500),:)'; output_train=output(n(1:1500),:)'; input_test=input(n(1501:2000),:)'; output_test=output(n(1501:2000),:)'; %输入数据归一化 [inputn,inputps]=mapminmax(input_train); %% 网络结构初始化 innum=24; midnum=25; outnum=4; %权值初始化 w1=rands(midnum,innum); b1=rands(midnum,1); w2=rands(midnum,outnum); b2=rands(outnum,1); w2_1=w2;w2_2=w2_1; w1_1=w1;w1_2=w1_1;

BP神经网络模型 第1节基本原理简介 近年来全球性的神经网络研究热潮的再度兴起,不仅仅是因为神经科学本身取得了巨大的进展.更主要的原因在于发展新型计算机和人工智能新途径的迫切需要.迄今为止在需要人工智能解决的许多问题中,人脑远比计算机聪明的多,要开创具有智能的新一代计算机,就必须了解人脑,研究人脑神经网络系统信息处理的机制.另一方面,基于神经科学研究成果基础上发展出来的人工神经网络模型,反映了人脑功能的若干基本特性,开拓了神经网络用于计算机的新途径.它对传统的计算机结构和人工智能是一个有力的挑战,引起了各方面专家的极大关注. 目前,已发展了几十种神经网络,例如Hopficld模型,Feldmann等的连接型网络模型,Hinton等的玻尔茨曼机模型,以及Rumelhart等的多层感知机模型和Kohonen的自组织网络模型等等。在这众多神经网络模型中,应用最广泛的是多层感知机神经网络。多层感知机神经网络的研究始于50年代,但一直进展不大。直到1985年,Rumelhart等人提出了误差反向传递学习算法(即BP算),实现了Minsky的多层网络

设想,如图34-1所示。 BP 算法不仅有输入层节点、输出层节点,还可有1个或多个隐含层节点。对于输入信号,要先向前传播到隐含层节点,经作用函数后,再把隐节点的输出信号传播到输出节点,最后给出输出结果。节点的作用的激励函数通常选取S 型函数,如 Q x e x f /11)(-+= 式中Q 为调整激励函数形式的Sigmoid 参数。该算法的学习过程由正向传播和反向传播组成。在正向传播过程中,输入信息从输入层经隐含层逐层处理,并 传向输出层。每一层神经元的状态只影响下一层神经

BP神经网络模型与学习算法 BP神经网络模型与学习算法 (1) 一,什么是BP (1) 二、反向传播BP模型 (8) 一,什么是BP "BP(Back Propagation)网络是1986年由Rumelhart和McCelland为首的科学家小组提出,是一种按误差逆传播算法训练的多层前馈网络,是目前应用最广泛的神经网络模型之一。BP网络能学习和存贮大量的输入-输出模式映射关系,而无需事前揭示描述这种映射关系的数学方程。它的学习规则是使用最速下降法,通过反向传播来不断调整网络的权值和阈值,使网络的误差平方和最小。BP神经网络模型拓扑结构包括输入层(input)、隐层(hide layer)和输出层(output layer)。" 我们现在来分析下这些话: ?“是一种按误差逆传播算法训练的多层前馈网络” BP是后向传播的英文缩写,那么传播对象是什么?传播的目的是什么?传播的方式是后向,可这又是什么意思呢。 传播的对象是误差,传播的目的是得到所有层的估计误差,后向是说由后层误差推导前层误差: 即BP的思想可以总结为 利用输出后的误差来估计输出层的直接前导层的误差,再用这个误差估计更前一层的误差,如此一层一层的反传下去,就获得了所有其他各层的误差估计。 ?“BP神经网络模型拓扑结构包括输入层(input)、隐层(hide layer)和输出层(output layer)” 最简单的三层BP:

?“BP网络能学习和存贮大量的输入-输出模式映射关系,而无需事前揭示描述这种映射关系的数学方程。”BP利用一种称为激活函数来描述层与层输出之间的关系,从而模拟各层神经元之间的交互反应。 激活函数必须满足处处可导的条件。那么比较常用的是一种称为S型函数的激活函数: 那么上面的函数为什么称为是S型函数呢: 我们来看它的形态和它导数的形态: p.s. S型函数的导数:

几种神经网络模型及其应用 摘要:本文介绍了径向基网络,支撑矢量机,小波神经网络,反馈神经网络这几种神经网络结构的基本概念与特点,并对它们在科研方面的具体应用做了一些介绍。 关键词:神经网络径向基网络支撑矢量机小波神经网络反馈神经网络Several neural network models and their application Abstract: This paper introduced the RBF networks, support vector machines, wavelet neural networks, feedback neural networks with their concepts and features, as well as their applications in scientific research field. Key words: neural networks RBF networks support vector machines wavelet neural networks feedback neural networks 2 引言 随着对神经网络理论的不断深入研究,其应用目前已经渗透到各个领域。并在智能控制,模式识别,计算机视觉,自适应滤波和信号处理,非线性优化,语音识别,传感技术与机器人,生物医学工程等方面取得了令人吃惊的成绩。本文介绍几种典型的神经网络,径向基神经网络,支撑矢量机,小波神经网络和反馈神经网络的概念及它们在科研中的一些具体应用。 1. 径向基网络 1.1 径向基网络的概念 径向基的理论最早由Hardy,Harder和Desmarais 等人提出。径向基函数(Radial Basis Function,RBF)神经网络,它的输出与连接权之间呈线性关系,因此可采用保证全局收敛的线性优化算法。径向基神经网络(RBFNN)是 3 层单元的神经网络,它是一种静态的神经网络,与函数逼近理论相吻合并且具有唯一的最佳逼近点。由于其结构简单且神经元的敏感区较小,因此可以广泛地应用于非线性函数的局部逼近中。主要影响其网络性能的参数有3 个:输出层权值向量,隐层神经元的中心以及隐层神经元的宽度(方差)。一般径向基网络的学习总是从网络的权值入手,然后逐步调整网络的其它参数,由于权值与神经元中心及宽度有着直接关系,一旦权值确定,其它两个参数的调整就相对困难。 其一般结构如下: 如图 1 所示,该网络由三层构成,各层含义如下: 第一层:输入层:输入层神经元只起连接作用。 第二层:隐含层:隐含层神经元的变换函数为高斯核. 第三层:输出层:它对输入模式的作用做出响应. 图 1. 径向基神经网络拓扑结构 其数学模型通常如下: 设网络的输入为x = ( x1 , x2 , ?, xH ) T,输入层神经元至隐含层第j 个神经元的中心矢 为vj = ( v1 j , v2 j , ?, vIj ) T (1 ≤j ≤H),隐含层第j 个神经元对应输入x的状态为:zj = φ= ‖x - vj ‖= exp Σx1 - vij ) 2 / (2σ2j ) ,其中σ(1≤j ≤H)为隐含层第j个神

神经网络 一、神经网络简介 人工神经网络(ANN),简称神经网络,是一种模仿生物神经网络的结构和功能的数学模型或计算模型。神经网络由大量的人工神经元联结进行计算。大多数情况下人工神经网络能在外界信息的基础上改变内部结构,是一种自适应系统。现代神经网络是一种非线性统计性数据建模工具,常用来对输入和输出间复杂的关系进行建模,或用来探索数据的模式物理结构:人工神经元将模拟生物神经元的功能 计算模拟:人脑的神经元有局部计算和存储的功能,通过连接构成一个系统。人工神经网络中也有大量有局部处理能力的神经元,也能够将信息进行大规模并行处理存储与操作:人脑和人工神经网络都是通过神经元的连接强度来实现记忆存储功能,同时为概括、类比、推广提供有力的支持 训练:同人脑一样,人工神经网络将根据自己的结构特性,使用不同的训练、学习过程,自动从实践中获得相关知识 神经网络是一种运算模型,由大量的节点(或称“神经元”,或“单元”)和之间相互联接构成。每个节点代表一种特定的输出函数,称为激励函数。每两个节点间的连接都代表一个对于通过该连接信号的加权值,称之为权重,这相当于人工神经网络的记忆。网络的输出则依网络的连接方式,权重值和激励函数的不同而不同。而网络自身通常都是对自然界某种算法或者函数的逼近,也可能是对一种逻辑策略的表达。 二、BP神经网络算法描述 1、sigmoid函数分类 回顾我们前面提到的感知器,它使用示性函数作为分类的办法。然而示性函数作为分类器它的跳点让人觉得很难处理,幸好sigmoid函数y=1/(1+e^-x)有类似的性质,且有着光滑性这一优良性质。我们通过下图可以看见sigmoid函数的图像: 错误!

神经网络Matlab p=p1';t=t1'; [pn,minp,maxp,tn,mint,maxt]=premnmx(p,t); %原始数据归一化net=newff(minmax(pn),[5,1],{'tansig','purelin'},'traingdx');%设置网络,建立相应的BP网络 net.trainParam.show=2000; % 训练网络 net.trainParam.lr=0.01; net.trainParam.epochs=100000; net.trainParam.goal=1e-5; [net,tr]=train(net ,pn,tn); %调用TRAINGDM算法训练BP网络 pnew=pnew1'; pnewn=tramnmx(pnew,minp,maxp); anewn=sim(net,pnewn); %对BP网络进行仿真 anew=postmnmx(anewn,mint,maxt); %还原数据 y=anew'; 1、BP网络构建 (1)生成BP网络 = net newff PR S S SNl TF TF TFNl BTF BLF PF (,[1 2...],{ 1 2...},,,) R?维矩阵。 PR:由R维的输入样本最小最大值构成的2

S S SNl:各层的神经元个数。 [1 2...] TF TF TFNl:各层的神经元传递函数。 { 1 2...} BTF:训练用函数的名称。 (2)网络训练 = [,,,,,] (,,,,,,) net tr Y E Pf Af train net P T Pi Ai VV TV (3)网络仿真 = [,,,,] (,,,,) Y Pf Af E perf sim net P Pi Ai T {'tansig','purelin'},'trainrp' BP网络的训练函数 训练方法训练函数 梯度下降法traingd 有动量的梯度下降法traingdm 自适应lr梯度下降法traingda 自适应lr动量梯度下降法traingdx 弹性梯度下降法trainrp Fletcher-Reeves共轭梯度法traincgf Ploak-Ribiere共轭梯度法traincgp Powell-Beale共轭梯度法traincgb 量化共轭梯度法trainscg 拟牛顿算法trainbfg 一步正割算法trainoss Levenberg-Marquardt trainlm

神经网络 在石灰窑炉的建模与控制中的应用神经网络应用广泛,尤其在系统建模与控制方面,都有很好应用。下面简要介绍神经网络在石灰窑炉的建模与控制中的应用,以便更具体地了解神经网络在实际应用中的具体问题和应用效果。 1 石灰窑炉的生产过程和数学模型 石灰窑炉是造纸厂中一个回收设备,它可以使生产过程中所用的化工原料循环使用,从而降低生产成本并减少环境污染。其工作原理和过程如图1所示,它是一个长长的金属圆柱体,其轴线和水平面稍稍倾斜,并能绕轴线旋转,所以又 CaCO(碳酸钙)泥桨由左端输入迴转窑,称为迴转窑。含有大约30%水分的 3 由于窑的坡度和旋转作用,泥桨在炉内从左向右慢慢下滑。而燃料油和空气由右端喷入燃烧,形成气流由右向左流动,以使泥桨干燥、加热并发生分解反应。迴转窑从左到右可分为干燥段、加热段、煅烧段和泠却段。最终生成的石灰由右端输出,而废气由左端排出。 图1石灰窑炉示意图 这是一个连续的生产过程,原料和燃料不断输入,而产品和废气不断输出。在生产过程中首先要保证产品质量,包括CaO的含量、粒度和多孔性等指标,因此必须使炉内有合适的温度分布,温度太低碳酸钙不能完全分解,会残留在产品中,温度过高又会造成生灰的多孔性能不好,费燃料又易损坏窑壁。但是在生产过程中原料成分、含水量、进料速度、燃油成分和炉窑转速等生产条件经常会发生变化,而且有些量和变化是无法实时量测的。在这种条件下,要做到稳定生产、高质量、低消耗和低污染,对自动控制提出了很高的要求。 以前曾有人分析窑炉内发生的物理-化学变化,并根据传热和传质过程来建立窑炉的数学模型,认为窑炉是一个分布参数的非线性动态系统,可以用二组偏

BP 神经网络模型 近年来全球性的神经网络研究热潮的再度兴起,不仅仅是因为神经科学本身取得了巨大的进展.更主要的原因在于发展新型计算机和人工智能新途径的迫切需要.迄今为止在需要人工智能解决的许多问题中,人脑远比计算机聪明的多,要开创具有智能的新一代计算机,就必须了解人脑,研究人脑神经网络系统信息处理的机制.另一方面,基于神经科学研究成果基础上发展出来的人工神经网络模型,反映了人脑功能的若干基本特性,开拓了神经网络用于计算机的新途径.它对传统的计算机结构和人工智能是一个有力的挑战,引起了各方面专家的极大关注. 目前,已发展了几十种神经网络,例如Hopficld 模型,Feldmann 等的连接型网络模型,Hinton 等的玻尔茨曼机模型,以及Rumelhart 等的多层感知机模型和Kohonen 的自组织网络模型等等。在这众多神经网络模型中,应用最广泛的是多层感知机神经网络。多层感知机神经网络的研究始于50年代,但一直进展不大。直到1985年,Rumelhart 等人提出了误差反向传递学习算法(即BP 算),实现了Minsky 的多层网络设想,如图34-1所示。 BP 算法不仅有输入层节点、输出层节点,还可有1个或多个隐含层节点。对于输入信号,要先向前传播到隐含层节点,经作用函数后,再把隐节点的输出信号传播到输出节点,最后给出输出结果。节点的作用的激励函数通常选取S 型函数,如 Q x e x f /11 )(-+= 式中Q 为调整激励函数形式的Sigmoid 参数。该算法的学习过程由正向传播和反向传播组成。在正向传播过程中,输入信息从输入层经隐含层逐层处理,并传向输出层。每一层神经元的状态只影响下一层神经元的状态。如果输出层得不到期望的输出,则转入反向传播,将误差信号沿原来的连接通道返回,通过修改各层神经元的权值,使得误差信号最小。 社含有n 个节点的任意网络,各节点之特性为Sigmoid 型。为简便起见,指定网络只有一个输出y ,任一节点i 的输出为O i ,并设有N 个样本(x k ,y k )(k =1,2,3,…,N ),对某一输入x k ,网络输出为y k 节点i 的输出为O ik ,节点j 的输入为net jk = ∑i ik ij O W 并将误差函数定义为∑=-=N k k k y y E 12 )(21

BP神经网络 算法原理: 输入信号 x i通过中间节点(隐层点)作用于输出节点,经过非线形变换,产生输 出信号 y k,网络训练的每个样本包括输入向量x 和期望输出量d,网络输出值y 与期望输出值 d 之间的偏差,通过调整输入节点与隐层节点的联接强度取值w ij和隐层节点与输出节点之间的联接强度T jk以及阈值,使误差沿梯度方向下降,经过反复学习训练, 确定与最小误差相对应的网络参数(权值和阈值),训练即告停止。此时经过训练的神经网络即能对类似样本的输入信息,自行处理输出误差最小的经过非线形转换的信息。 变量定义: 设输入层有 n 个神经元,隐含层有p 个神经元 , 输出层有 q 个神经元 输入向量: x x1 , x2 ,L , x n 隐含层输入向量:hi hi1, hi2 ,L , hi p 隐含层输出向量:ho ho1 , ho2 ,L ,ho p 输出层输入向量:yi yi1, yi2 ,L , yi q 输出层输出向量:yo yo1, yo2 ,L , yo q 期望输出向量 : do d1, d2 ,L , d q 输入层与中间层的连接权值:w ih 隐含层与输出层的连接权值:w ho 隐含层各神经元的阈值: b h 输出层各神经元的阈值:b o 样本数据个数 :k1,2,L m 激活函数 : f 误差函数: e 1 q(d o (k )yo o (k )) 2 2 o1

算法步骤: Step1. 网络初始化 。给各连接权值分别赋一个区间( -1 , 1)内的随机数,设定 误差函数 e ,给定计算精度值 和最大学习次数 M 。 Step2. 随机选取第 k 个输入样本 x( k) x 1( k ), x 2 (k),L , x n (k ) 及对应期望输出 d o ( k) d 1 (k ), d 2 ( k),L , d q (k) Step3. 计算隐含层各神经元的输入 n hi h ( k) w ih x i (k ) b h h 1,2,L , p 和输出 i 1 ho h (k) f (hi h (k )) h 1,2, L , p 及 输 出 层 各 神 经 元 的 输 入 p yi o (k ) w ho ho h (k) b o o 1,2,L q 和输出 yo o ( k) f ( yi o (k )) o 1,2, L , p h 1 Step4. 利用网络期望输出和实际输出, 计算误差函数对输出层的各神经元的偏导 数 o (k ) 。 e e yi o w ho yi o w ho p yi o ( k) ( h w ho ho h (k ) b o ) ho h (k ) w ho w ho e ( 1 q (d o ( k) yo o (k))) 2 2 o 1 ( d o (k ) yi o yi o (d o (k) yo o (k ))f ( yi o (k )) @ o (k ) Step5. 利用隐含层到输出层的连接权值、输出层的 差函数对隐含层各神经元的偏导数 h (k ) 。 e e yi o o ( k) ho h (k ) w ho yi o w ho e e hi h (k) w ih hi h ( k) w ih n hi h (k ) ( w ih x i (k ) b h ) i 1 x i ( k) w ih w ih yo o (k )) yo o (k ) o ( k) 和隐含层的输出计算误

人工神经网络在蕨类植物生长中的应用 摘要:人工神经网络(ARTIFICIAL NEURAL NETWORK,简称ANN)是目前国际上一门发展迅速的前沿交叉学科。为了模拟大脑的基本特性,在现代神经科学研究的基础上,人们提出来人工神经网络的模型。根据此特点结合蕨类植物的生长过程进行了蕨类植物生长的模拟。结果表明,人工神经网络的模拟结果是完全符合蕨类植物的生长的,可有效的应用于蕨类植物的生长预测。 关键词:人工神经网络;蕨类植物;MATLAB应用 一人工神经网络的基本特征 1、并行分布处理:人工神经网络具有高度的并行结构和并行处理能力。这特别适于实时控制和动态控制。各组成部分同时参与运算,单个神经元的运算速度不高,但总体的处理速度极快。 2、非线性映射:人工神经网络具有固有的非线性特性,这源于其近似任意非线性映射(变换)能力。只有当神经元对所有输入信号的综合处理结果超过某一门限值后才输出一个信号。因此人工神经网络是一种具有高度非线性的超大规模连续时间动力学系统。 3、信息处理和信息存储合的集成:在神经网络中,知识与信息都等势分布贮存于网络内的各神经元,他分散地表示和存储于整个网络内的各神经元及其连线上,表现为神经元之间分布式的物理联系。作为神经元间连接键的突触,既是信号转换站,又是信息存储器。每个神经元及其连线只表示一部分信息,而不是一个完整具体概念。信息处理的结果反映在突触连接强度的变化上,神经网络只要求部分条件,甚至有节点断裂也不影响信息的完整性,具有鲁棒性和容错性。 4、具有联想存储功能:人的大脑是具有联想功能的。比如有人和你提起内蒙古,你就会联想起蓝天、白云和大草原。用人工神经网络的反馈网络就可以实现这种联想。神经网络能接受和处理模拟的、混沌的、模糊的和随机的信息。在处理自然语言理解、图像模式识别、景物理解、不完整信息的处理、智能机器人控制等方面具有优势。 5、具有自组织自学习能力:人工神经网络可以根据外界环境输入信息,改变突触连接强度,重新安排神经元的相互关系,从而达到自适应于环境变化的目的。 二人工神经网络的基本数学模型 神经元是神经网络操作的基本信息处理单位(图1)。神经元模型的三要素为: (1) 突触或联接,一般用,表尔神经元和神经元之间的联接强度,常称之为权值。 (2) 反映生物神经元时空整合功能的输入信号累加器。 图1 一个人工神经元(感知器)和一个生物神经元示意图 (3) 一个激活函数用于限制神经元输出(图2),可以是阶梯函数、线性或者是指数形式的

BP神经网络模型与学习算法 一,什么是BP "BP(Back Propagation)网络是1986年由Rumelhart和McCelland为首的科学家小组提出,是一种按误差逆传播算法训练的多层前馈网络,是目前应用最广泛的神经网络模型之一。BP网络能学习和存贮大量的输入-输出模式映射关系,而无需事前揭示描述这种映射关系的数学方程。它的学习规则是使用最速下降法,通过反向传播来不断调整网络的权值和阈值,使网络的误差平方和最小。BP神经网络模型拓扑结构包括输入层(input)、隐层(hide layer)和输出层(output layer)。" 我们现在来分析下这些话: “是一种按误差逆传播算法训练的多层前馈网络” BP是后向传播的英文缩写,那么传播对象是什么?传播的目的是什么?传播的方式是后向,可这又是什么意思呢。 传播的对象是误差,传播的目的是得到所有层的估计误差,后向是说由后层误差推导前层误差: 即BP的思想可以总结为 利用输出后的误差来估计输出层的直接前导层的误差,再用

这个误差估计更前一层的误差,如此一层一层的反传下去,就获得了所有其他各层的误差估计。 “BP神经网络模型拓扑结构包括输入层(input)、隐层(hide layer)和输出层(output layer)” 我们来看一个最简单的三层BP: “BP网络能学习和存贮大量的输入-输出模式映射关系,而无需事前揭示描述这种映射关系的数学方程。” BP利用一种称为激活函数来描述层与层输出之间的关系,从而模拟各层神经元之间的交互反应。 激活函数必须满足处处可导的条件。那么比较常用的是一种称为S型函数的激活函数: 那么上面的函数为什么称为是S型函数呢: 我们来看它的形态和它导数的形态: p.s. S型函数的导数:

神经网络典型模型的比较研究 杜华英1,赵跃龙2 (中南大学信息科学与工程学院,湖南长沙 410083) 摘要神经网络是近年来发展起来的一门新兴学科,具有较高的研究价值,本文介绍了神经网络的基本概念,针对神经网络在不同的应用领域如何选取问题,对感知器、BP网络、Hopfield网络和ART网络四种神经网络模型在优缺点、有无教师方式、学习规则、正反向传播、应用领域等方面进行了比较研究。可利用其特点有针对性地将神经网络应用于计算机视觉、图像处理、模式识别、信号处理、智能监控、机器人等不同领域。 关键词神经网络;感知器;BP网络;Hopfield网络;ART网络 1 引言 人工神经网络(Artificial Neural Network, ANN)是模仿生物神经网络功能的一种经验模型。生物神经元受到传入的刺激,其作出的反应又从输出端传到相连的其它神经元,输入和输出之间的变换关系一般是非线性的。神经网络是由若干简单元件及其层次组织,以大规模并行连接方式构造而成的网络,按照生物神经网络类似的方式处理输入的信息。模仿生物神经网络而建立的人工神经网络,对输入信号有功能强大的反应和处理能力。 若干神经元连接成网络,其中的一个神经元可以接受多个输入信号,按照一定的规则转换为输出信号。由于神经网络中神经元间复杂的连接关系和各神经元传递信号的非线性方式,输入和输出信号间可以构建出各种各样的关系,因此在运行网络时,可视为一个“黑箱”模型,不必考虑其内部具体情况。人工神经网络模拟人类部分形象思维的能力,是模拟人工智能的一条途径,特别是可以利用人工神经网络解决人工智能研究中所遇到的一些难题。目前,人工神经网络理论的应用已经渗透到多个领域,在计算机视觉、图像处理、模式识别、信号处理、智能监控、机器人等方面取得了可喜的进展。 2 神经网络的典型模型 在人们提出的几十种神经网络模型中,人们用得较多的是感知器、BP网络、Hopfield 网络和ART网络。 2.1 感知器[2] 罗森勃拉特(Rosenblatt)于1957年提出的感知器模型是一组可训练的分类器,为最古老的ANN之一,现已很少使用。然而,它把神经网络的研究从纯理论探讨引向了工程上的实现,在神经网络的发展史上占有重要的地位。尽管它有较大的局限性,甚至连简单的异或(XOR)逻辑运算都不能实现,但它毕竟是最先提出来的网络模型,而且它提出的自组织、自学习思想及收敛算法对后来发展起来的网络模型都产生了重要的影响,甚至可以说,后来发展的网络模型都是对它的改进与推广。 最初的感知器是一个只有单层计算单元的前向神经网络,由线性阈值单元组成,称为单层感知器,后来针对其局限性进行了改进,提出了多层感知器。 1杜华英(1975—),女,江西樟树人,惠州学院成教处计算机工程师,主研人工智能,中南大学信息科学与工程学院在读工程硕士。 2赵跃龙(1958—),男,湖南湘潭人,中南大学信息科学与工程学院计算机系教授,主要从事计算机体系结构、磁盘阵列、计算机控制、神经网络应用等方面的研究。