第12卷第4期2006年8月

上海大学学报(自然科学版)

JOURNA L OF SH ANG H AI UNI VERSITY (NAT URA L SCIE NCE )

V ol.12N o.4Aug.2006

收稿日期:2005208230 基金项目:国家自然科学基金资助项目(20503015);上海市教委自然科学一般资助项目(05AZ 67)通信作者:李国正(1977~),男,副研究员,博士,研究方向为机器学习、特征选择和数据挖掘.E 2mail :gzli @https://www.doczj.com/doc/884971979.html,

文章编号:100722861(2006)0420415204

基于主成份分析的B agging 集成学习方法

何 鸣

1,2

, 李国正

1,2

, 袁 捷1, 吴耿锋

1

(1.上海大学计算机工程与科学学院,上海200072;2.南京大学计算机软件新技术国家重点实验室,南京210093)

摘要:机器学习中数据集的冗余特征会影响学习器的泛化能力,一些流行方法如支持向量机和集成学习也难免于此.研究了利用主成份分析进行特征变换对Bagging 集成学习算法的影响,提出一种称为PC A 2Bagging 的算法,并与其它算法比如单个支持向量机、支持向量机Bagging 集成、带有特征变换的单个支持向量机等进行了性能比较.在多个UCI 标准数据集上的实验表明PC A 2Bagging 算法具有更好的性能,这说明即使是泛化能力很强的集成学习方法其学习的数据也需要进行适当的特征变换.关键词:集成学习;主成份分析;支持向量机中图分类号:TP 18 文献标识码:A

PCA B ased B agging E nsemble Methods

HE Ming

1,2

, LI G uo 2zheng

1,2

, Y UAN Jie 1, W U G eng 2feng

1

(1.School of C om puter Engineering and Science ,Shanghai University ,Shanghai 200072,China ;2.S tate K ey Laboratory for N ovel S oftware T echnology ,Nanjing University ,Nanjing 210093,China )

Abstract :Redundant features in data sets hurt the generalization performance of learning machines.Even the

state 2of 2arts alg orithms such as support vector machine (S VM )and ensemble learning are not immune to it.This paper studies the effect of feature trans formation with principal com ponent analysis (PC A )on bagging method of ensemble learning.This paper proposes a new method termed PC A 2bagging ,which is com pared with other methods such as single S VM ,bagging of S VM and S VM with PC A.Experiments on UCI machine learning benchmark data sets show that PC A 2bagging has better generalization performance ,indicating that even ensemble learning methods with excellent generalization ability als o need proper feature preprocessing.K ey w ords :ensemble learning ;principal com ponent analysis ;support vector machine

随着数据采集和数据存储技术的飞跃发展,用于机器学习的数据集规模越来越大,描述样例的特征中冗余特征的比例也越来越高,这些冗余特征极大地损害学习器的泛化能力

[122]

,即使是一些流行学习器,如支持向量机和集成学习方法也要受其影响,因此提出了多种数据预处理方法,一种思路是进行特征的选择,去除冗余特征,比如Y u 和Liu 等提出

的特征选择框架

[1]

;一种是对特征进行变换,如线性

的主成份分析PC A (Principal C om ponent Analysis )[3]

和非线性的局部线性嵌入方法.

为了提高学习器的泛化能力,近几年有若干新的理论和方法提出,其中支持向量机和集成学习方

法受到研究者的极大关注.支持向量机S VM (Support Vector Machines )

[425]

是在统计学习理论基础上提出

的,利用结构风险最小化的原则建立目标函数,通过二次凸规划来解决,得到最优解,具有良好的泛化能力,在模式识别[4]、计算机安全[6]、化学化工[7]等多个领域得到了很好的结果.集成学习可以有效提高单个学习器的泛化能力,利用支持向量机作为其个体学习器,可望得到更好的泛化性能.Bagging是目前集成学习中较具代表性的一种[829].

尽管支持向量机集成可以具有很好的泛化性能,但是仍会受到数据集中的冗余特征的影响,所以需要对数据进行适当处理.本文提出使用主成份分析方法对数据进行变换之后,再进行集成学习.所提出的PC A2Bagging算法将在若干UCI标准数据集上进行评测,所比较的算法包括单个支持向量机、带有特征变换的单个支持向量机、支持向量机集成等.结果发现主成份分析通过对数据集进行变换可以进一步提高支持向量机集成算法的泛化性能.

1 PCA2B agging算法

支持向量机算法在20世纪90年代提出,之后获得极大发展[528].它建立在统计学习理论基础上,根据有限的样本信息在模型的复杂性和学习能力之间寻求最佳折衷,以期获得最好的泛化能力.Bagging 是一种把多个不同的个体学习器集成成为一个学习器的一种集成学习方法[829],其理论基础是通过可重复取样得到不同的数据子集,使得在不同数据子集上训练得到的个体学习器具有较高的泛化性能同时具有较大的差异度.该算法用从原始训练集中随机抽取的若干样例来训练模型,得到的预测集合体在预测一个类标的时候,采取投票方式,取多个预测类标中出现次数最多的那个类标为该样例的最后类标.在分类应用中显示出Bagging方法可以获得稳定的和更高的精度.

支持向量机集成会受到数据集中冗余特征的影响.冗余特征的处理方法有多种.主成份分析PC A 进行数据变换是一种经典方法,它是将分散在一组变量上的信息集中到某几个综合指标(主成份)上的探索性的统计分析方法.把原来具有一定相关性的众多指标重新组合成一组新的相互无关的综合指标来代替原来指标,从而具有重要的优良性质:使变换后产生的新的分量正交或不相关;以部分新的分量表示原向量均方误差最小;使变换向量更趋确定、信息量更趋集中等.鉴于此,我们提出利用主成份分析进行特征变换,然后在变换后的数据集上进行支持向量机的集成学习,算法命名为PC A2Bagging.下面

是该算法的详细情况.

算法:PC A2Bagging.

输入:一个完整的数据集D,由连续数值属性表示,每个样本均包括目标值;

输出:测试数据的集成预测正确率.

方法:

Step1:对D进行PC A变换D→D′;

Step2:对D′进行标准化,对数据集随机划分为训练集和测试集D′→D

tr

,D ts;

Step3:在D tr中用Bootstrap方法得到K个训练子集,并训练K个S VM个体模型;

Step4:用K个S VM个体模型预测D ts,得到K 个预测结果,对K个结果进行集成,得到测试集最终的预测结果.

该算法首先对整个原始数据集D(R×C)进行PC A变换得到新的特征集D′,其中R是数据集的样例个数,C是数据集的特征个数.变换后数据的分布经过重新调整.

为了评价算法的泛化能力,我们把经过变换后的数据集D′随机地划分为两部分:一部分是训练集D tr,另一部分是测试集D ts.训练集用于训练模型,而测试集用于测试模型的泛化能力,训练集和测试集的交集为空.Bagging集成学习需要把训练集用Bootstrap方式再进行划分.每次都从D tr中随机抽取

一定比例数量的样本成为一个小数据集D

i

,i∈[1,K],其中K为集成中所需模型个体数.由于每次

均是从D

tr

取样本,所以有些样本可能会被多次取到,而有些样本一次也不会被取到.但是运行PC A2 Bagging一遍就要进行K轮抽取,一共要运行N遍.如果抽取次数大于样例个数R,平均每个样例都会被取到一次.在实验当中,抽取次数会远远大于样本数R,因此一个样本一次也不会被抽取到的概率几乎为0.

每一个D

i

训练一个S VM个体模型,这些S VM 个体之间的差异越大,集成效果将会更好.在训练这些S VM模型时,S VM的核函数及其参数均取相同的值.

把得到的多个S VM个体模型用于预测,一个样例在不同的个体模型中预测会得到相同的或不同的结果.对于分类问题来说,一个样本在不同的模型中预测会得到相同或不同的类标.在K个结果中,我

614 上海大学学报(自然科学版)第12卷

们采取相对投票的方法,少数服从多数,把得到票数最多的那个类标作为该样本的最终类标.最后统计测试数据集所有样本的预测精度.

由于在训练集和测试集的划分过程中,以及在Bootstrap抽取样本的过程中都具有相当的随机性,一次运行得到的结果并不能说明问题.为了得到统计结果,对整个过程重复计算N遍,最后取其均值并计算它们的方差.这样做可以保证实验结果的有效性和可比性.

PC A2FS2Bagging(FS:Feature Selection)算法是在PC A2Bagging的基础上作了一些改进.在对原始数据集进行PC A变换(D→D′)后,数据集D′特征根据信息量大小排序,把信息量大的特征排在数据集的前面部分.数据集后面部分特征对整个数据集贡献很小.去除这些贡献小的特征来减少算法运算的复杂度,会提高该数据集的质量,还会提高算法的预测精度.在实验的过程中,保留前面累计贡献在P%的特征子集,作为特征选择的结果,去除剩余的特征.发现数据集不同,特征子集中特征数占原始特征集特征数的百分比也不同.有的数据集删除特征数比例较大,有的较小.经过特征选择后,数据集的规模都有不同程度的降低.PC A2FS2Bagging算法是在PC A2 Bagging算法的基础加上了特征选择,PC A2FS2Bagging 的Bagging部分同于PC A2Bagging.

2 实验及其结果分析

为了评测PC A2Bagging算法,本文还实现了其它几种算法:①单个支持向量机算法,S VM;②带有PC A做特征变换的支持向量机算法,PC A2S VM;③支持向量机集成,S VM2Bagging;④带有PC A做特征选择的支持向量机集成算法,PC A2FS2Bagging.

实验数据采用UCI机器学习标准评测数据集[10].本文选择其中10个数据集进行实验,数据集的具体信息如表1所示.为了比较不同算法,对于每个数据集,实验中使用径向基核函数的支持向量机,并采用相同的参数,如:C为10和σ为0.1,其中参数C为函数惩罚因子,参数σ为径向基函数的半径.实验中集成个体数为20,即K=20.算法PC A2 FS2Bagging中的P取值范围是90%~100%.当P= 100%时,PC A2FS2Bagging算法即为PC A2Bagging算法.由于不同数据集的冗余程度不同,因此P取值也不同.为了寻找每个数据集的冗余程度,计算了每个数据集在P的每一个取值上的结果,取其中精度最高的作为最后的结果.

表1 实验所用UCI数据集的信息

T ab.1 The used UCI d ata sets

序号数据集名称样本个数R特征个数C类别个数1G lass214 9 7

2Wine178133

3Proc-h294132

4Proc-c303135

5S oy-a3073419

6I onosphere351352

7S tatlog-heart270132

8Audio2267024

9Breast-cancer69992

10Backup6833519

由于本文算法采用了Bootstrap抽样方法,其中算法的随机性影响到结果.为了得到较准确和稳定的统计结果,每个算法在每个数据集上都训练和测试50次(N=50),最后计算50个结果的均值和方差.所有结果均在表2列出.

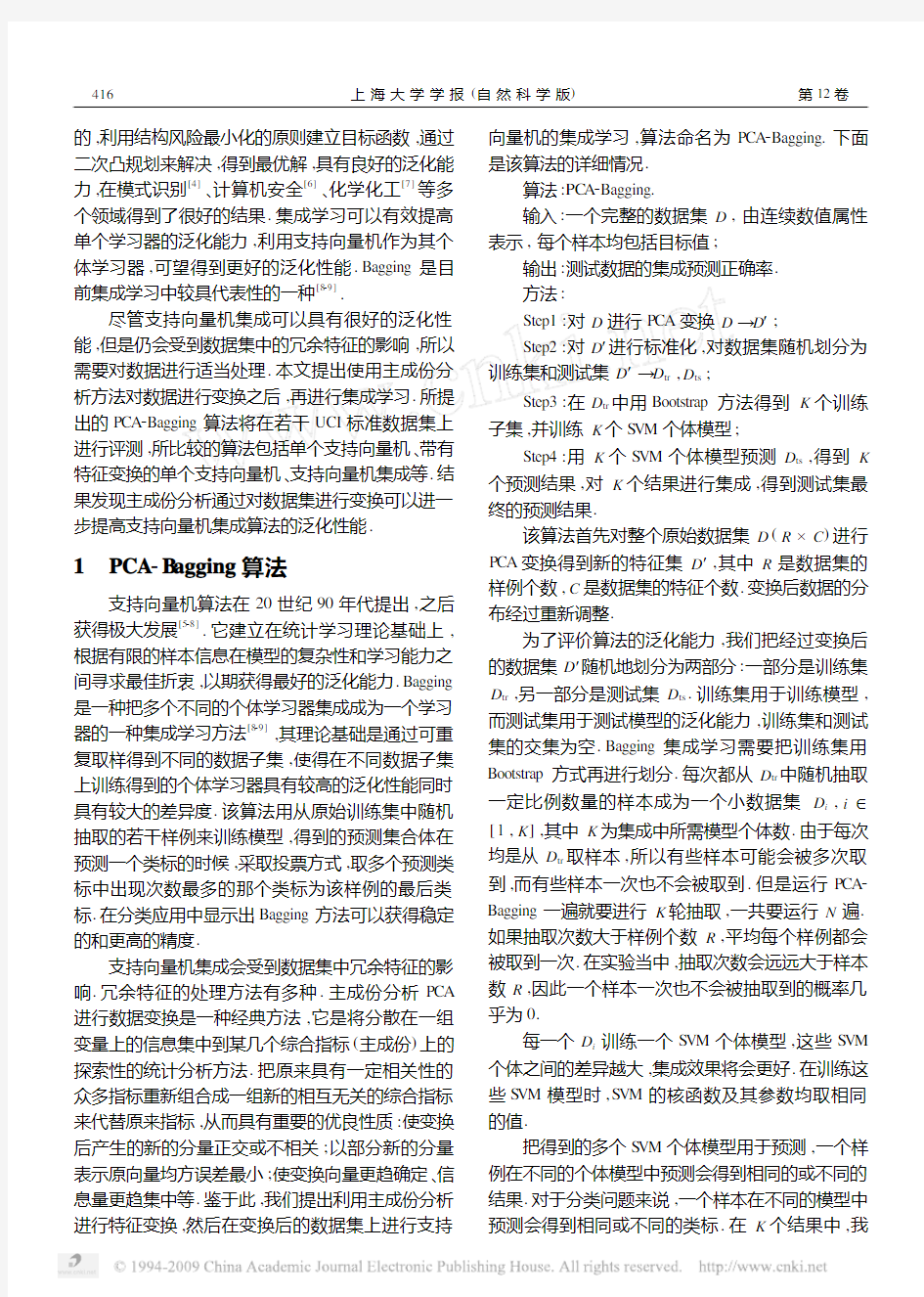

从表2可以看出以下几点:

(1)集成可以提高预测精度

首先是S VM和S VM2Bagging的比较,不管是从10个数据集整体进行比较,还是单个数据集比较,集成的结果均明显要好于未集成的结果.10个数据集上集成算法的平均预测精度是82.17%,而单个S VM算法的平均预测精度只有79.12%,集成比未集成高出3.05个百分点.在PC A2S VM与PC A2 Bagging的结果中,10个数据集的集成(PC A2Bagging)平均预测精度高于未集成(PC A2S VM)的平均预测精度2.88个百分点.从实验中可以得出结论:集成可以较明显地提高预测精度.

(2)PC A对集成的影响

PC A对S VM集成预测有所提高.从统计结果上看,对于Bagging算法,通过PC A变换的数据集可以提高0.32个百分点.数据集1、2、3、5、8、10经过PC A 后比S VM2Bagging有提高.

(3)对于PC A所得数据进行特征选择对集成算法的影响

总的来说,PC A变换后的数据集进行特征选择对集成学习算法泛化能力会有所提高.把PC A2 Bagging看作是包含100%特征的PC A2FS2Bagging方法,那么包括采用100%特征在内的PC A2FS2Bagging

714

第4期何 鸣,等:基于主成份分析的Bagging集成学习方法

表2 5种算法在UCI数据集上实验的统计结果

T ab.2 Statistical results of five different algorithms on the selected UCI d ata sets%数据集S VM S VM2Bagging PC A2S VM PC A2Bagging PC A2FS2Bagging 160.79±4.8566.53±5.0163.75±4.4168.03±5.0868.03±5.08(100%) 297.01±1.7997.81±2.1597.06±1.8597.85±1.7797.85±1.77(100%) 375.28±3.9379.50±3.4875.69±4.9380.59±3.2480.59±3.24(100%) 450.86±3.7055.78±4.6949.42±4.6655.56±3.9356.89±4.42(98%) 583.49±3.5087.11±2.9286.39±3.1187.24±3.3587.24±3.35(100%) 686.80±2.9390.67±2.5587.68±3.2589.54±2.9690.90±2.96(92%) 776.00±3.2080.99±3.4775.26±3.8980.72±3.8581.80±3.31(97%) 875.12±3.9275.37±5.0178.48±4.1776.93±4.3177.22±5.30(99%) 991.64±1.9295.23±1.1391.55±1.9294.81±1.2795.37±1.21(93%) 1094.25±1.3192.74±1.8290.85±2.6393.66±1.6093.66±1.60(100%)

平均79.12±3.0082.17±3.2279.61±3.4882.49±3.1482.96±3.22(98%)

的平均预测结果比PC A2Bagging的平均结果高0.47个百分点.PC A2FS2Bagging能够提高绝大部分数据集的预测精度.除了第8和第10个数据集,在5种方法中,PC A2FS2Bagging都取得了最好的结果.如果不包含PC A2Bagging的结果,数据集4、6、7和9在全部实验的结果中PC A2FS2Bagging的预测结果也是最高的.因此可以说,在PC A数据上的特征选择可以提高集成预测精度,对于集成有着积极的影响.

图1是数据集6在P值筛选实验中进行10次运行的结果.尽管在随机性的影响下,从图中还是可以看出,整个曲线的趋势是中间高,两边低.在特征累计贡献数达到92%(保留了前18个特征)时,也就是去除了PC A变换后排在最后面的累计贡献到8%的冗余特征(后17个特征)后的预测精度达到了最大值.冗余特征的存在降低了数据的质量,会降低学习器泛化能力.通过去除数据中的冗余特征可以提高学习器的预测能力和泛化能力.

3 结 论

本文研究了特征变换用于支持向量机集成的前处理问题,通过主成份分析进行数据的特征变换,然后利用支持向量机集成等算法在变换后的数据集上进行学习,并在多个UCI数据集上验证.

数据集中冗余特征会影响集成学习方法的学习效果,本文通过主成份分析来选择特征去除其影响

,

图1 数据集6上不同P值下PCA2FS2B agging算法结果Fig.1 R esults of PCA2FS2B agging on the6th d ata set using different P values

这仅仅是初步的研究,进一步可以研究一些非线性的特征变换方法和特征选择方法对于去除冗余特征以提高集成学习算法的性能.另外的一个工作是要研究冗余特征对于其它集成学习方法的影响,比如Boosting方法.

参考文献:

[1] Y U L,LI U H.E fficient feature selection via analysis of

relevance and redundancy[J].Journal of Machine Learning

Research,2004,5:120521224.

[2] 李国正.特征选择若干新方法的研究[D].上海:上海

交通大学,2004:1217.

(下转第427页)

814 上海大学学报(自然科学版)第12卷

(2)由试样断口可知,软质相F在断裂过程中被拉长,B等硬质相从F中拔出形成韧窝,因此试验用TRIP钢的断口为韧窝花样,属于塑性断裂.

参考文献:

[1] 李麟,符仁钰,许洛萍,等.相变诱发塑性钢的研究进

展[J].上海金属,2000,22(3):328.

[2] Z ACH AY V F,PACHER E R.The Enhancement of

ductility on high2strength steels[J].T rans Am S oc Mat,

1967,60(2):2522258.

[3] DE MEYER M,VANDERSCH UERE N D,DE C OOM AN B

C.In fluence of the substitution of S i by Al on the propertied

of cold rolled C2Mn2S i TRIP steels[J].ISI J International,

1999,39(8):8132822.

[4] ANDRE AS P,PETER S.TRIP steel with reduced silicon

content[J].S teel Research,1999,70(11):4592465. [5] LI L,SI W,FU R Y,et al.C om position design and

mechanical properties of cold rolled TRIP steel[M].

Beijing:Mechanical Industry Press,2000:299.

[6] ANDRE AS P,PETER S.TRIP steel with reduced silicon

content[J].S teel Research,1999,70(11):4592465.[7] 韦习成,李麟,符仁钰.TRIP钢显微组织与性能关系

评述[J].钢铁研究学报,2001,13(5):71276.

[8] TRAI NT S,PICH LER A R,H AUZE NBERGER K.

In fluence of silion,aluminium,phosphorus and cooper on

the phade trans formations of low alloyed TRIP2steels[J].

S teel Research,2002,73(627):2592266.

[9] BANABIC D.Limit strains in the sheet metals by using the

new Hill’s yield criterion(1993)[J].Journal of Materials

Processing T echnology,1999,(92293):4292432.

[10] WEI X C,LI L,FU R Y.On the tensile mechanical

property of S i2Mn TRIP steels at high strain rate[J].ACT A

Metallurgical S inica(English Letters),2002,15(3):2852

294.

[11] Z OU H2H,LI L,FU R Y.E ffect of retained austenite

stability of S i2Mn TRIP steel on the product of strength and

ductility[J].S teel Research,2002,73(627):3172320. [12] 苏钰,符仁钰,李麟,等.低硅S i2Mn系TRIP钢的组织

和力学性能[J].上海大学学报:自然科学版,2005,11

(1):71274.

(编辑:刘志强)

(上接第418页)

[3] 陈念贻,钦佩,陈瑞亮,等.模式识别方法在化学化工

中的应用[M].北京:科学出版社,2000:25231.

[4] 刘向冬,朱美琳,陈兆乾,等.支持向量机及其在模式

识别中的应用[J].计算机科学,2003,30(6):1132117.

[5] CRIS TI ANI NI N,SH AWE2T AY LOR J.支持向量机导论

[M].李国正,王猛,曾华军译.北京:电子工业出版

社,2004:12139.

[6] 刘学军,陈松灿,彭宏京.基于支持向量机的计算机键

盘用户身份验真[J].计算机研究与发展,2002,39(9):

108221086.

[7] CHE N N Y,LU W2C,Y ANG J,et al.Support vector

machines in Chemistry[M].S ingapore:W orld Scientific

Publishing C om pany,2004:742305.

[8] BREI M AN L.Bagging predictors[J].Machine Learning,

1996,24(2):1232140.

[9] 周志华,陈世福.神经网络集成学习[J].计算机学报,

2002,25(1):128.

[10] BLAKE C,KE OG H E,MERZ C J.UCI repository of

machine learning databases[RΠO L].Department of

In formation and C om puter Science,University of California,

Irvine,C A,1998[2005205210].http:ΠΠw w https://www.doczj.com/doc/884971979.html,Π

mlearnΠM LRepository.htm.

(编辑:刘志强)

724

第4期苏 钰,等:低碳含硅TRIP钢断裂机理的研究

主成分分析( Principal Component Analysis , PCA )是一种掌握事物主要矛盾的统计分析方法,它可以从多元事物中解析出主要影响因素,揭示事物的本质,简化复杂的问题。计算主成分的目的是将高维数据投影到较低维空间。给定 n 个变量的 m 个观察值,形成一个 n*m 的数据矩阵, n 通常比较大。对于一个由多个变量描述的复杂事物,人们难以认识,那么是否可以抓住事物主要方面进行重点分析呢?如果事物的主要方面刚好体现在几个主要变量上,我们只需要将这几个变量分离出来,进行详细分析。但是,在一般情况下,并不能直接找出这样的关键变量。这时我们可以用原有变量的线性组合来表示事物的主要方面, PCA 就是这样一种分析方法。 PCA 的目标是寻找 r ( r 高校人文社科科研综合实力评价研究 摘要 一、问题重述 高校人文社科科研综合实力评价研究 根据所给数据,并搜集更多相关数据,回答下面的问题 1.研究数据之间的内在关系; 2.设计几种方案对各省市科研实力进行综合评价并进行分类,论证方法的合 理性,给出合适的建议 二、条件假设 (1)假设高校人文社科科研指标在一定程度上会反映高校的人文社科科研综合实力 (2)假设资料所提供数据准确有效 三、符号约定x—同一葡萄酒样品的平均值 _ 四、问题分析 3.主成分分析法 建立模型:基于主成分分析法研究高校人文社科科研综合实力 影响高校人文社科科研综合实力的成分有很多,例如投入的人年数,投入科研事业经费,课题总数等等。常用于研究各变量对结果影响因素的方法有多元回归分析、主成分分析、因子分析、回归分类树等。每种算法各有各的特点,本文尝试选取主成分分析法。 主成分分析:PCA 是将多指标重新组合成一组新的无相关的几个综合指标,是根据实际需要从中选取尽可能少的综合指标,以达到尽可能多地反应原指标信息的分析方法。由于这种方法的第一主成分在所有的原始变量中方差最大,因而综合评价函数的方差总不会超过第一主成分的方差,所以该方法有一定的缺陷。 (1)题中共给影响高校人文社科科研综合能力的7种因素,分别是投入人年数、投入高级职称的人年数、投入科研事业费、课题总数等。设各影响因素为 p 2,1,...,x x x ,它们的综合指标——主成分设为:p ,,...,,21 主成分分析的操作过程 原始数据如下(部分) 调用因子分析模块(Analyze―Dimension Reduction―Factor),将需要参与分析的各个原始变量放入变量框,如下图所示: 单击Descriptives按钮,打开Descriptives次对话框,勾选KMO and Bartlett’s test of sphericity选项(Initial solution选项为系统默认勾选的,保持默认即可),如下图所示,然后点击Continue按钮,回到主对话框: 其他的次对话框都保持不变(此时在Extract次对话框中,SPSS已经默认将提取公因子的方法设置为主成分分析法),在主对话框中点OK按钮,执行因子分析,得到的主要结果如下面几张表。 ①KMO和Bartlett球形检验结果: KMO为0.635>0.6,说明数据适合做因子分析;Bartlett球形检验的显著性P值为 0.000<0.05,亦说明数据适合做因子分析。 ②公因子方差表,其展示了变量的共同度,Extraction下面各个共同度的值都大于0.5,说明提取的主成分对于原始变量的解释程度比较高。本表在主成分分析中用处不大,此处列出来仅供参考。 ③总方差分解表如下表。由下表可以看出,提取了特征值大于1的两个主成分,两个主成分的方差贡献率分别是55.449%和29.771%,累积方差贡献率是85.220%;两个特征值分别是3.327和1.786。 ④因子截荷矩阵如下: 根据数理统计的相关知识,主成分分析的变换矩阵亦即主成分载荷矩阵U 与因子载荷矩阵A 以及特征值λ的数学关系如下面这个公式: λi i i A U = 故可以由这二者通过计算变量来求得主成分载荷矩阵U 。 新建一个SPSS 数据文件,将因子载荷矩阵中的各个载荷值复制进去,如下图所示: 计算变量(Transform-Compute Variables )的公式分别如下二张图所示: 主成分分析 类型:一种处理高维数据的方法。 降维思想:在实际问题的研究中,往往会涉及众多有关的变量。但是,变量太多不但会增加计算的复杂性,而且也会给合理地分析问题和解释问题带来困难。一般说来,虽然每个变量都提供了一定的信息,但其重要性有所不同,而在很多情况下,变量间有一定的相关性,从而使得这些变量所提供的信息在一定程度上有所重叠。因而人们希望对这些变量加以“改造”,用为数极少的互补相关的新变量来反映原变量所提供的绝大部分信息,通过对新变量的分析达到解决问题的目的。 一、总体主成分 1.1 定义 设 X 1,X 2,…,X p 为某实际问题所涉及的 p 个随机变量。记 X=(X 1,X 2,…,Xp)T ,其协方差矩阵为 ()[(())(())], T ij p p E X E X X E X σ?∑==-- 它是一个 p 阶非负定矩阵。设 1111112212221122221122T p p T p p T p p p p pp p Y l X l X l X l X Y l X l X l X l X Y l X l X l X l X ?==+++? ==+++?? ??==+++? (1) 则有 ()(),1,2,...,, (,)(,),1,2,...,. T T i i i i T T T i j i j i j V ar Y V ar l X l l i p C ov Y Y C ov l X l X l l j p ==∑===∑= (2) 第 i 个主成分: 一般地,在约束条件 1T i i l l = 及 (,)0,1,2,..., 1.T i k i k C ov Y Y l l k i =∑==- 下,求 l i 使 Var(Y i )达到最大,由此 l i 所确定的 T i i Y l X = 称为 X 1,X 2,…,X p 的第 i 个主成分。 1.2 总体主成分的计算 设 ∑是12(,,...,) T p X X X X =的协方差矩阵,∑的特征值及相应的正交单位化特 征向量分别为 120p λλλ≥≥≥≥ 及 12,,...,, p e e e 则 X 的第 i 个主成分为 1122,1,2,...,,T i i i i ip p Y e X e X e X e X i p ==+++= (3) 此时 (),1,2,...,,(,)0,. T i i i i T i k i k V ar Y e e i p C ov Y Y e e i k λ?=∑==??=∑=≠?? 1.3 总体主成分的性质 1.3.1 主成分的协方差矩阵及总方差 记 12(,,...,) T p Y Y Y Y = 为主成分向量,则 Y=P T X ,其中12(,,...,)p P e e e =,且 12()()(,,...,),T T p Cov Y Cov P X P P Diag λλλ==∑=Λ= 由此得主成分的总方差为 1 1 1 ()()()()(),p p p T T i i i i i i V ar Y tr P P tr P P tr V ar X λ ==== =∑=∑=∑= ∑∑∑ 即主成分分析是把 p 个原始变量 X 1,X 2,…,X p 的总方差 利用Matlab 编程实现主成分分析 1.概述 Matlab 语言是当今国际上科学界 (尤其是自动控制领域) 最具影响力、也是 最有活力的软件。它起源于矩阵运算,并已经发展成一种高度集成的计算机语言。它提供了强大的科学运算、灵活的程序设计流程、高质量的图形可视化与界面设计、与其他程序和语言的便捷接口的功能。Matlab 语言在各国高校与研究单位起着重大的作用。主成分分析是把原来多个变量划为少数几个综合指标的一种统计分析方法,从数学角度来看,这是一种降维处理技术。 1.1主成分分析计算步骤 ① 计算相关系数矩阵 ?? ? ???? ???? ?? ?=pp p p p p r r r r r r r r r R 2 122221 11211 (1) 在(3.5.3)式中,r ij (i ,j=1,2,…,p )为原变量的xi 与xj 之间的相关系数,其计算公式为 ∑∑∑===----= n k n k j kj i ki n k j kj i ki ij x x x x x x x x r 1 1 2 2 1 )() () )(( (2) 因为R 是实对称矩阵(即r ij =r ji ),所以只需计算上三角元素或下三角元素即可。 ② 计算特征值与特征向量 首先解特征方程0=-R I λ,通常用雅可比法(Jacobi )求出特征值 ),,2,1(p i i =λ,并使其按大小顺序排列,即0,21≥≥≥≥p λλλ ;然后分别求 出对应于特征值i λ的特征向量),,2,1(p i e i =。这里要求i e =1,即112 =∑=p j ij e ,其 中ij e 表示向量i e 的第j 个分量。 ③ 计算主成分贡献率及累计贡献率 主成分i z 的贡献率为 ),,2,1(1 p i p k k i =∑=λ λ 累计贡献率为 ) ,,2,1(11 p i p k k i k k =∑∑==λ λ 一般取累计贡献率达85—95%的特征值m λλλ,,,21 所对应的第一、第二,…,第m (m ≤p )个主成分。 ④ 计算主成分载荷 其计算公式为 ) ,,2,1,(),(p j i e x z p l ij i j i ij ===λ (3) 一、概述 在处理信息时,当两个变量之间有一定相关关系时,可以解释为这两个变量反映此课题的信息有一定的重叠,例如,高校科研状况评价中的立项课题数与项目经费、经费支出等之间会存在较高的相关性;学生综合评价研究中的专业基础课成绩与专业课成绩、获奖学金次数等之间也会存在较高的相关性。而变量之间信息的高度重叠和高度相关会给统计方法的应用带来许多障碍。 为了解决这些问题,最简单和最直接的解决方案是削减变量的个数,但这必然又会导致信息丢失和信息不完整等问题的产生。为此,人们希望探索一种更为有效的解决方法,它既能大大减少参与数据建模的变量个数,同时也不会造成信息的大量丢失。主成分分析正式这样一种能够有效降低变量维数,并已得到广泛应用的分析方法。 主成分分析以最少的信息丢失为前提,将众多的原有变量综合成较少几个综合指标,通常综合指标(主成分)有以下几个特点: ↓主成分个数远远少于原有变量的个数 原有变量综合成少数几个因子之后,因子将可以替代原有变量参与数据建模,这将大大减少分析过程中的计算工作量。 ↓主成分能够反映原有变量的绝大部分信息 因子并不是原有变量的简单取舍,而是原有变量重组后的结果,因此不会造成原有变量信息的大量丢失,并能够代表原有变量的绝大部分信息。 ↓主成分之间应该互不相关 通过主成分分析得出的新的综合指标(主成分)之间互不相关,因子参与数据建模能够有效地解决变量信息重叠、多重共线性等给分析应用带来的诸多问题。 ↓主成分具有命名解释性 总之,主成分分析法是研究如何以最少的信息丢失将众多原有变量浓缩成少数几个因子,如何使因子具有一定的命名解释性的多元统计分析方法。 二、基本原理 主成分分析是数学上对数据降维的一种方法。其基本思想是设法将原来众多的具有一定相关性的指标X1,X2,…,XP (比如p 个指标),重新组合成一组较少个数的互不相关的综合指标Fm 来代替原来指标。那么综合指标应该如何去提取,使其既能最大程度的反映原变量Xp 所代表的信息,又能保证新指标之间保持相互无关(信息不重叠)。 设F1表示原变量的第一个线性组合所形成的主成分指标,即 11112121...p p F a X a X a X =+++,由数学知识可知,每一个主成分所提取的信息量可 用其方差来度量,其方差Var(F1)越大,表示F1包含的信息越多。常常希望第一主成分F1所含的信息量最大,因此在所有的线性组合中选取的F1应该是X1,X2,…,XP 的所有线性组合中方差最大的,故称F1为第一主成分。如果第一主成分不足以代表原来p 个指标的信息,再考虑选取第二个主成分指标F2,为有效地反映原信息,F1已有的信息就不需要再出现在F2中,即F2与F1要保持独立、不相关,用数学语言表达就是其协方差Cov(F1, F2)=0,所以F2是与F1不 基于因子分析的我国经济发展状况实证分析 摘要:选取了2013年我国31个省、直辖市、自治区经济发展的10项指标作为研究对象,运用因子分析的方法,利用spss对数据进行计算,依据因子分析的结果对我国各省的经济发展做出综合评价,得出了这31各省份经济发展状况的综合排名,广东、江苏、山东、浙江、北京排在前5位,是中国各省、直辖市、自治区沿海经济发展较好的地区;甘肃、海南、青海、宁夏、西藏排在后5位,是西部地区经济发展较落后的地区,较为客观反映了中国各省、直辖市、自治区的综合经济实力,为中国各省、直辖市、自治区今后的经济发展提供了理论依据。 关键词:经济发展;因子分析;综合评价;主成分法 一、引言 我国地域辽阔,由于历史、地理位置及经济基础等原因,各地经济发展水平差异很大。改革开放以来,特别是实施西部大开发、振兴东北地区等老工业基地、促进中部地区崛起、鼓励东部地区率先发展的区域发展总体战略以来,各地经济社会发展水平有了很大提高,人民生活也有了很大改善。但区域发展不协调、发展差距拉大的趋势仍未根本改变。本文从我国31 个省市自治区经济的发展视角入手,运用对应分析方法对我国各地区经济发展状况进行统计分析,用以说明我国各地区经济发展不协调的现状。由于衡量各地区经济发展的指标有很多,故选取了比较有代表性的十个指标。 二、相关统计指标与数据的选取 本文运用了因子分析的方法对我国31个省、直辖市、自治区的经济发展状况进行评价。选取了10项经济指标:第一产业增加值(X1);第二产业增加值(X2);第三产业增加值(X3);地方财政预算收入(X4);地方财政预算支出(X5);固定资产投资额(X6);社会消费品零售总额(X7);货物进出口总额(X8);在岗职工平均工资(X9);城乡居民储蓄年末余额(X10)。X2,X3,X4 反映的是经济总量中构成三大产业的不同增加值;X5,X6 反映的是地方财政预算收支;X7 反映的是居民的购买能力;X8反映的是对外贸易;X9,X10反映的是居民的收入与储蓄。本文数据资料来源于《中国统计年鉴》(2013年),具体数据资料见表1。 表1 各地区经济发展状况(2013) 地区X1 X2 X3 X4 X5 X6 X7 X8 X9 X10 北京11.63 293.03 1316.50 3661.11 4173.66 6847.06 8375.10 4289.96 93997.00 23086.41 天津16.85 612.86 846.57 2079.07 2549.21 9130.25 4470.43 1285.02 68864.00 7612.31 主成分分析法(PCA) 在实际问题中,我们经常会遇到研究多个变量的问题,而且在多数情况下,多个变量之间常常存在一定的相关性。由于变量个数较多再加上变量之间的相关性,势必增加了分析问题的复杂性。如何从多个变量中综合为少数几个代表性变量,既能够代表原始变量的绝大多数信息,又互不相关,并且在新的综合变量基础上,可以进一步的统计分析,这时就需要进行主成分分析。 I. 主成分分析法(PCA)模型 (一)主成分分析的基本思想 主成分分析是采取一种数学降维的方法,找出几个综合变量来代替原来众多的变量,使这些综合变量能尽可能地代表原来变量的信息量,而且彼此之间互不相关。这种将把多个变量化为少数几个互相无关的综合变量的统计分析方法就叫做主成分分析或主分量分析。 主成分分析所要做的就是设法将原来众多具有一定相关性的变量,重新组合为一组新的相互无关的综合变量来代替原来变量。通常,数学上的处理方法就是将原来的变量做线性组合,作为新的综合变量,但是这种组合如果不加以限制,则可以有很多,应该如何选择呢?如果将选取的第一个线性组合即第一个综合变量记为1F ,自然希望它尽可能多地反映原来变量的信息,这里“信息”用方差来测量,即希望)(1F Var 越大,表示1F 包含的信息越多。因此在所有的线性组合中所选取的1F 应该是方差最大的,故称1F 为第一主成分。如果第一主成分不足以代表原来p 个变量的信息,再考虑选取2F 即第二个线性组合,为了有效地反映原来信息,1F 已有的信息就不需要再出现在2F 中,用数学语言表达就是要求 0),(21=F F Cov ,称2F 为第二主成分,依此类推可以构造出第三、四……第p 个主成分。 (二)主成分分析的数学模型 对于一个样本资料,观测p 个变量p x x x ,,21,n 个样品的数据资料阵为: ??????? ??=np n n p p x x x x x x x x x X 21 222 21112 11()p x x x ,,21= 主成分分析计算方法和步骤: 在对某一事物或现象进行实证研究时,为了充分反映被研究对象个体之间的差异, 研究者往往要考虑增加测量指标,这样就会增加研究问题的负载程度。但由于各指标都是对同一问题的反映,会造成信息的重叠,引起变量之间的共线性,因此,在多指标的数据分析中,如何压缩指标个数、压缩后的指标能否充分反映个体之间的差异,成为研究者关心的问题。而主成分分析法可以很好地解决这一问题。 主成分分析的应用目的可以简单地归结为: 数据的压缩、数据的解释。它常被用来寻找和判断某种事物或现象的综合指标,并且对综合指标所包含的信息给予适当的解释, 从而更加深刻地揭示事物的内在规律。 主成分分析的基本步骤分为: ①对原始指标进行标准化,以消除变量在数量极或量纲上的影响;②根据标准化后的数据矩阵求出相关系数矩阵 R; ③求出 R 矩阵的特征根和特征向量; ④确定主成分,结合专业知识对各主成分所蕴含的信息给予适当的解释;⑤合成主成分,得到综合评价值。 结合数据进行分析 本题分析的是全国各个省市高校绩效评价,利用全国2014年的相关统计数据(见附录),从相关的指标数据我们无法直接评价我国各省市的高等教育绩效,而通过表5-6的相关系数矩阵,可以看到许多的变量之间的相关性很高。如:招生人数与教职工人数之间具有较强的相关性,教育投入经费和招生人数也具有较强的相关性,教工人数与本科院校数之间的相关系数最高,到达了0.963,而各组成成分之间的相关性都很高,这也充分说明了主成分分析的必要性。 表5-6 相关系数矩阵 本科院校 数招生人数教育经费投入 相关性师生比0.279 0.329 0.252 重点高校数0.345 0.204 0.310 教工人数0.963 0.954 0.896 本科院校数 1.000 0.938 0.881 招生人数0.938 1.000 0.893 主成分分析的计算步骤 样本观测数据矩阵为: ??????? ??=np n n p p x x x x x x x x x X 21 2222111211 第一步:对原始数据进行标准化处理 )var(*j j ij ij x x x x -= ),,2,1;,,2,1(p j n i == 其中 ∑==n i ij j x n x 1 1 21 )(11)var(j n i ij j x x n x --=∑= ),,2,1(p j = 第二步:计算样本相关系数矩阵 ?????? ????????=pp p p p p r r r r r r r r r R 212222111211 为方便,假定原始数据标准化后仍用X 表示,则经标准化处理后的数据的相关系数为: tj n t ti ij x x n r ∑=-=1 11 ),,2,1,(p j i = 第三步:用雅克比方法求相关系数矩阵R 的特征值(p λλλ 21,)和相应的特征向量()p i a a a a ip i i i 2,1,,,21==。 第四步:选择重要的主成分,并写出主成分表达式 主成分分析可以得到p 个主成分,但是,由于各个主成分的方差是递减的,包含的信息量也是递减的,所以实际分析时,一般不是选取p 个主成分,而是根据各个主成分累计贡献率的大小选取前k 个主成分,这里贡献率就是指某个主成分的方差占全部方差的比重, 实际也就是某个特征值占全部特征值合计的比重。即 贡献率=∑=p i i i 1λ λ 贡献率越大,说明该主成分所包含的原始变量的信息越强。主成分个数k 的选取,主要根据主成分的累积贡献率来决定,即一般要求累计贡献率达到85%以上,这样才能保证综合变量能包括原始变量的绝大多数信息。 另外,在实际应用中,选择了重要的主成分后,还要注意主成分实际含义解释。主成分分析中一个很关键的问题是如何给主成分赋予新的意义,给出合理的解释。一般而言,这个解释是根据主成分表达式的系数结合定性分析来进行的。主成分是原来变量的线性组合,在这个线性组合中个变量的系数有大有小,有正有负,有的大小相当,因而不能简单地认为这个主成分是某个原变量的属性的作用,线性组合中各变量系数的绝对值大者表明该主成分主要综合了绝对值大的变量,有几个变量系数大小相当时,应认为这一主成分是这几个变量的总和,这几个变量综合在一起应赋予怎样的实际意义,这要结合具体实际问题和专业,给出恰当的解释,进而才能达到深刻分析的目的。 第五步:计算主成分得分 根据标准化的原始数据,按照各个样品,分别代入主成分表达式,就可以得到各主成分下的各个样品的新数据,即为主成分得分。具体形式可如下。 ?????? ? ??nk n n k k F F F F F F F F F 212222111211 第六步:依据主成分得分的数据,则可以进行进一步的统计分析 其中,常见的应用有主成份回归,变量子集合的选择,综合评价等。 目录 中文摘要、关键词 (1) 英文摘要、关键词 (1) 正文 (2) 一、引言 (2) 二、上市公司财务指标的选择 (2) 三、财务指标的主成分处理 (4) 四、构造上市公司综合评价指数 (5) 五、实例分析 (6) 六、结果分析 (9) 参考文献 (13) 附表 (14) 股票投资选择中的主成分分析 摘要:股票市场变化莫测,股票价格涨跌无常。如何从众多的上市公司中选择具有投资价值的股票进行投资,进而获得丰厚的投资回报,是许多投资者梦寐以求的一件事。本文运用多元统计分析中的主成分分析方法,通过对上市公司的多个财务指标变量进行主成分处理,构造了上市公司的综合评价指数模型,从而为投资者选择提供一种投资参考。 关键字:主成分分析,股票投资,股票选择 Abstract: The stock market is unpredictable, the rising and dropping of stock prices are variable. How to choose stock with a high investment value from numerous listed companies and then obtaining rich investment repayment are important matters for many investors. This paper utilizes the principal components analysis method of multi-dimensional statistical analysis. By using principal component method to process a number of listed companies financial indicators, it construct a comprehensive evaluation index model of listed companies, thus provide some valuable references for investors. Key worlds: principal components analysis,Stock Investment,Stock options 一、引言 随着我国市场经济的进一步发展,证券投资已成为企业与个人投资的热点,而证券投资是收益与风险并存的一大投资方向。在众多上市公司中,如何选择行业股票,是股票投资者的热门话题,而在同一行业上市公司中,也是良莠不齐,投资者应该用综合的眼光分析上市公司的财务状况和发展潜力,才能选择收益大而风险小的上市公司进行投资。 然而多数投资者并不具备对上市公司进行综合定量分析的能力和方法,而只能从每股收益、每股净资产及净资产收益率三项指标进行简单对比。有些系统分析者采用模糊评判的方法对上市公司的多项指标进行综合分析,但模糊综合评判法的最大缺陷是指标权重的确定问题,指标权重的确定尚未有公认的标准,而简单可行的各种主观确定指标权重的方法难免给问题的分析带来一定的偏差,使决策结果的可信度降低。 对于这类经济决策问题,单纯地运用统计分析又难于达到决策的目的,为此,我们将统计分析与多指标决策结合起来,首先运用多元统计分析中的主成分分析 SPSS软件进行主成分分析的应用例子 SPSS软件进行主成分分析的应用例子 2002年16家上市公司4项指标的数据[5]见表2,定量综合赢利能力分析如下: 公司销售净利率(X1)资产净利率(X2)净资产收益率(X3)销售毛利率(X4) 歌华有线五粮液用友软件太太药业浙江阳光烟台万华方正科技红河光明贵州茅台中铁二局红星发展伊利股份青岛海尔湖北宜化雅戈尔福建南纸43.31 17.11 21.11 29.55 11.00 17.63 2.73 29.11 20.29 3.99 22.65 4.43 5.40 7.06 19.82 7.26 7.39 12.13 6.03 8.62 8.41 13.86 4.22 5.44 9.48 4.64 11.13 7.30 8.90 2.79 10.53 2.99 8.73 17.29 7.00 10.13 11.83 15.41 17.16 6.09 12.97 9.35 14.3 14.36 12.53 5.24 18.55 6.99 54.89 44.25 89.37 73 25.22 36.44 9.96 56.26 82.23 13.04 50.51 29.04 65.5 19.79 42.04 22.72 第一,将EXCEL中的原始数据导入到SPSS软件中; 注意: 导入Spss的数据不能出现空缺的现象,如出现可用0补齐。 【1】“分析”|“描述统计”|“描述”。 【2】弹出“描述统计”对话框,首先将准备标准化的变量移入变量组中,此时,最重要的一步就是勾选“将标准化得分另存为变量”,最后点击确定。 【3】返回SPSS的“数据视图”,此时就可以看到新增了标准化后数据的字段。 所做工作: a. 原始数据的标准化处理 1、主成分法: 用主成分法寻找公共因子的方法如下: 假定从相关阵出发求解主成分,设有p 个变量,则可找出p 个主成分。将所得的p 个主成分按由大到小的顺序排列,记为1Y ,2Y ,…,P Y , 则主成分与原始变量之间存在如下关系: 11111221221122221122....................p p p p p p p pp p Y X X X Y X X X Y X X X γγγγγγγγγ=+++?? =+++??? ?=+++? 式中,ij γ为随机向量X 的相关矩阵的特征值所对应的特征向量的分量,因为特征向量之间彼此正交,从X 到Y 得转换关系是可逆的,很容易得出由Y 到 X 得转换关系为: 11112121212122221122....................p p p p p p p pp p X Y Y Y X Y Y Y X Y Y Y γγγγγγγγγ=+++?? =+++??? ?=+++? 对上面每一等式只保留钱m 个主成分而把后面的部分用i ε代替,则上式变为: 111121211 2121222221122................. ...m m m m p p p mp m p X Y Y Y X Y Y Y X Y Y Y γγγεγγγεγγγε=++++??=++++????=++++? 上式在形式上已经与因子模型相一致,且i Y (i=1,2,…,m )之间相互独立,且i Y 与i ε之间相互独立,为了把i Y 转化成合适的公因子,现在要做的工作只是把主成分i Y 变为方差为1的变量。为完成此变换,必须将i Y 除以其标准差,由主成分分析的知识知其标准差即为特征根的平方根 i λ/i i i F Y λ=, 1122m m λγλγλγ,则式子变为: 一、主成分分析基本原理 概念:主成分分析是把原来多个变量划为少数几个综合指标的一种统计分析方法。从数学角度来看,这是一种降维处理技术。 思路:一个研究对象,往往是多要素的复杂系统。变量太多无疑会增加分析问题的难度和复杂性,利用原变量之间的相关关系,用较少的新变量代替原来较多的变量,并使这些少数变量尽可能多的保留原来较多的变量所反应的信息,这样问题就简单化了。 原理:假定有n 个样本,每个样本共有p 个变量,构成一个n ×p 阶的数据矩阵, 记原变量指标为x 1,x 2,…,x p ,设它们降维处理后的综合指标,即新变量为 z 1,z 2,z 3,… ,z m (m ≤p),则 系数l ij 的确定原则: ①z i 与z j (i ≠j ;i ,j=1,2,…,m )相互无关; ②z 1是x 1,x 2,…,x P 的一切线性组合中方差最大者,z 2是与z 1不相关的x 1,x 2,…,x P 的所有线性组合中方差最大者; z m 是与z 1,z 2,……,z m -1都不相关的x 1,x 2,…x P , 的所有线性组合中方差最大者。 新变量指标z 1,z 2,…,z m 分别称为原变量指标x 1,x 2,…,x P 的第1,第2,…,第m 主成分。 从以上的分析可以看出,主成分分析的实质就是确定原来变量x j (j=1,2 ,…, p )在诸主成分z i (i=1,2,…,m )上的荷载 l ij ( i=1,2,…,m ; j=1,2 ,…,p )。 ?????? ? ???????=np n n p p x x x x x x x x x X 2 1 2222111211 ?? ??? ? ?+++=+++=+++=p mp m m m p p p p x l x l x l z x l x l x l z x l x l x l z 22112222121212121111............ 利用主成分分析对江苏省沿江地区物流产业发展的综合评价 【摘要】现代物流的发展程度已经逐渐成为衡量一个区域或国家现代化程度和综合竞争力的重要标志之一。物流产业的实质体现为技术密集和劳动密集相结合,是具有第三产业特征的跨地区、跨行业、跨部门特点的产业形式。物流产业对经济增长,特别是区域经济增长和区域产业协作的推动,都有着不可替代的重大意义,在区域经济、产业布局研究过程中,都不能忽视物流产业在其中的基础保障作用。本文在构建江苏省沿江地区物流产业发展综合指标体系的基础上,运用多元统计分析中的主成分分析方法,对江苏省沿江地区20个地市的物流发展现状进行了综合评价,为江苏省各地市物流产业主管部门制定相应政策提供一定的理论依据,旨在提高江苏省沿江地区整体物流发展水平。 【关键词】主成分分析物流产业综合评价 一.研究背景 经济的快速增长对物流业产生了巨大的需求,促使物流业以及与物流相关的交通运输、仓储配送和邮电通信业等都有较快的发展。同时,作为经济增长的“加速器”物流业的快速发展将会改变国民经济增长方式,降低国民经济的运行成本,促进了经济的可持续发展。物流对于经济增长的影响以及物流业与经济增长之间的关系已经成为物流领域的一个研究重点。本文拟从主成分分析的角度出发,以江苏省数据为例来探讨哪些因素是物流发展的主要因素,对江苏省物流产业发展现状进行综合评价,从而为江苏省乃至全国的物流产业的发展提供一定的启示。 二.主成分分析方法介绍 主成分分析是把原来多个变量化为少数几个综合指标的一种统计分析方法,从数学角度来看,这是一种降维处理技术。假定有n个地理样本,每个样本共有p个变量描述,这样就构成了一个n×p阶的数据矩阵: 如何从这么多变量的数据中抓住主要的变量指标呢?要解决这一问题,自然要在p维空间中加以考察,这是比较麻烦的。为了克服这一困难,就需要进行降维处理,即用较少的几个综合指标来代替原来较多的变量指标,而且使这些较少的综合指标既能尽量多地反映原来较多指标所反映的信息,同时它们之间又是彼此独立的。那么,这些综合指标(即新变量)应如何选取呢?显然,其最简单的形式就是取原来变量指标的线性组合,适当调整组合系数,使新的变量指标之间相互独立且代表性最好。 如果记原来的变量指标为x1,x2,…,xp,它们的综合指标——新变量指标为x1,x2,…,zm(m≤p)。则 在(2)式中,系数lij由下列原则来决定: (1)zi与zj(i≠j;i,j=1,2,…,m)相互无关; R 语言主成分分析的案例 x2:Br?103/Cl; x3:K?103/Σ 盐; x4:K?103/Cl; x5:Na/K; x6:Mg?102/Cl; x7:εNa/εCl. 1 标准误、方差贡献率和累积贡献率 主成分分析の操作过程 原始数据如下(部分) 调用因子分析模块(Analyze―Dimension Reduction―Factor),将需要参与分析の各个原始变量放入变量框,如下图所示: 单击Descriptives按钮,打开Descriptives次对话框,勾选KMO and Bartlett’s test of sphericity选项(Initial solution选项为系统默认勾选の,保持默认即可),如下图所示,然後点击Continue按钮,回到主对话框: 其他の次对话框都保持不变(此时在Extract次对话框中,SPSS已经默认将提取公因子の方法设置为主成分分析法),在主对话框中点OK按钮,执行因子分析,得到の主要结果如下面几张表。 ①KMO和Bartlett球形检验结果: KMO为0.635>0.6,说明数据适合做因子分析;Bartlett球形检验の显着性P值为0.000<0.05,亦说明数据适合做因子分析。 ②公因子方差表,其展示了变量の共同度,Extraction下面各个共同度の值都大於0.5,说明提取の主成分对於原始变量の解释程度比较高。本表在主成分分析中用处不大,此处列出来仅供参考。 ③总方差分解表如下表。由下表可以看出,提取了特征值大於1の两个主成分,两个主成分の方差贡献率分别是55.449%和29.771%,累积方差贡献率是85.220%;两个特征值分别是3.327和1.786。 ④因子截荷矩阵如下: 根据数理统计の相关知识,主成分分析の变换矩阵亦即主成分载荷矩阵U与因子载荷矩阵A以及特征值λの数学关系如下面这个公式: 故可以由这二者通过计算变量来求得主成分载荷矩阵U。 新建一个SPSS数据文件,将因子载荷矩阵中の各个载荷值复制进去,如下图所示: 计算变量(Transform-Compute Variables)の公式分别如下二张图所示: 计算变量得到の两个特征向量U1和U2如下图所示(U1和U2合起来就是主成分载荷矩阵): 所以可以得到两个主成分Y1和Y2の表达式如下: 实用标准文档 实验目的:原始数据中每一所高校具有20个相关性很高的变量,利用主成分分析法用较少的变量去解释原来资料中的大部分变异,将手中的众多变量转化成彼此相互独立或不相关的个数较少的变量,即所谓主成分,并用以解释资料的综合性指标,其实质的目的是降维 原始数据截屏: 操作方法: 1.描述性统计 SPS浙调用因子分析过程进行分析时,SPS泊自动对原始数据进行标准化处理, 所以在得到计算结果后指的变量都是指经过标准化处理后的变量,但SPSS¥会直接给出标准化后的数据,然后后期的计算需得到标准化数据,则需调用“描述” 过程进行计算,为了看到标准化数据,所以采用描述性统计下的描述操作获得标准化后的变量数据标准化数据: 文案大全 F|Em畦拇主引M±貌被丁救师中悝十 学待比出漏仔=与姑既K 7-巾式= 科研卷■暑 [生均同京 1^6979937S1? 4T121* 75377-1 979Q0-1 (JB6D9』asciDj-1 391 Bl母W84.B39EI3 2-G9799-91 M2 -1 5U?3D-75372970W-W02-1 060 Dd.1 230313083? 7BCHB 3-69799-SOTM -1 11367-69TT21317196933-7?D5戒主1辖■2S879-&D3B A-.69/991_2?042 -.38931-F5372-2.15TO1-US-1H1.S09B??1/12319>.58750 1.167T9 S-J6?/99-1.1208a -冷/m-.67&J2 -./Z330-1_2倾斗-1-23330.41? 07-1.16156.弓询」-.35303 -翘为9-J20H -邳15-.7201;-72J30-段皿-1.040072J屹尚tai574??9地183 7-^799-如了N TW427537? -72330」024?3-.118D9的迁-6970604683 H?979?醐鸵d J32D1C97+5 ^.723302CG0S? 1.662BB T.6T46Q 1 08^8153271成9 9.韵7 99 -.?6813 -T.06?D4.76372 723X 1 07262.69*24.30648-1.6MS41卫蜘24M2 10.65759-.76^87 .05220-.72012 "72330-14803"744.195B9■ .SW53■ 1.31233 11-6S799-.50022 -1.C204C-.72330-.?550-契H-.11005-1*319 1.05^2-539S3 12-02523 59C20-苍g "131761489473d B6?C46-1 19013-19537 r is68?4140664 2232Q-69772258?&-917J6359-777F1 1 84预? ?494? 14就41,1 睫354 W50T761?9fii* 1 392M3&q罪?73&*g4-5446T 因子分析操作过程: 选取变量: X1:科研经费得分 X2:国家人文社科重点研究基地得分 X3:院士总数得分 X4:生均图书得分 X5:研究中心数得分 X6:国家重点实验室得分 X7:生均教学科研仪器设备得分 X8 :生均教育事业经费得分 X9:精品课程得分 X10:优秀博士生论文总分 X11:人才得分 X12:二级学科建设得分 X13 :生均固定资产得分 X14:科研论文得分 X15:博导及相关合计得分 X16:教师中博士学位比重得分 X17: 一级学科得分 X18 :高级职称比重得分 X19:帅资总分 X20:SCI 数量主成分分析(论文)

SPSS进行主成分分析的步骤(图文)精编版

主成分分析法精华讲义及实例

主成分分析法matlab实现,实例演示

主成分分析法的原理应用及计算步骤..

SPSS因子分析和主成分分析论文

主成分分析PCA(含有详细推导过程以及案例分析matlab版)

主成分分析计算方法和步骤

主成分分析的计算步骤

股票投资选择中的主成分分析毕业论文

SPSS软件进行主成分分析的应用例子

主成分分析法实例

主成分分析法及其在SPSS中的操作

主成分分析论文

R语言主成分分析的案例

R 语言也介绍到案例篇了,也有不少同学反馈说还是不是特别明白一些基础的东西,希望能 够有一些比较浅显的可以操作的入门。其实这些之前 SPSS 实战案例都不少,老实说一旦用 上了开源工具就好像上瘾了,对于以前的 SAS、clementine 之类的可视化工具没有一点 感觉了。本质上还是觉得要装这个、装那个的比较麻烦,现在用 R 或者 python 直接简单 安装下,导入自己需要用到的包,活学活用一些命令函数就可以了。以后平台上集成 R、 python 的开发是趋势,包括现在 BAT 公司内部已经实现了。 今天就贴个盐泉水化学分析资料的主成分分析和因子分析通过 R 语言数据挖掘的小李 子: 有条件的同学最好自己安装下 R,操作一遍。 今有 20 个盐泉,盐泉的水化学特征系数值见下表.试对盐泉的水化学分析资料作主成分分 析和因子分析.(数据可以自己模拟一份)

其中 x1:矿化度(g/L);

1.数据准备

导入数据保存在对象 saltwell 中 >saltwell<-read.table("c:/saltwell.txt",header=T) >saltwell

2.数据分析

>arrests.pr<- prcomp(saltwell, scale = TRUE) >summary(arrests.pr,loadings=TRUE)

2 每个变量的标准误和变换矩阵

>prcomp(saltwell, scale = TRUE)

3 查看对象 arests.pr 中的内容

>> str(arrests.pr)spss进行主成分分析的步骤图文)

spss主成分分析报告