【摘要】H.264是由ITU—T视频编码专家组和IS0运动图像专家组

成立的联合视频专家组制定的最新视频编码标准。H.264标准的主要目标是增强压缩性能,并提供“网络友好”的视频表达。本文主要介绍了基于H.264的视频压缩编码的基本原理和实现过程中所用到的算法及关键技术,最后对该视频编码标准的应用前景和发展方向作了简要叙述。

【关键词】H.264 视频压缩编码基本原理前景和方向

1H.264概述

H.264是新一代运动图像压缩标准,它是由ITU-T视频编码专家组(VCEC)和ISO运动图像专家组(MPEG)成立的联合视频专家组(JVT)制定的最新视频编码标准。H.264采用了多种先进技术,具有很好的压缩性能,能够适应捷大部分视频编码的需要。H.264能使图像的数据量减少50%,对网络传输具有更好的支持,引入面向数据包编码,有利于将数据打包在网络中传输,支持流媒体服务应用;具有较强的抗误码特性,以适应在噪声干扰大、丢包率高的无线信道中传输;对不同应用的时延要求具有灵活的适应性;编码和解码复杂度具有可扩展性,支持编码和解码复杂度的不等分配和扩展

H.264标准的主要特征包括编码效率(提供了明显优于以前任何标准的压缩性能)、传输性能(包含一系列内在属性,支持在信道和网络上的可靠与鲁棒的传输)和集中于视频压缩的集中广泛的应用。目前H.264只支持3种档次,每一个档次旨在支持一类比较广泛的视频通信应用。H.264的基本档次特别适合于对话式的应用,例如视频会议,扩展档次增加了额外的工具,适合于视频流在网络上的传输场合,而主要档次所包含的工具集特别适合于客户应用,例如视频广播和存储。

2 H.264编码器的基本原理

2.1 H.264的结构

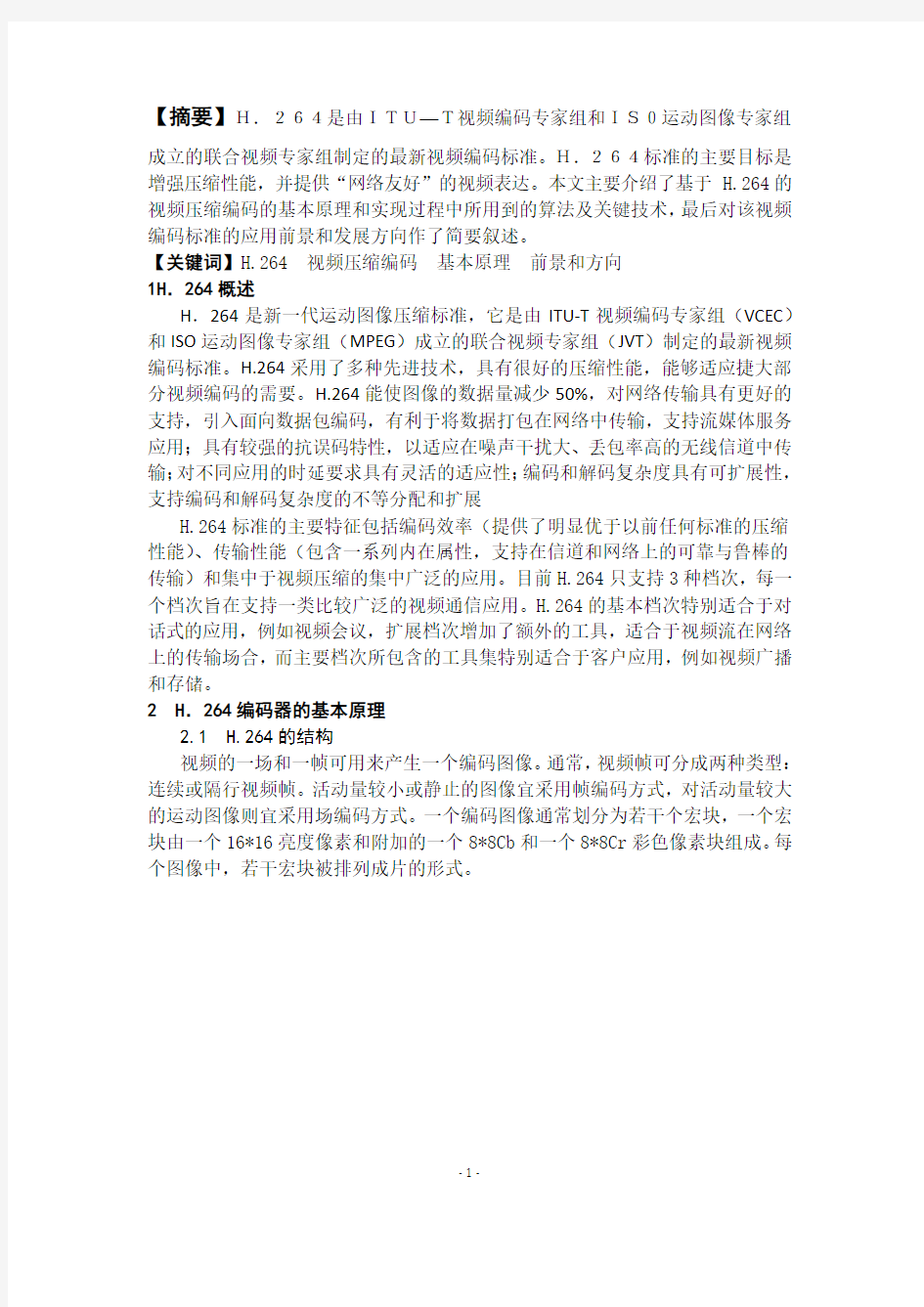

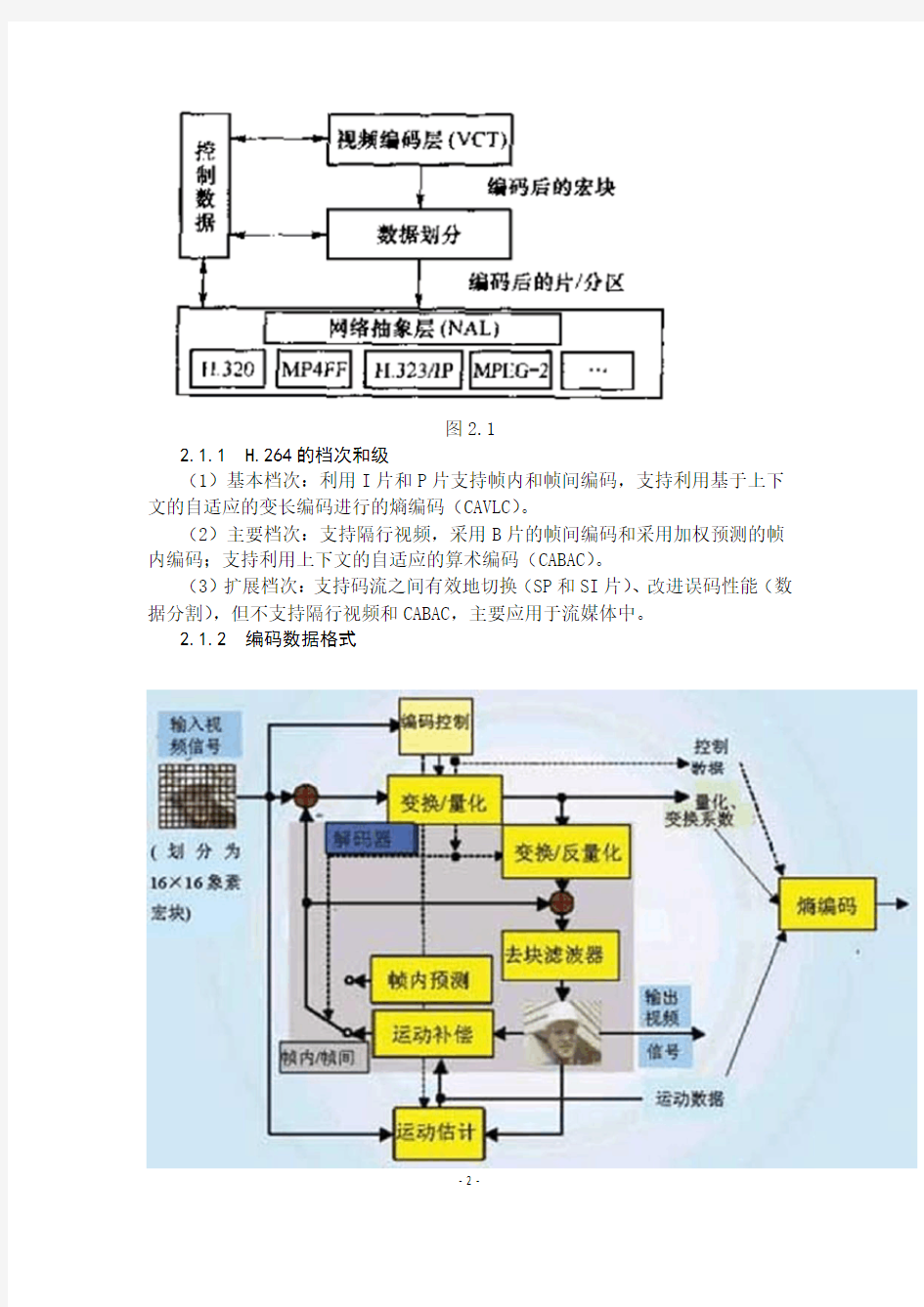

视频的一场和一帧可用来产生一个编码图像。通常,视频帧可分成两种类型:连续或隔行视频帧。活动量较小或静止的图像宜采用帧编码方式,对活动量较大的运动图像则宜采用场编码方式。一个编码图像通常划分为若干个宏块,一个宏块由一个16*16亮度像素和附加的一个8*8Cb和一个8*8Cr彩色像素块组成。每个图像中,若干宏块被排列成片的形式。

图2.1

2.1.1 H.264的档次和级

(1)基本档次:利用I片和P片支持帧内和帧间编码,支持利用基于上下文的自适应的变长编码进行的熵编码(CAVLC)。

(2)主要档次:支持隔行视频,采用B片的帧间编码和采用加权预测的帧内编码;支持利用上下文的自适应的算术编码(CABAC)。

(3)扩展档次:支持码流之间有效地切换(SP和SI片)、改进误码性能(数据分割),但不支持隔行视频和CABAC,主要应用于流媒体中。

2.1.2 编码数据格式

图2.2 编码框架

2.1.2.1 H.264的视频格式

H.264支持4:2:0的连续或隔行视频的编码和解码。

2.1.2.2 H.264的编码格式

制定H.264的主要目标有两个:

(1)得到高的视频压缩比。当初提出的指标是与H.263、MPEG-4相比,约为它们的2倍。现在都已基本实现。

(2)具有良好的网路亲和性,即可适用于各种传输网络。

为此,H.264的功能分为两层,即视频编码层(VCL)和网络提取层(NAL)和VCL数据即编码处理后的输出,它表示被压缩编码后的视频数据序列。在VCL数据传输或存储之前,这些编码的VCL数据,先被映射或封装在NAL单元中。

每个NAL单元包括一个原始字节序列负荷(RBSP)、一组对应于视频编码数据的NAL头信息。

2.1.3 片和片组

2.1.

3.1 片

一个视频图像可以编码成一个或更多个片,每片包含整数个宏块(MB),即每片至少一个MB,最多时每片包含整个图像的宏块。总之,一幅图像中每片的宏块数不一定固定。

图2.3 片的句法结构

设片的目的是为了限制误码的扩散和传输,应使编码片相互间保持独立。某片的预测不能以其他片中的宏块为参考图像,这样某一片中的预测误差才不会传播到其他片中去。

2.1.

3.2 片组

片组是一个编码图像中若干个MB的一个子集,它可包含一个或若干个片。在一个片组中,每片的MB按光栅扫描次序进行编码,如果每幅图像仅取一个片组,则该图像中所有的MB均按光栅扫描次序编码。

图2.4 片组

2.2 帧内预测

在帧内预测模式中,预测块P是基于已编码重建块和当前块形成的。对亮度像素而言,P块用于4×4子块或者16×16宏块的相关操作。编码器通常选择使P块和编码块之间差异最小的预测模式。

2.2.1 4×4亮度预测模式

如上图所示,4*4亮度块的上方和左方像素A-Q为已编码并重构的像素,用作编解码器中的预测参考像素。a-p为待预测像素,利用A-Q值和9种模式实现。其中模式2(DC预测)根据A-Q中已编码像素进行预测,而其余模式只有在所需

预测像素全部提供后才能使用。下表中给出了9种模式的描述。

4*4预测模式描述

2.2.2 16*16亮度预测模式

16*16预测模式描述

其中模式3与原始宏块最匹配。帧内16*16模式适用于对图像平坦区域进行预测。

2.2.3 8*8色度块预测模式

每个帧内编码宏块的8*8色度成分由已编码左上方色度像素的预测而得,两种色度成分常用同一种预测模式。4种预测模式类似于帧内16*16预测的4种预测模式,只是模式编号不同,其中DC为模式0、水平为模式1、垂直为模式2、平面为模式3。

2.2.4 帧内预测模式信号化

每个4*4块帧内预测模式必须转变成信号传送给解码器。该信息可能需大量的比特表示,但邻近块的帧内模式通常是相关的。例如,A、B、E分别为左边、上边、和当前块,如果A和B预测模式为模式1,E的最佳预测模式很可能也为模式1.所以通常利用这种关联性信号化4*4帧内模式。

对每个当前块E,编码器和解码器计算最可能的预测模式和A、B预测模式的较小者,如果这些相邻块不被提供(当前片外或者非帧内4*4模式),相应值A 或B置2(DC预测模式)。

编码器分配每个4*4块一个标志prev_intra4*4_pred_mode。该标志置1时,使用最可能预测模式;置0时,使用参数rem_intra4*4_pred_mode来指明模式的变化。rem_intra4*4_pred_mode小于当前最可能的模式时,预测模式选

rem_intra4*4_pred_mode;否则预测模式为rem_intra4*4_pred_mode+1.

rem_intra4*4_pred_mode的值为0-7.

举例:块A和B分别用模式3和模式1预测,块E最可能的预测模式则为1.这时prev_intra4*4_pred_mode置0,rem_intra4*4_pred_mode被传送,见下表,块E的预测模式选择取决于rem_intra4*4_pred_mode的值。

预测模式选择(最可能模式为1)

这里需说明的是,包括帧内预测的所有预测都不能跨片边界预测,每片必须独立进行编解码。

可见,帧内预测以绝对误差和(SAE)为标准选取最佳预测模式,使预测帧更加接近于原始帧,减少了相互间的差异,去除时间上的数据冗余,提高了编码的压缩效率。帧内预测中,块或宏块利用已编码并重建的块作为参考,进行预测。具体编程时,编码器通过计算并比较各种模式下的SAE,选取SAE值最小的模式作为最佳预测模式,并将该模式信息化,同时传送至解码端,以供正确解码。

2.3 帧间预测

H.264帧间预测是利用已编码视频帧/场和基于块的运动补偿的预测模式。与以往标准帧间预测的区别在于块尺寸范围更广(从16*16到4*4)、亚像素运动矢量的使用(亮度采用1/4像素精度MV)及多参考帧的运用等等。

2.3.1 树状结构运动补偿

每个宏块(16*16像素)可以按4种方式进行分割:1个16*16,或2个16*8,或2个8*16,或4个8*8.其运动补偿也相应有4种。而8*8模式的每个子宏块还可以进一步以4种方式进行分割:1个8*8,2个4*8或2个8*4及4个4*4.这些分割和子宏块大大提高了各宏块之间的关联性。这种分割下的运动补偿则称为树状结构运动补偿。

16*16 16*8 8*16 8*8

M

Type

8*8 8*4 4*8 4*4

8*8

Type

宏块及子宏块分割

每个分割或子宏块都有一个独立的运动补偿。每个MV必须被编码、传输,分割的选择也需编码压缩到比特流中。对大的分割尺寸而言,MV选择和分割类型只需少量的比特,但运动补偿残差在多细节区域中的能量将非常高。小尺寸分割运动残差能量低,但需要较多的比特特征MV和分割选择,分割尺寸的选择影响了压缩性能。整体而言,大的分割尺寸适合于平坦区域,而小尺寸适合于多细节区域。

2.3.2 运动矢量

帧间编码宏块的每个分割或者子宏块都是对参考图像的某一相同尺寸区域进行预测而得到的。两者之间的差异对亮度成分采用1/4像素精度,色度1/8像素精度。亚像素位置的亮度和色度像素并不存在于参考图像中,需利用邻近已编码点进行内插而得。

帧间预测——1/4像素运动矢量

2.4 整数变换与量化

为了进一步节省图像传输码率,需要对图像信号进行压缩,一般方法为去除图像信号中的相关性及减小图像编码的动态范围,通常采用变换编码及量化技术。变换编码将图像时域信号变换为频域信号。在频域中,图像信号的能量大部分集中在低频区域,相对于视频信号,码率有较大的下降。H.264对图像或预测残差

采用了4*4整数离散余弦变换技术,避免了以往标准中使用的通用8*8离散余弦变换、逆变换经常出现的失配问题。量化过程根据图像动态范围的大小来确定量化参数,既保留了图像中必要的细节,又可减少码流。

3 应用前景和发展方向

3.1 应用

下表列出了一些视频编码技术的应用,包括了各种应用的重要参数及所推荐的H.264的档次。

应用需求

3.2 平台

对实现视频编解码器的平台选择需要综合很多因素,其中包括应用的种类、对开发的支持、功耗限制、未来产品升级、开发平台是否可获得和商用编码器的成本等。下表列出了关于流行的实验平台的比较,并得出了关于他们的优缺点的一般性结论。

平台的比较

3.3 未来的方向

要猜测多媒体应用的商业和技术前景是很困难的。例如视频会议还没有像预想的一样被广泛的采用;MPEG-4视频标准五年前之前就提出的很多创造性的工具,但并没有引起任何商业上的重视。然后,关于本文所介绍的这项技术的短期、中期、长期发展的预测仍将列在此处。

短期内,很多针对H.264数据的存储和传输的标准化工作正在进行中。希望H.264标准在发布后短期内能在专利授权费用上达成共识,但愿对基本档次不收授权费用的承诺能被确认。

在中期,可以看到H.264新的档次推出,以支持更多的应用和更好地性能。随着视频移动设备的普及,由于H.264技术在其低比特率下有更好地效果,可能会更流行。当用户开始习惯这种移动视频技术,并使这项技术融入他们的生活中,广泛流行的视频设备,可能会导致一些革命性的应用和设备的产生。

从长期来看,随着处理器性能的提高和一些不实际的算法变得能运用在商业应用中,终究会有新的视频编码标准产生,视频编码技术的研究仍然非常活跃。很多有前途的方案将取代长期以来的DPCM/DCT编码模式。

4 结论

数以百计的研究者和开发者经过多年的努力,终于完成了H.264第十部分标准。每种标准都在某种程度上具有影响深远的成功,虽然,其中某些特征和工具

看起来有些超前,但H.264注重解决当前和即将产生的多媒体应用的问题和需要。虽然目前H.264将作为推动下一代数字视频应用的技术领先者,但对于“哪一种标准最适合我的应用?”这个问题仍没有明确的答案。

【参考文献】

1.刘峰.视频图像编码技术及国际标准.北京:北京邮电大学出版社,2005

2.黎洪松.数字视频处理.北京:北京邮电大学出版社.2006

3.毕厚杰.新一代视频压缩编码标准——H.264/AVC.北京:人民邮电出版社,

2005

4.欧阳合,韩军.H.264和MPEG-4视频压缩(新一代多媒体的视频编码技术).

湖南长沙:国防科技大学出版社,2004

5.毕厚杰.H.264/AVC视频编码标准的技术特点和评价.世界电信,2004

6.沈兰荪,田冻.无线视频传输技术的发展.电子技术应用,2001

7.吴伟陵.移动通信中的关键技术.北京:北京邮电大学出版社,2000

8.冯秀波,谢剑英.无线视频传输容错算法研究新进展.通信学报,2003

1. 为什么要进行视频压缩 未经压缩的数字视频的数据量巨大 存储困难 一张DVD只能存储几秒钟的未压缩数字视频。 传输困难 1兆的带宽传输一秒的数字电视视频需要大约4分钟。 2. 为什么可以压缩 ? 去除冗余信息 ? 空间冗余:图像相邻像素之间有较强的相关性 时间冗余:视频序列的相邻图像之间内容相似 编码冗余:不同像素值出现的概率不同 视觉冗余:人的视觉系统对某些细节不敏感 知识冗余:规律性的结构可由先验知识和背景知识得到3. 数据压缩分类 ? 无损压缩(Lossless) ? 压缩前解压缩后图像完全一致X=X' 压缩比低(2:1~3:1) 例如:Winzip,JPEG-LS ?

有损压缩(Lossy) ? 压缩前解压缩后图像不一致X≠X' 压缩比高(10:1~20:1) 利用人的视觉系统的特性 例如:MPEG-2,AVC,AVS 4. 编解码器 ? 编码器(Encoder) ? 压缩信号的设备或程序 ? 解码器(Decoder) ? 解压缩信号的设备或程序 ? 编解码器(Codec) ? 编解码器对 5. 压缩系统的组成 (1) 编码器中的关键技术 (2) 编解码中的关键技术 6. 编解码器实现 ?

编解码器的实现平台: ? ? 超大规模集成电路VLSI ? ASIC, FPGA 数字信号处理器DSP 软件 ? 编解码器产品: ? 机顶盒 数字电视 摄像机 监控器 7. 视频编码标准 编码标准作用: ? 兼容: ? 不同厂家生产的编码器压缩的码流能够被不同厂家的解码器解码? 高效: ? 标准编解码器可以进行批量生产,节约成本。 主流的视频编码标准: MPEG-2 MPEG-4 Simple Profile AVC

2005年第9期信息技术 中图分类号:T N919.31 文献标识码:B 文章编号:1009-2552(2005)09-0047-02 MPEG4视频压缩编码技术及应用 赵 巍,艾斯卡尔 (新疆大学电子系,乌鲁木齐830046) 摘 要:MPEG4是国际标准组织制定的多媒体通信的标准,文中概述了MPEG4的背景,MPEG4与MPEG1,MPEG2的主要区别以及MPEG4的主要技术。最后,展望了MPEG4的应用前景。 关键词:MPEG4;视频对象平面 MPEG4video compression coding technology and its application ZHAO Wei,Askar (Dep artment of E lectron.Xinjiang U niversity,U rumqi830046,China) Abstract:The MPEG4standard is w orked out for multimedia communications by IS O.This paper deseribes the background of MPEG4’s appearance,the basic structure of MPEG4,the main differences between MPEG4 and MPEG1Π2,the key technology of MPEG4.Finally,it forecasts the foreground of its application. K ey w ords:MPEG4;VOP 0 前言 解决视频、音频数字化后数据量大与数字存储媒体和通信网容量小的矛盾的主要途径之一就是压缩。为此,国际标准化组织先后于1993年和1995年制定了视频、音频编码的国际标准MPEG1和MPEG2。MPEG1,MPEG2技术当初制定时,它们定位的标准均为高层媒体表示与结构,但随着计算机软件及网络技术的快速发展,MPEG1,MPEG2技术的弊端就显示出来了:交互性及灵活性较低,压缩的多媒体文件体积过于庞大,难以实现网络的实时传播。因此,制定出了新的多媒体通信标准MPEG4。 1 MPEG4与MPEG1,MPEG2的比较MPEG1,MPEG2都是采用第一代压缩编码技术,着眼于图像信号的统计特性来设计编码器,属于波形编码的范畴。第一代压缩编码方案把视频序列按时间先后分为一系列帧,每一帧图像又分成宏块以进行运动补偿和编码。这种编码存在以下缺陷: (1)将图像固定地分成相同大小的块,在高压缩比的情况下会出现严重的块效应,即马赛克效应; (2)不能对图像内容进行访问、编辑和回放等操作; (3)不能充分利用人类视觉系统(H VS,Huaman Visual System)的特性。 MPEG4代表了基于模型Π对象的第二代压缩编码技术,它充分利用了人眼视觉特性,抓住了图像信息传输的本质,从轮廓、纹理思路出发,支持基于视觉内容的交互功能,这适应了多媒体信息的应用由播放型转向基于内容的访问、检索及操作的发展趋势。 MPEG4为支持基于内容编码而提出了AV (AVO,Audio Visual Object)对象的概念,在MPEG4中所见的视音频已不再是过去MPEG1,MPEG2中图像帧的概念,而是一个个视听场景(AV场景)。不同的AV场景由不同的AV对象组成,AV对象是听觉,视觉或视听内容的表示单元,其基本单位是原始AV 对象,它可以是自然的或合成的声音,图像。原始AV对象具有高效编码,高效存储与传输以及可交互操作的特性,它又可进一步组成复合AV对象。 因此,MPEG4标准的基本内容就是对AV对象进行高效编织,组织,存储与传输。MPEG4B不仅可提供高压缩率,同时也可实现更好的多媒体内容互动性及全方位的寸取性,它采用开放的编码系统,可随时加入新的编码算法模块,同时也可根据不同应用需求现场配置解码器,以支持多种多媒体应用。 收稿日期:2005-03-02 作者简介:赵巍,男,硕士生,研究方向为数字图像处理。 — 7 4 —

第1章介绍 1. 为什么要进行视频压缩? ?未经压缩的数字视频的数据量巨大 ? 存储困难 ? ?一DVD只能存储几秒钟的未压缩数字视频。 ? 传输困难 ? ?1兆的带宽传输一秒的数字电视视频需要大约4分钟。 2. 为什么可以压缩 ? 去除冗余信息

? ?空间冗余:图像相邻像素之间有较强的相关性 ?时间冗余:视频序列的相邻图像之间容相似 ?编码冗余:不同像素值出现的概率不同 ?视觉冗余:人的视觉系统对某些细节不敏感 ?知识冗余:规律性的结构可由先验知识和背景知识得到3. 数据压缩分类 ? 无损压缩(Lossless) ? ?压缩前解压缩后图像完全一致X=X' ?压缩比低(2:1~3:1) ?例如:Winzip,JPEG-LS ? 有损压缩(Lossy) ? ?压缩前解压缩后图像不一致X≠X' ?压缩比高(10:1~20:1) ?利用人的视觉系统的特性 ?例如:MPEG-2,H.264/AVC,AVS

4. 编解码器 ? 编码器(Encoder) ? ?压缩信号的设备或程序 ? 解码器(Decoder) ? ?解压缩信号的设备或程序 ? 编解码器(Codec) ? ?编解码器对 5. 压缩系统的组成

(1) 编码器中的关键技术 (2) 编解码中的关键技术 6. 编解码器实现 ? 编解码器的实现平台: ? ?

超大规模集成电路VLSI ? ?ASIC,FPGA ?数字信号处理器DSP ?软件 ? 编解码器产品: ? ?机顶盒 ?数字电视 ?摄像机 ?监控器 7. 视频编码标准 编码标准作用: ? 兼容: ? ?不同厂家生产的编码器压缩的码流能够被不同厂家的解码器解码 ? 高效: ?

1、为什么要对图像数据进行压缩?其压缩原理是什么? 答:(1)数字图像如果不进行压缩,数据量是比较大的,例如一幅分辨率为1024×768的静态真彩色图像,其数据量为1024×768×24=2.25(MB)。这无疑对图像的存储、处理、传送带来很大的困难。事实上,在图像像素之间,无论在行方向还是列方向,都存在一定的相关性。也就是说,在一般图像中都存在很大的相关性,即冗余度。静态图像数据的冗余包括:空间冗余、时间冗余、结构冗余、知识冗余和视觉冗余、图像区域的相同性冗余、纹理的统计冗余等。图像压缩编码技术就是利用图像数据固有的冗余性和相干性,将一个大的图像数据文件转换为较小的同性质的文件。 (2)其压缩原理: 空间冗余、时间冗余、结构冗余、和视觉冗余。 2、图像压缩编码的目的是什么?目前有哪些编码方法? 答:(1)视频经过数字化处理后易于加密、抗干扰能力强、可再生中继等诸多优点,但是由于数字化的视频数据量十分巨大,不利于传输和存储。若不经压缩,数字视频传输所需的高传输率和数字视频存储所需的巨大容量,将成为推广数字电视视频通信的最大障碍,这就是进行视频压缩编码的目的。 (2)目前主要是预测编码,变换编码,和统计编码三种编码方法。 3、某信号源共有7个符号,概率分别为0.2,0.18,0.1,0.15,0.07,0.05,0.25,试进行霍夫曼编码,并解释是否进

行了压缩,压缩比为多少? 0000 0001 000 00 111 110 10 0.05 0.07 0.1 0.2 0.18 0.15 0.25 0.05×4+0.07×4+0.1×3+0.2×2+0.18×3+0.15×3+0.25×2=2.67

多媒体音视频编解码浅析 为便于大家了解查阅,特对多媒体编解码及相关信息大致整理一下。 视频编码的基本原理 视频图像数据有极强的相关性,也就是说有大量的冗余信息。其中冗余信息可分为空域冗余信息和时域冗余信息。压缩技术就是将数据中的冗余信息去掉(去除数据之间的相关性),压缩技术包含帧内图像数据压缩技术、帧间图像数据压缩技术和熵编码压缩技术。 去时域冗余信息 使用帧间编码技术可去除时域冗余信息,它包括以下三部分: -运动补偿 运动补偿是通过先前的局部图像来预测、补偿当前的局部图像,它是减少帧序列冗余信息的有效方法。 -运动表示 不同区域的图像需要使用不同的运动矢量来描述运动信息。运动矢量通过熵编码进行压缩。 -运动估计 运动估计是从视频序列中抽取运动信息的一整套技术。 注:通用的压缩标准都使用基于块的运动估计和运动补偿。 去空域冗余信息 主要使用帧间编码技术和熵编码技术: -变换编码 帧内图像和预测差分信号都有很高的空域冗余信息。变换编码将空域信号变换到另一正交矢量空间,使其相关性下降,数据冗余度减小。 -量化编码 经过变换编码后,产生一批变换系数,对这些系数进行量化,使编码器的输出达到一定的位率。这一过程导致精度的降低。 -熵编码 熵编码是无损编码。它对变换、量化后得到的系数和运动信息,进行进一步的压缩。 标准化机构 在视频编解码技术定义方面有两大标准机构。国际电信联盟 (ITU) 致力于电

信应用,已经开发了用于低比特率视频电话的 H.26x 标准,其中包括 H.261、H. 262、H.263 与 H.264;国际标准化组织 (ISO) 主要针对消费类应用,已经针对运动图像压缩定义了 MPEG 标准。MPEG 标准包括 MPEG1、MPEG2 与 MPEG4。图1 说明了视频编解码标准的发展历程。 MPEG 与 ISO 根据基本目标应用往往做出稍有不同的取舍。有时它们也会开展合作,如:联合视频小组 (JVT),该小组定义了 H.264 编解码技术,这种技术在 MPEG 系列中又被称为 MPEG4-Part 10 或 MPEG4 高级视频编解码 (AVC)。我们在本文中将这种联合标准称为 H.264/AVC。同样,H.262 对应 MPEG2,而H.263 基本规范类 (Baseline Profile) 技术在原理方面与 MPEG4 简单类 (Si mple Profile) 编解码技术存在较多重复。 标准对编解码技术的普及至关重要。出于规模经济原因,用户根据可承受的标准寻找相应产品。由于能够保障厂商之间的互操作性,业界乐意在标准方面进行投资。而由于自己的内容可以获得较长的生命周期及广泛的需求,内容提供商也对标准青睐有加。尽管几乎所有视频标准都是针对少数特定应用的,但是在能够适用的情况下,它们在其他应用中也能发挥优势。 为了实现更好的压缩及获得新的市场机遇,ITU 与 MPEG 一直在不断发展压缩技术和开发新标准。中国最近开发了一种称为 AVS 的国家视频编码标准,我们在后面也会做一介绍。目前正在开发的标准包括 ITU/MPEG 联合可扩展视频编码 (Joint Scalable Video Coding)(对 H264/ AVC 的修订)和MPEG 多视角视频编码 (Multi-view Video Coding)。另外,为了满足新的应用需求,现有标准也在不断发展。例如,H.264 最近定义了一种称为高精度拓展 (Fidelity Ra nge Extensions) 的新模式,以满足新的市场需求,如专业数字编辑、HD-DVD 与无损编码等。 除了 ITU 与 ISO 开发的行业标准以外,还出现了几种专用于因特网流媒体应用、广受欢迎的专有解决方案,其中包括 Real Networks Real Video (RV10)、

视频压缩编码及常用格式 数据压缩编码已经拥有很长的历史,压缩编码的理论基础是信息论。从信息的角度看,压缩就是去除数据中的消除冗余。即保留不确定的信息,去除确定的信息,用一种更接近信息本质的描述来代替原有冗余的描述压缩的目的是在尽可能保证视觉效果的前题下减少数据率。视频压缩比是指压缩后的数据量与压缩前的数据量之比。由于视频是连续的静态图像,因此其压缩编码算法与静态图像的压缩算法有某些共同的地方,但是运动的视频还有其本身的特性,因此在压缩是还要考虑其运动特性,这样才能达到高效果压缩的目的。 自从上世纪四十年代第一台电视机问世以来,视频技术的研究与应用已经有近六十年的历史。当前电视技术均为模拟视频技术,经过几十年的发展和完善,已经十分成熟。世界通行的模拟电视制式主要有:PAL(欧洲、中国)NTSC(北美、日本)和SECAM(法国)。 随着计算机技术近二十年的发展,特别是九十年代以来互联网的广泛应用,多媒体数字视频技术已经成为了当前信息科学中十分活跃的研究方向。数字化技术的引用。使得对视频信号的捕获、处理、压缩和储存都有了革命性的进步特别是在视频数据的压缩和储存上。国际电信联合会(ITC)于1990年正式提出了ITU-TH261建议,这是第一个关于使用化视频图像压缩编码的国际标准提议。九十年代中,IUT在该建议上提出了MPEG1、MPEG2、MPEG4、H.263和JPEG2000等压缩标准。这些标准的制定和颁布,极大的促进了数字视频压缩与编码技术的研究和实用化。 视频编码标准的发展 视频编码技术在近年得到了迅速的发展和广泛的应用,并在日渐成熟,起标准是多个视频编码国际化标准的制定与应用,即国际标准化组织ISO和国际电工委员会IEC关于静态图像的编码标准JPEG、国际电信联盟ITU-T关于电视、电话会议的视频编码标准H261、H.263及H.264和ISO/TEC关于活动图像的编码标准MPEG-1,MPEG-2、MPEG-4等。这些标准图像编码算法融合了各种性能优良的图像编码方法,代表了目前编码的发张水平。 MPEG-1 MPEG-1标准于1993年8月公布,用于传输1.5Mbps数据传输的数据储存媒体运动图像及其伴音的编码。该标准包括五个部分:第一:说明如何根据第二部(视频)以及第三部分(音频)的规定,对音频和视频进行复合编码。第四部分说明检验解码器或编码器的输出比流符合前三部分规定的过程。第五部分是一个用完整的C语言实现的编码和解码器。 MPEG-1取得一连串的成功,如VCD和MP3的大量使用,可携式MPEG-1摄像

ADV611视频编解码芯片的原理与应用 空军工程大学工程学院陕西西安姚嵬 『摘要』ADV611是一种高压缩率的专用视频图像压缩解压芯片,本文介绍了ADV611的工作原理、功能特点等,并给出了基于 ADV611实现视频图像实时编、解码的可选方案,具体描述 了实现高压缩率的方法。 关键词:视频压缩、ADV611芯片、小波变换、视频信号 引言 随着通信和计算机技术的发展,以“信息采集、监控、处理”为核心的视频监控系统越来越广泛的应用于电视会议、可视电话、远程监控、等远程图像传输系统。而视频图像数据量非常巨大,必须经过压缩才能在有限带宽的网络里传输。目前,许多实用的图像编码算法都是基于DCT的,如有关静止图像和视频压缩编码的国际标准JPEG、H.26X、MPEG-X等。但基于DCT的算法有其固有的缺点,即存在明显的方块效应,在压缩比较高时,图像质量会很糟,因此人们一直在努力探寻更有效的编码方法。美国AD公司新推出的基于小波理论实时压缩解压缩芯片ADV611能较好地实行视频信号压缩,用该芯片实现的图像压缩具有压缩可调范围大,压缩质量高等优点。本文将就ADV611的原理和应用等问题进行阐述。 1ADV611芯片介绍 ADV611是一种低功耗的单片实时视频压缩编解码芯片,可用于视频数字信号处理。它具有精确的压缩比特率控制,能实时地对包括

PAL和NTSC在内的视频信号进行压缩和解压缩,ADV611在压缩时,其视频信号的奇偶场是单独进行的,主要应用于闭路电视系统。它的压缩比可以从4:1到7500:1,在不同的应用场合下,可根据不同的图像质量要求选择不同的压缩倍数。 (1)ADV611 的主要性能 ADV611 具有以下一些主要性能: 精确的压缩位率控制,压缩的数据率由输入数据率和选择的压缩率决定。 高清晰度取景框功能:允许一帧中某一矩形区域相对于其他区域(我们称之为背景)有较低的压缩比,或完全不进行压缩。 硬件编码实现小波变换。 支持电影质量数字视频的国际标准CCIR-656,最大可用场图像尺寸为768×288,最大像素率为14.75MHz。 16×32位主机接口,带512个32位FIFO。 (2)ADV611的内部结构 如图1所示,ADV612实际由8个功能块组成,其中3个接口块,5 个处理块。接口块包括数字视频I/O端口、主机I/O端口以及DRAM管理器;处理块包括小波变换核、片内变换缓存、可编程量化器、游程编码和霍夫曼编码。其中,量化所需二进制宽度由计算机或DSP完成,熵编码包括游程编码和霍夫曼编码。主机接口可为 16位或32位,带有512×32Kbit缓存FIFO。各部分功能如下: 小波变换核:是整个芯片的核心部分,主要完成二维小波变换。

视频压缩编码标准H.264详解 ——新疆大学2006级工硕郭新军 JVT(Joint Video Team,视频联合工作组)于2001年12月在泰国Pattaya 成立。它由ITU-T和ISO两个国际标准化组织的有关视频编码的专家联合组成。JVT的工作目标是制定一个新的视频编码标准,以实现视频的高压缩比、高图像质量、良好的网络适应性等目标。目前JVT的工作已被ITU-T接纳,新的视频压缩编码标准称为H.264标准,该标准也被ISO接纳,称为AVC(Advanced Video Coding)标准,是MPEG-4的第10部分。 H.264标准可分为三档: 基本档次(其简单版本,应用面广); 主要档次(采用了多项提高图像质量和增加压缩比的技术措施,可用于SDTV、HDTV和DVD等); 扩展档次(可用于各种网络的视频流传输)。 H.264不仅比H.263和MPEG-4节约了50%的码率,而且对网络传输具有更好的支持功能。它引入了面向IP包的编码机制,有利于网络中的分组传输,支持网络中视频的流媒体传输。H.264具有较强的抗误码特性,可适应丢包率高、干扰严重的无线信道中的视频传输。H.264支持不同网络资源下的分级编码传输,从而获得平稳的图像质量。H.264能适应于不同网络中的视频传输,网络亲和性好。 一、H.264视频压缩系统 H.264标准压缩系统由视频编码层(VCL)和网络提取层(Network Abstraction Layer,NAL)两部分组成。VCL中包括VCL编码器与VCL解码器,主要功能是视频数据压缩编码和解码,它包括运动补偿、变换编码、熵编码等压缩单元。NAL则用于为VCL提供一个与网络无关的统一接口,它负责对视频数据

高清视频的编码格式有五种,即H.264、MPEG-4、MPEG-2、WMA-HD以及VC-1。事实上,现在网络上流传的高清视频主要以两类文件的方式存在:一类是经过MPEG-2标准压缩,以tp和ts为后缀的视频流文件;一类是经过WMV-HD(Windows Media Video High Definition)标准压缩过的wmv文件,还有少数文件后缀为avi或mpg,其性质与wmv是一样的。真正效果好的高清视频更多地以H.264与VC-1这两种主流的编码格式流传。 H.264编码 H.264编码高清视频 H.264是由国际电信联盟(iTU-T)所制定的新一代的视频压缩格式。H.264 最具价值的部分是更高的数据压缩比,在同等的图像质量,H.264的数据压缩比能比当前DVD系统中使用的 MPEG-2高2~3倍,比MPEG-4高1.5~2倍。正因为如此,经过H.264压缩的视频数据,在网络传输过程中所需要的带宽更少,也更加经济。在 MPEG-2需要6Mbps的传输速率匹配时,H.264只需要1Mbps~2Mbps 的传输速率,目前H.264已经获得DVD Forum与Blu-ray Disc Association采纳,成为新一代HD DVD的标准,不过H.264解码算法更复杂,计算要求比WMA-HD 还要高。 从ATI的Radeon X1000系列显卡、NVIDIA的GeForce 6/7系列显卡开始,它们均加入对H.264硬解码的支持。与MPEG-4一样,经过H.264压缩的视频文件一般也是采用avi 作为其后缀名,同样不容易辨认,只能通过解码器来自己识别。 总的来说,常见的几种高清视频编码格式的特点是能够以更低的码率得到更高的画质,相同效果的MPEG2与H.264影片做比较,后者在容量上仅需前者的一半左右。这也就意味着,H.264不仅能够节省HDTV的存储空间,而且还可以在手机等带宽较窄的网络上传输高质量的视频,可以说应用前途一片光明。但另

视频编码的基本原理及基本框架 视频图像数据有极强的相关性,也就是说有大量的冗余信息。其中冗余信息可分为空域冗余信息和时域冗余信息。压缩技术就是将数据中的冗余信息去掉(去除数据之间的相关性),压缩技术包含帧内图像数据压缩技术、帧间图像数据压缩技术和熵编码压缩技术。 去时域冗余信息 使用帧间编码技术可去除时域冗余信息,它包括以下三部分: -运动补偿 运动补偿是通过先前的局部图像来预测、补偿当前的局部图像,它是减少帧序列冗余信息的有效方法。 -运动表示 不同区域的图像需要使用不同的运动矢量来描述运动信息。运动矢量通过熵编码进行压缩。-运动估计 运动估计是从视频序列中抽取运动信息的一整套技术。 注:通用的压缩标准都使用基于块的运动估计和运动补偿 去空域冗余信息 主要使用帧内编码技术和熵编码技术: -变换编码 帧内图像和预测差分信号都有很高的空域冗余信息。变换编码将空域信号变换到另一正交矢量空间,使其相关性下降,数据冗余度减小。 -量化编码 经过变换编码后,产生一批变换系数,对这些系数进行量化,使编码器的输出达到一定的位率。这一过程导致精度的降低。

熵编码是无损编码。它对变换、量化后得到的系数和运动信息,进行进一步的压缩。 视频编码的基本框架 H.261 H.261标准是为ISDN设计,主要针对实时编码和解码设计,压缩和解压缩的信号延时不超过150ms,码率px64kbps(p=1~30)。 H.261标准主要采用运动补偿的帧间预测、DCT变换、自适应量化、熵编码等压缩技术。只有I帧和P帧,没有B帧,运动估计精度只精确到像素级。支持两种图像扫描格式:QCIF 和CIF。 H.263 H.263标准是甚低码率的图像编码国际标准,它一方面以H.261为基础,以混合编码为核心,其基本原理框图和H.261十分相似,原始数据和码流组织也相似;另一方面,H.263也吸收了MPEG等其它一些国际标准中有效、合理的部分,如:半像素精度的运动估计、PB帧预测等,使它性能优于H.261。 H.263使用的位率可小于64Kb/s,且传输比特率可不固定(变码率)。H.263支持多种分辨率:SQCIF(128x96)、QCIF、CIF、4CIF、16CIF。 与H.261和H.263相关的国际标准 与H.261有关的国际标准 H.320:窄带可视电话系统和终端设备; H.221:视听电信业务中64~1 920Kb/s信道的帧结构; H.230:视听系统的帧同步控制和指示信号; H.242:使用直到2Mb/s数字信道的视听终端的系统。 与H.263有关的国际标准 H.324:甚低码率多媒体通信终端设备; H.223:甚低码率多媒体通信复合协议; H.245:多媒体通信控制协议; G.723.1.1:传输速率为5.3Kb/s和6.3Kb/s的语音编码器。 JPEG 国际标准化组织于1986年成立了JPEG(Joint Photographic Expert Group)联合图片专家小组,主要致力于制定连续色调、多级灰度、静态图像的数字图像压缩编码标准。常用的基于离散余弦变换(DCT)的编码方法,是JPEG算法的核心内容。

各种音视频编解码学习详解h264 ,mpeg4 ,aac 等所有音视频格式 编解码学习笔记(一):基本概念 媒体业务是网络的主要业务之间。尤其移动互联网业务的兴起,在运营商和应用开发商中,媒体业务份量极重,其中媒体的编解码服务涉及需求分析、应用开发、释放license收费等等。最近因为项目的关系,需要理清媒体的codec,比较搞的是,在豆丁网上看运营商的规范标准,同一运营商同样的业务在不同文档中不同的要求,而且有些要求就我看来应当是历史的延续,也就是现在已经很少采用了。所以豆丁上看不出所以然,从wiki上查。中文的wiki信息量有限,很短,而wiki的英文内容内多,删减版也减肥得太过。我在网上还看到一个山寨的中文wiki,长得很像,红色的,叫―天下维客‖。wiki的中文还是很不错的,但是阅读后建议再阅读英文。 我对媒体codec做了一些整理和总结,资料来源于wiki,小部分来源于网络博客的收集。网友资料我们将给出来源。如果资料已经转手几趟就没办法,雁过留声,我们只能给出某个轨迹。 基本概念 编解码 编解码器(codec)指的是一个能够对一个信号或者一个数据流进行变换的设备或者程序。这里指的变换既包括将信号或者数据流进行编码(通常是为了传输、存储或者加密)或者提取得到一个编码流的操作,也包括为了观察或者处理从这个编码流中恢复适合观察或操作的形式的操作。编解码器经常用在视频会议和流媒体等应用中。 容器 很多多媒体数据流需要同时包含音频数据和视频数据,这时通常会加入一些用于音频和视频数据同步的元数据,例如字幕。这三种数据流可能会被不同的程序,进程或者硬件处理,但是当它们传输或者存储的时候,这三种数据通常是被封装在一起的。通常这种封装是通过视频文件格式来实现的,例如常见的*.mpg, *.avi, *.mov, *.mp4, *.rm, *.ogg or *.tta. 这些格式中有些只能使用某些编解码器,而更多可以以容器的方式使用各种编解码器。 FourCC全称Four-Character Codes,是由4个字符(4 bytes)组成,是一种独立标示视频数据流格式的四字节,在wav、a vi档案之中会有一段FourCC来描述这个AVI档案,是利用何种codec来编码的。因此wav、avi大量存在等于―IDP3‖的FourCC。 视频是现在电脑中多媒体系统中的重要一环。为了适应储存视频的需要,人们设定了不同的视频文件格式来把视频和音频放在一个文件中,以方便同时回放。视频档实际上都是一个容器里面包裹着不同的轨道,使用的容器的格式关系到视频档的可扩展性。 参数介绍 采样率 采样率(也称为采样速度或者采样频率)定义了每秒从连续信号中提取并组成离散信号的采样个数,它用赫兹(Hz)来表示。采样频率的倒数叫作采样周期或采样时间,它是采样之间的时间间隔。注意不要将采样率与比特率(bit rate,亦称―位速率‖)相混淆。

常见的几种高清视频编码 格式 The Standardization Office was revised on the afternoon of December 13, 2020

高清视频的编码格式有五种,即、MPEG-4、MPEG-2、WMA-HD以及VC-1。事实上,现在网络上流传的高清视频主要以两类文件的方式存在:一类是经过MPEG-2标准压缩,以tp和ts为后缀的视频流文件;一类是经过WMV- HD(Windows Media Video High Definition)标准压缩过的wmv文件,还有少数文件后缀为avi或mpg,其性质与wmv是一样的。真正效果好的高清视频更多地以与VC-1这两种主流的编码格式流传。 编码 编码高清视频 是由国际电信联盟(iTU-T)所制定的新一代的视频压缩格式。最具价值的部分是更高的数据压缩比,在同等的图像质量,的数据压缩比能比当前DVD系统中使用的 MPEG-2高2~3倍,比MPEG-4高~2倍。正因为如此,经过压缩的视频数据,在网络传输过程中所需要的带宽更少,也更加经济。在 MPEG-2需要6Mbps的传输速率匹配时,只需要1Mbps~2Mbps的传输速率,目前已经获得DVD Forum与Blu-ray Disc Association采纳,成为新一代HD DVD的标准,不过解码算法更复杂,计算要求比WMA-HD还要高。 从ATI的Radeon X1000系列显卡、NVIDIA的GeForce 6/7系列显卡开始,它们均加入对硬解码的支持。与MPEG-4一样,经过压缩的视频文件一般也是采用avi 作为其后缀名,同样不容易辨认,只能通过解码器来自己识别。 总的来说,常见的几种高清视频编码格式的特点是能够以更低的码率得到更高的画质,相同效果的MPEG2与影片做比较,后者在容量上仅需前者的一半左右。这也就意味着,不仅能够节省HDTV的存储空间,而且还可以在手机等带

浅谈H.265视频编解码技术标准的概念 于国际电联ITU-T 和国际标准化组织ISO,ITU 的H.26×系列视频压缩标 准经过了H.261、H.263,h.263+这样一个演进过程。而ISO 的视频压缩标准是MPEG 系列,从MPEG1、MEPG2 到MPEG4,之后两个标准化组合走向合作,成立了JVT,推出了在当前最有效的视频压缩标准,H.264/AVC。从H.264 标 准发布到如今已经有五年时间,在这五年中H.264 的应用范围不断扩展,成熟 度不断提高,而ITU—T 在H.264 取得初步成功的时候,ITU—T 的视频编码特别小组VCEG 于2005 年就对视频编码技术提出了更长远的设想。并规划在技 术成熟时推出新一代的视频编码标准H.265。2012 年8 月,爱立信公司推出了首款H.265 编解码器,而在仅仅六个月之后,国际电联(ITU)就正式批准通过了HEVC/H.265 标准,标准全称为高效视频编码(HighEfficiencyVideoCoding),相较于之前的H.264 标准有了相当大的改善。 提出H.265 标准.是为了给音视频服务提供更好的视频编码方法。音视频服 务包括会话式和非会话式音视频服务。其中会话式音视频服务包括视频会议和 可视电话,非会话式音视频服务包括流媒体、广播、文档下载、媒体存储/播放 和数字摄像机。H.265 标准围绕着现有的视频编码标准H.264,保留原来的某 些技术,同时对一些相关的技术加以改进。新技术使用先进的技术用以改善码流、编码质量、延迟和算法复杂度之间的关系,达到最优化设置。具体的研究 内容包括:提高压缩效率、提高鲁棒性和错误恢复能力、减少实时的迟延、减 少信道获取时间和随机接入迟延、降低复杂度等。H.264 由于算法优化,可以 低于1Mbps 的速度实现标清数字图像传送;H.265 则可以实现利用1~2Mbps 的传输速度传送720P(分辨率1280×720)普通高清音视频传送。 事实上,H.265 视频压缩技术早在H.264 发布后不久,即进行了关键技术领

摄像头视频采集压缩及传输原理 摄像头基本的功能还是视频传输,那么它是依靠怎样的原理来实现的呢?所谓视频传输:就是将图片一张张传到屏幕,由于传输速度很快,所以可以让大家看到连续动态的画面,就像放电影一样。一般当画面的传输数量达到每秒24帧时,画面就有了连续性。 下边我们将介绍摄像头视频采集压缩及传输的整个过程。 一.摄像头的工作原理(获取视频数据) 摄像头的工作原理大致为:景物通过镜头(LENS)生成的光学图像投射到图像传感器表面上,然后转为电信号,经过A/D(模数转换)转换后变为数字图像信号,再送到数字信号处理芯片(DSP)中加工处理,再通过USB接口传输到电脑中处理,通过显示器就可以看到图像了。下图是摄像头工作的流程图: 注1:图像传感器(SENSOR)是一种半导体芯片,其表面包含有几十万到几百万的光电二极管。光电二极管受到光照射时,就会产生电荷。 注2:数字信号处理芯片DSP(DIGITAL SIGNAL PROCESSING)功能:主要是通过一系列复杂的数学算法运算,对数字图像信号参数进行优化处理,并把处理后的信号通过USB等接口传到PC等设备。 DSP结构框架: 1. ISP(image signal processor)(镜像信号处理器) 2. JPEG encoder(JPEG图像解码器) 3. USB device controller(USB设备控制器) 而视频要求将获取的视频图像通过互联网传送到异地的电脑上显示出来这其中就涉及到对于获得的视频图像的传输。 在进行这种图片的传输时,必须将图片进行压缩,一般压缩方式有如H.261、JPEG、MPEG 等,否则传输所需的带宽会变得很大。大家用RealPlayer不知是否留意,当播放电影的时候,在播放器的下方会有一个传输速度250kbps、400kbps、1000kbps…画面的质量越高,这个速度也就越大。而摄像头进行视频传输也是这个原理,如果将摄像头的分辨率调到640×480,捕捉到的图片每张大小约为50kb左右,每秒30帧,那么摄像头传输视频所需的速度为50×30/s=1500kbps=1.5Mbps。而在实际生活中,人们一般用于网络视频聊天时的分辨率为320×240甚至更低,传输的帧数为每秒24帧。换言之,此时视频传输速率将不到300kbps,人们就可以进行较为流畅的视频传输聊天。如果采用更高的压缩视频方式,如MPEG-1等等,可以将传输速率降低到200kbps不到。这个就是一般视频聊天时,摄像头所需的网络传输速度。 二.视频压缩部分 视频的压缩是视频处理的核心,按照是否实时性可以分为非实时压缩和实时压缩。而视频传输(如QQ视频即时聊天)属于要求视频压缩为实时压缩。 下面对于视频为什么能压缩进行说明。 视频压缩是有损压缩,一般说来,视频压缩的压缩率都很高,能够做到这么 高的压缩率是因为视频图像有着非常大的时间和空间的冗余度。所谓的时间冗余度指的是两帧相邻的图像他们相同位置的像素值比较类似,具有很大的相关性,尤其是静止图像,甚至两帧图像完全相同,对运动图像,通过某种运算(运动估计),应该说他们也具有很高的相关性;而空间相关性指的是同一帧图像,相邻的两个像素也具备一定的相关性。这些相关性

各种音视频编解码学习详解 编解码学习笔记(一):基本概念 媒体业务是网络的主要业务之间。尤其移动互联网业务的兴起,在运营商和应用开发商中,媒体业务份量极重,其中媒体的编解码服务涉及需求分析、应用开发、释放license收费等等。最近因为项目的关系,需要理清媒体的codec,比较搞的是,在豆丁网上看运营商的规范标准,同一运营商同样的业务在不同文档中不同的要求,而且有些要求就我看来应当是历史的延续,也就是现在已经很少采用了。所以豆丁上看不出所以然,从wiki上查。中文的wiki信息量有限,很短,而wiki的英文内容内多,删减版也减肥得太过。我在网上还看到一个山寨的中文wiki,长得很像,红色的,叫―天下维客‖。wiki的中文还是很不错的,但是阅读后建议再阅读英文。 我对媒体codec做了一些整理和总结,资料来源于wiki,小部分来源于网络博客的收集。网友资料我们将给出来源。如果资料已经转手几趟就没办法,雁过留声,我们只能给出某个轨迹。 基本概念 编解码 编解码器(codec)指的是一个能够对一个信号或者一个数据流进行变换的设备或者程序。这里指的变换既包括将信号或者数据流进行编码(通常是为了传输、存储或者加密)或者提取得到一个编码流的操作,也包括为了观察或者处理从这个编码流中恢复适合观察或操作的形式的操作。编解码器经常用在视频会议和流媒体等应用中。 容器 很多多媒体数据流需要同时包含音频数据和视频数据,这时通常会加入一些用于音频和视频数据同步的元数据,例如字幕。这三种数据流可能会被不同的程序,进程或者硬件处理,但是当它们传输或者存储的时候,这三种数据通常是被封装在一起的。通常这种封装是通过视频文件格式来实现的,例如常见的*.mpg, *.avi, *.mov, *.mp4, *.rm, *.ogg or *.tta. 这些格式中有些只能使用某些编解码器,而更多可以以容器的方式使用各种编解码器。 FourCC全称Four-Character Codes,是由4个字符(4 bytes)组成,是一种独立标示视频数据流格式的四字节,在wav、avi档案之中会有一段FourCC来描述这个AVI档案,是利用何种codec来编码的。因此wav、avi大量存在等于―IDP3‖的FourCC。 视频是现在电脑中多媒体系统中的重要一环。为了适应储存视频的需要,人们设定了不同的视频文件格式来把视频和音频放在一个文件中,以方便同时回放。视频档实际上都是一个容器里面包裹着不同的轨道,使用的容器的格式关系到视频档的可扩展性。 参数介绍 采样率 采样率(也称为采样速度或者采样频率)定义了每秒从连续信号中提取并组成离散信号的采样个数,它用赫兹(Hz)来表示。采样频率的倒数叫作采样周期或采样时间,它是采样之间的时间间隔。注意不要将采样率与比特率(bit rate,亦称―位速率‖)相混淆。 采样定理表明采样频率必须大于被采样信号带宽的两倍,另外一种等同的说法是奈奎斯特频率必须大于被采样信号的带宽。如果信号的带宽是100Hz,那么为了避免混叠现象采样频率必须大于200Hz。换句话说就是采样频率必须至少是信号中最大频率分量频率的两倍,否则就不能从信号采样中恢复原始信号。 对于语音采样: ?8,000 Hz - 电话所用采样率, 对于人的说话已经足够 ?11,025 Hz ?22,050 Hz - 无线电广播所用采样率 ?32,000 Hz - miniDV 数码视频camcorder、DAT (LP mode)所用采样率 ?44,100 Hz - 音频CD, 也常用于MPEG-1 音频(VCD, SVCD, MP3)所用采样率

视频编码原理 编码率/比特率直接与文件体积有关。且编码率与编码格式配合是否合适,直接关系到视频文件是否清晰。 在视频编码领域,比特率常翻译为编码率,单位是Kbps,例如800Kbps。 其中,1K=10241M=1024K,b为比特(bit)这个就是电脑文件大小的计量单位,1KB=8Kb,区分大小写,B代表字节(Byte)s为秒(second)p为每(per)以800kbps来编码表示经过编码后的数据每秒钟需要用800K比特来表示。 1MB=8Mb=1024KB=8192Kb Windows系统文件大小经常用B(字节)为单位表示,但网络运营商则用b(比特),也就是为什么2Mb速度宽带在电脑上显示速度最快只有约256KB的原因,网络运营商宣传网速的时候省略了计量单位。 完整的视频文件是由音频流与视频流2个部分组成的,音频和视频分别使用的是不同的编码率,因此一个视频文件的最终技术大小的编码率是音频编码率+视频编码率。例如一个音频编码率为128Kbps,视频编码率为800Kbps的文件,其总编码率为928Kbps,意思是经过编码后的数据每秒钟需要用928K比特来表示。 了解了编码率的含义以后,根据视频播放时间长度,就不难了解和计算出最终文件的大小。编码率也高,视频播放时间越长,文件体积就越大。不是分辨率越大文件就越大,只是一般情况下,为了保证清晰度,较高的分辨率需要较高的编码率配合,所以使人产生分辨率越大的视频文件体积越大的感觉。 计算输出文件大小公式: (音频编码率(Kbit为单位)/8+视频编码率(Kbit为单位)/8)×影片总长度(秒为单位)=文件大小(MB为单位) 这样以后大家就能精确的控制输出文件大小了。 例:有一个1.5小时(5400秒)的影片,希望转换后文件大小刚好为700M 计算方法如下: 700×8/5400×1024≈1061Kbps 意思是只要音频编码率加上视频编码率之和为1061Kb,则1个半小时的影片转换后文件体积大小刚好为700M。 当然不经过压缩文件的计算公式又不同: 声音为,数据量(位/秒)=(采样频率(Hz)×采样位数(bit)×声道数) 其中,单声道的声道数为1,立体声的声道数为2。 数据量×时间/8=文件总字节 例如CD即为未经压缩的音频文件,采样44.1k,16位,双声道。 数据量=44.1×16×2=1411kb/1024=1.38Mb,一般的MP3压缩后为128kbps

视频压缩编码标准H.264详解

视频压缩编码标准H.264详解 ——新疆大学2006级工硕郭新军 JVT(Joint Video Team,视频联合工作组)于2001年12月在泰国Pattaya 成立。它由ITU-T和ISO两个国际标准化组织的有关视频编码的专家联合组成。JVT的工作目标是制定一个新的视频编码标准,以实现视频的高压缩比、高图像质量、良好的网络适应性等目标。目前JVT的工作已被ITU-T接纳,新的视频压缩编码标准称为H.264标准,该标准也被ISO接纳,称为AVC(Advanced Video Coding)标准,是MPEG-4的第10部分。 H.264标准可分为三档: 基本档次(其简单版本,应用面广); 主要档次(采用了多项提高图像质量和增加压缩比的技术措施,可用于SDTV、HDTV和DVD等); 扩展档次(可用于各种网络的视频流传输)。 H.264不仅比H.263和MPEG-4节约了50%的码率,而且对网络传输具有更好的支持功能。它引入了面向IP包的编码机制,有利于网络中的分组传输,支持网络中视频的流媒体传输。H.264具有较强的抗误码特性,可适应丢包率高、干扰严重的无线信道中的视频传输。H.264支持不同网络资源下的分级编码传输,从而获得平稳的图像质量。H.264能适应于不同网络中的视频传输,网络亲和性好。 一、H.264视频压缩系统 H.264标准压缩系统由视频编码层(VCL)和网络提取层(Network Abstraction Layer,NAL)两部分组成。VCL中包括VCL编码器与VCL解码器,主要功能是视频数据压缩编码和解码,它包括运动补偿、变换编码、熵编码等压缩单元。NAL则用于为VCL提供一个与网络无关的统一接口,它负责对视频数